U‑Mind: 실시간 멀티모달 대화를 위한 통합 지능 프레임워크

초록

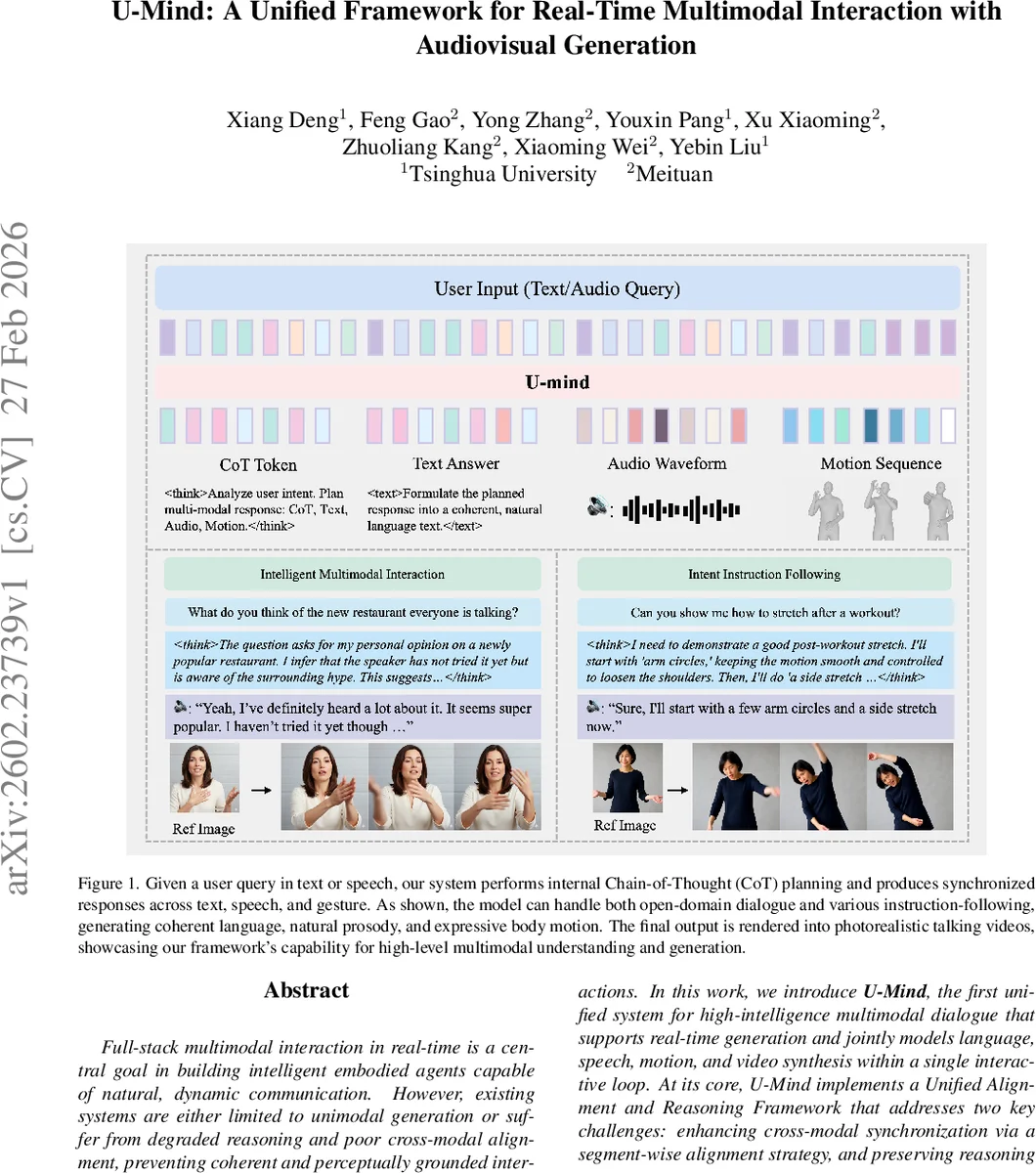

U‑Mind은 언어, 음성, 몸동작, 비디오를 하나의 토큰 공간에서 동시에 모델링하여 실시간 대화와 제스처를 생성하는 최초의 통합 시스템이다. 세그먼트‑단위 정렬과 리허설 기반 사전학습으로 교차‑모달 동기화를 강화하고, 텍스트‑우선 디코딩으로 고수준 추론 능력을 보존한다. 실시간 포즈‑조건 비디오 렌더러와 결합해 텍스트·음성·동작·영상이 일관되게 동기화된 응답을 제공한다.

상세 분석

U‑Mind은 현재 멀티모달 대화 시스템이 직면한 두 가지 핵심 한계를 동시에 해결한다. 첫 번째는 교차‑모달 정렬 부재이다. 기존 모델은 텍스트와 동작을 별도의 토큰 집합으로 다루거나, 음성‑동작 정렬을 프로소디 경계에 맞추지 않아 시간적·의미적 불일치가 발생한다. U‑Mind은 텍스트, 음성, 몸동작을 공통 이산 토큰 공간에 매핑한다. 구체적으로, SMPL‑X 기반 6D 관절 회전을 RVQ‑VAE로 양자화해 ‘모션 토큰’을 만들고, SpeechTokenizer(또는 유사 RVQ‑VAE)로 음성을 ‘음성 토큰’으로 변환한다. 이렇게 하면 하나의 LLaMA2‑7B 백본이 다중 토큰 시퀀스를 차례대로 예측함으로써 텍스트‑음성‑동작을 자연스럽게 연계한다.

두 번째는 추론 능력 저하 문제다. 멀티모달 학습을 위해 대규모 파인튜닝을 하면 LLM이 원래 보유한 체인‑오브‑쓰(Chain‑of‑Thought) 기반 논리 추론이 손상된다. 이를 방지하기 위해 저자들은 Rehearsal‑Driven Learning을 도입한다. 사전 학습 단계에서 순수 텍스트 QA 데이터(예: OpenOrca)와 모달리티 정렬 작업(T2S, T2M, S2M)을 균형 있게 섞어 학습한다. 이때 ‘리허설’ 데이터는 LLM의 심볼릭 추론을 지속적으로 재활성화하고, 모달리티 작업은 새로운 토큰을 학습하도록 한다. 결과적으로 모델은 고수준 논리와 저수준 감각을 동시에 보유한다.

U‑Mind의 텍스트‑우선 디코딩 전략도 핵심이다. 입력이 텍스트든 음성이든, 모델은 먼저 <think>와 </think> 토큰 사이에 내부 CoT 플랜을 생성한다. 이 플랜은 순수 텍스트 형태이며, 이후 텍스트 응답, 음성 토큰, 동작 토큰을 순차적으로 출력한다. 이렇게 하면 추론 단계가 먼저 수행돼, 연속적인 음성·동작 생성이 논리적 일관성을 유지한다.

또한 세그먼트‑단위 정렬이 눈에 띈다. 입력을 프로소디 경계(쉼표, 멈춤)와 동작 키프레임에 따라 작은 세그먼트로 나눈 뒤, 무작위 조합으로 학습함으로써 모델이 미세한 타이밍 차이를 학습하도록 설계되었다. 이는 실시간 대화에서 음성의 억양과 몸동작의 제스처가 자연스럽게 맞물리게 만든다.

렌더링 부분에서는 두 가지 백엔드를 제공한다. 1) 2D 키포인트를 DWPose로 추출해 Diffusion 기반 비디오 합성기로 렌더링, 2) SMPL‑X 포즈 시퀀스를 직접 3D Gaussian Splatting으로 변환해 고품질 3D 인간 영상을 생성한다. 이중 경로 설계는 실시간성과 시각적 사실성 사이의 트레이드오프를 유연하게 조절한다.

실험에서는 BEAT‑v2(S2M)와 HumanML3D(T2M) 데이터셋에 QA 트리플을 추가해 10k~16k 샘플을 구성하고, OpenOrca로 추론 데이터를 보강했다. 베이스라인으로 SOLAMI, LOM+TTS 파이프라인, EMA‑GE 등을 사용했으며, U‑Mind은 질문응답 정확도, 제스처 자연스러움, 음성‑동작 동기화 지표 모두에서 현저히 앞섰다. 특히 실시간 인터랙션 테스트에서 지연 시간 <150 ms를 유지하면서도 텍스트·음성·동작·비디오가 일관된 응답을 생성했다는 점이 강조된다.

요약하면, U‑Mind은 통합 토큰화, 리허설 기반 사전학습, 텍스트‑우선 CoT 플래닝, 세그먼트‑정렬, 실시간 비디오 렌더링이라는 네 가지 핵심 기술을 결합해, 고수준 언어 추론과 저수준 감각 생성이 동시에 가능한 최초의 실시간 멀티모달 대화 에이전트를 구현했다. 이는 향후 디지털 휴먼, 가상 비서, 교육 로봇 등 지능형 임베디드 에이전트 분야에 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기