액션·변화·계획 추론을 위한 대규모 벤치마크 ACPBench 소개

초록

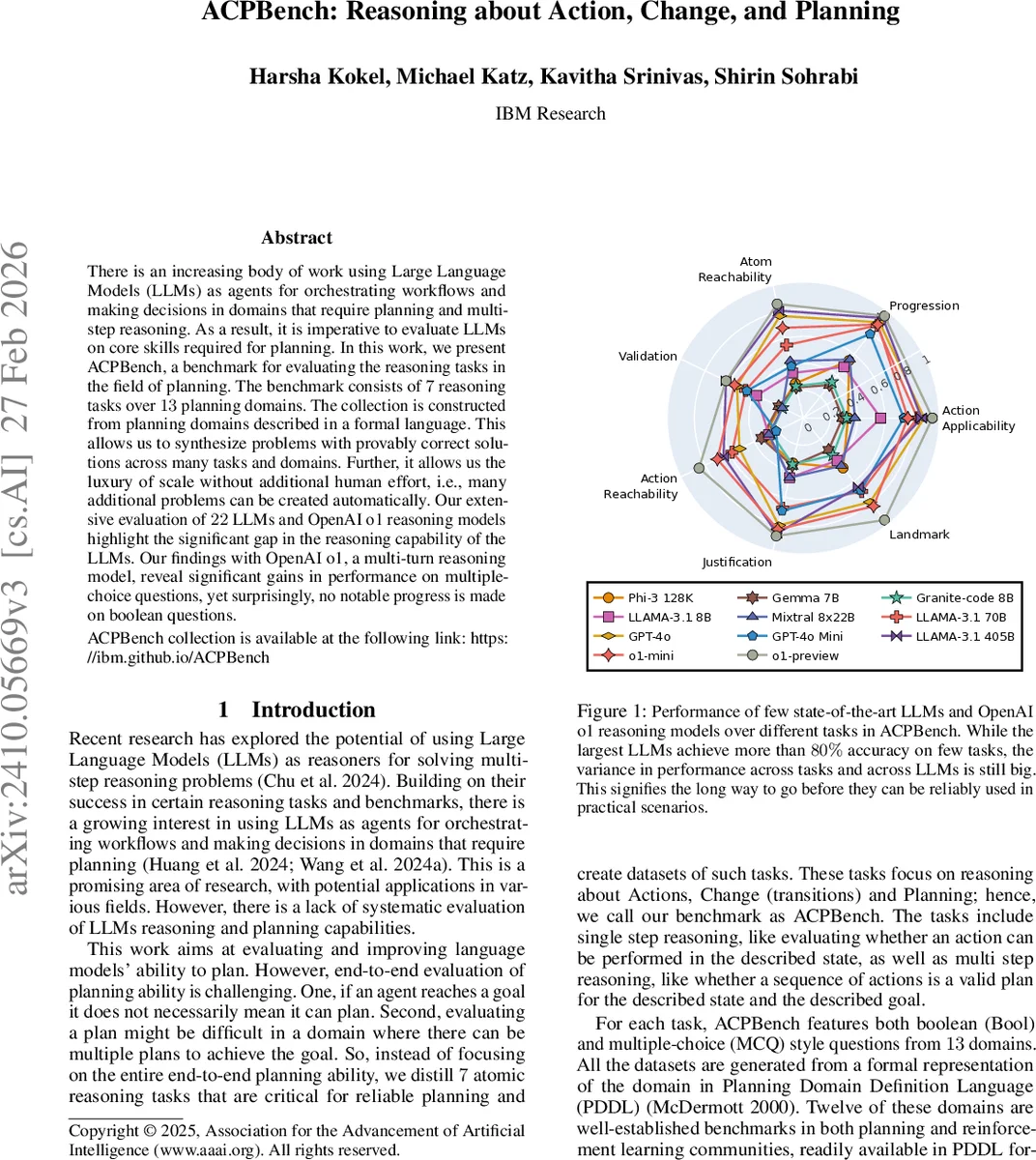

본 논문은 계획 분야의 핵심 추론 능력을 평가하기 위해 13개 도메인과 7가지 추론 과제로 구성된 ACPBench를 제안한다. PDDL 기반 도메인 정의를 활용해 자동으로 대규모 질문(불리언·다중선택) 데이터를 생성하고, 22개의 최신 LLM과 OpenAI o1 모델을 평가하였다. 결과는 대형 모델조차도 과제별 성능 차이가 크며, o1은 다중선택에서는 크게 향상되지만 불리언 질문에서는 진전이 없음을 보여준다. 8 B 파라미터 모델을 미세조정하면 대형 모델 수준의 성능을 달성할 수 있음을 확인하였다.

상세 분석

ACPBench는 계획(Planning) 연구에서 핵심적인 ‘행동‑적용성’, ‘진행(Progression)’, ‘도달 가능성(Reachability)’, ‘행동 도달성(Action Reachability)’, ‘검증(Validation)’, ‘정당화(Justification)’, ‘랜드마크(Landmark)’의 7가지 원자적 추론 작업을 정의하고, 각각에 대해 불리언(Boolean)과 다중선택(MCQ) 형태의 질문을 제공한다. 각 작업은 PDDL(Planning Domain Definition Language)로 기술된 도메인에서 자동으로 샘플링·생성되며, 이는 정답이 수학적으로 보장된다는 강점을 가진다. 13개 도메인(BlocksWorld, Logistics, Grid 등)과 새롭게 설계한 Swap 도메인을 포함해 총 13,000여 개 이상의 질문이 생성되었다.

데이터 생성 파이프라인은 (1) PDDL 파일을 파싱해 상태·행동·전이 규칙을 추출, (2) 사전에 정의된 자연어 템플릿을 이용해 인간이 이해 가능한 서술문으로 변환, (3) 논리적 규칙에 따라 정답을 자동 라벨링하는 단계로 이루어진다. 특히 ‘진행’ 작업에서는 사전·사후 상태를 비교해 네 종류(유지, 삭제, 추가, 무관)의 사실을 구분하고, 각각에 대해 긍정·부정 예시를 균형 있게 제공한다. ‘도달 가능성’은 PSPACE‑hard 문제이지만, delete‑relaxed reachability, mutex 관계, 정적 사실 불가능성 등을 활용해 현실적인 양성·음성 샘플을 만든다.

평가에서는 22개의 공개·폐쇄형 LLM(GPT‑4o, LLaMA‑3, Mixtral, Phi‑3 등)과 OpenAI o1‑preview·o1‑mini 두 버전을 대상으로, 체인‑오브‑생각(CoT) 프롬프트와 2‑shot 예시를 적용하였다. GPT‑4o는 MCQ 전체 평균 78.4% 정확도, 가장 어려운 ‘검증’ 작업에서 52.5%를 기록했다. o1‑preview는 MCQ 평균 87.3%로 최고 성능을 보였지만, Boolean 질문에서는 63.1%~68.2% 수준에 머물며 기존 모델과 큰 격차가 없었다. 이는 현재 LLM이 복합 논리 연산보다는 선택형 추론에 더 강점이 있음을 시사한다.

또한 8 B 파라미터 모델을 동일 데이터셋으로 미세조정한 결과, 대형 모델(GPT‑4o, o1)과 비슷한 수준(≈80% MCQ, ≈70% Bool)까지 성능이 상승했으며, 미세조정 모델은 훈련에 사용되지 않은 도메인에서도 일정 수준의 일반화를 보였다. 세 가지 ablation 실험을 통해 (1) CoT와 in‑context 예시가 성능에 미치는 영향, (2) ACPBench가 실제 계획 생성 능력을 대변하는지 여부, (3) 시간에 따른 LLM 성능 추세를 분석했으며, 특히 CoT와 2‑shot이 대부분의 작업에서 5~10%p 상승을 가져왔음을 확인했다.

전체적으로 ACPBench는 (i) 형식화된 도메인으로부터 자동·정확한 데이터 생성이 가능, (ii) 다양한 난이도와 형식(불리언·다중선택)으로 LLM의 세부 추론 능력을 정밀하게 측정, (iii) 기존 벤치마크와 달리 계획 전반에 걸친 원자적 사고 과정을 포괄한다는 점에서 의미가 크다. 현재 LLM이 계획 영역에서 실용적으로 사용되기 위해서는 특히 Boolean‑type 논리 검증과 다단계 전이 추론 능력을 크게 향상시켜야 함을 강조한다.

댓글 및 학술 토론

Loading comments...

의견 남기기