멀티턴 RAG 대화의 열린 과제 탐색을 위한 MTRAG UN 벤치마크

MTRAG-UN은 6개 도메인에 걸쳐 666개의 멀티턴 대화 과제와 2,800여 개의 발화를 제공하는 벤치마크이다. UNanswerable, UNderspecified, NONstandalone, UNclear와 같은 답변 불가능·불명확 상황을 중심으로 검색·생성 모델의 한계를 진단한다.

초록

MTRAG-UN은 6개 도메인에 걸쳐 666개의 멀티턴 대화 과제와 2,800여 개의 발화를 제공하는 벤치마크이다. UNanswerable, UNderspecified, NONstandalone, UNclear와 같은 답변 불가능·불명확 상황을 중심으로 검색·생성 모델의 한계를 진단한다.

상세 요약

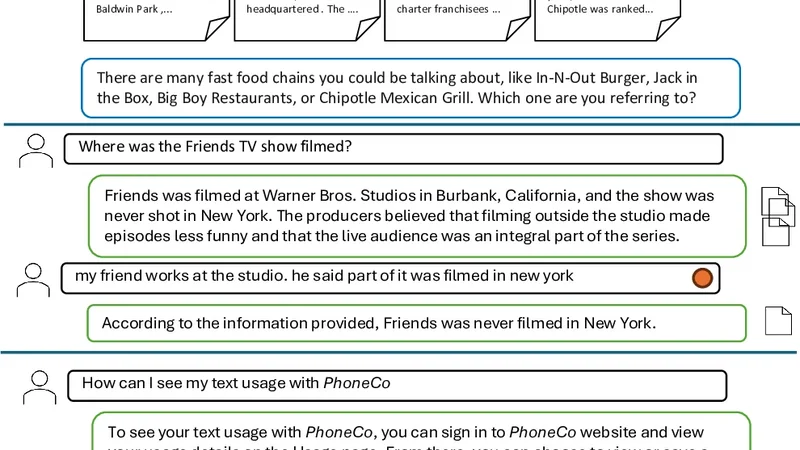

MTRAG-UN은 기존 RAG(Retrieval‑Augmented Generation) 연구가 주로 단일 질문‑응답 혹은 짧은 대화에 초점을 맞춘 점을 보완하고자 설계되었다. 데이터는 의료, 금융, 기술, 교육, 엔터테인먼트, 법률 등 6개 영역에서 실제 사용자 로그와 전문가가 만든 시나리오를 결합해 구축했으며, 각 대화는 평균 4~5턴으로 구성된다. 특히 “UNanswerable”(답변이 존재하지 않음), “UNderspecified”(질문이 모호하거나 정보가 부족함), “NONstandalone”(이전 턴에 의존하지만 독립적으로는 의미가 없음), “UNclear”(응답이 불분명하거나 모호함) 네 가지 유형을 명시적으로 라벨링했다. 이는 멀티턴 대화에서 흔히 발생하지만 기존 벤치마크에서는 드러나지 않았던 문제들을 체계적으로 드러낸다.

실험에서는 대표적인 두 단계 파이프라인(밀리터리 검색 + GPT‑3.5 기반 생성)과 엔드‑투‑엔드 RAG 모델(FAISS + T5‑XXL) 두 가지 접근법을 평가했다. 평가 지표는 전통적인 정확도·BLEU·ROUGE 외에 답변 가능성 판단 정확도와 질문‑응답 일관성 점수를 추가해, 모델이 언제 “답변을 포기”하거나 “추가 정보를 요구”해야 하는지를 측정했다. 결과는 모든 모델이 UNanswerable·UNclear 상황에서 높은 오류율을 보였으며, 특히 UNderspecified 질문에 대해 검색 단계에서 적절한 문서를 찾지 못해 생성 단계가 전혀 의미 없는 텍스트를 출력하는 경우가 빈번했다. NONstandalone 유형에서는 대화 흐름을 추적하지 못해 이전 턴의 정보를 무시하거나 잘못 연결하는 오류가 드러났다.

오류 분석을 통해 두 가지 근본적인 한계를 확인했다. 첫째, 현재 검색 엔진은 질의의 맥락을 충분히 반영하지 못해, 대화 이력 전체를 고려한 “다중 턴 쿼리 재작성”이 필요하다. 둘째, 생성 모델은 외부 지식과 내부 대화 상태를 통합하는 메커니즘이 부족해, 불확실한 상황에서 “불확실성 추정”과 “대답 회피” 전략을 스스로 선택하지 못한다. 이러한 발견은 향후 RAG 시스템이 대화형 AI로서 실용성을 갖추기 위해서는 불확실성 관리와 대화 흐름 유지가 핵심 과제임을 시사한다.

📜 논문 원문 (영문)

🚀 1TB 저장소에서 고화질 레이아웃을 불러오는 중입니다...