클라우드 대규모 데이터 처리의 새로운 기준, FuxiShuffle 적응형·복원형 셔플 서비스

초록

FuxiShuffle은 알리바바 클라우드 MaxCompute 환경에서 초대규모 데이터 처리 작업의 셔플 단계에 적응형 모드 선택, 진행 상황 기반 스케줄링, 동적 백업 전략을 도입해 성능과 장애 복구 효율을 크게 향상시킨 서비스이다. 실험 결과 기존 시스템 대비 작업 완료 시간이 평균 76 % 단축되고 자원 사용량이 67 % 감소했다.

상세 분석

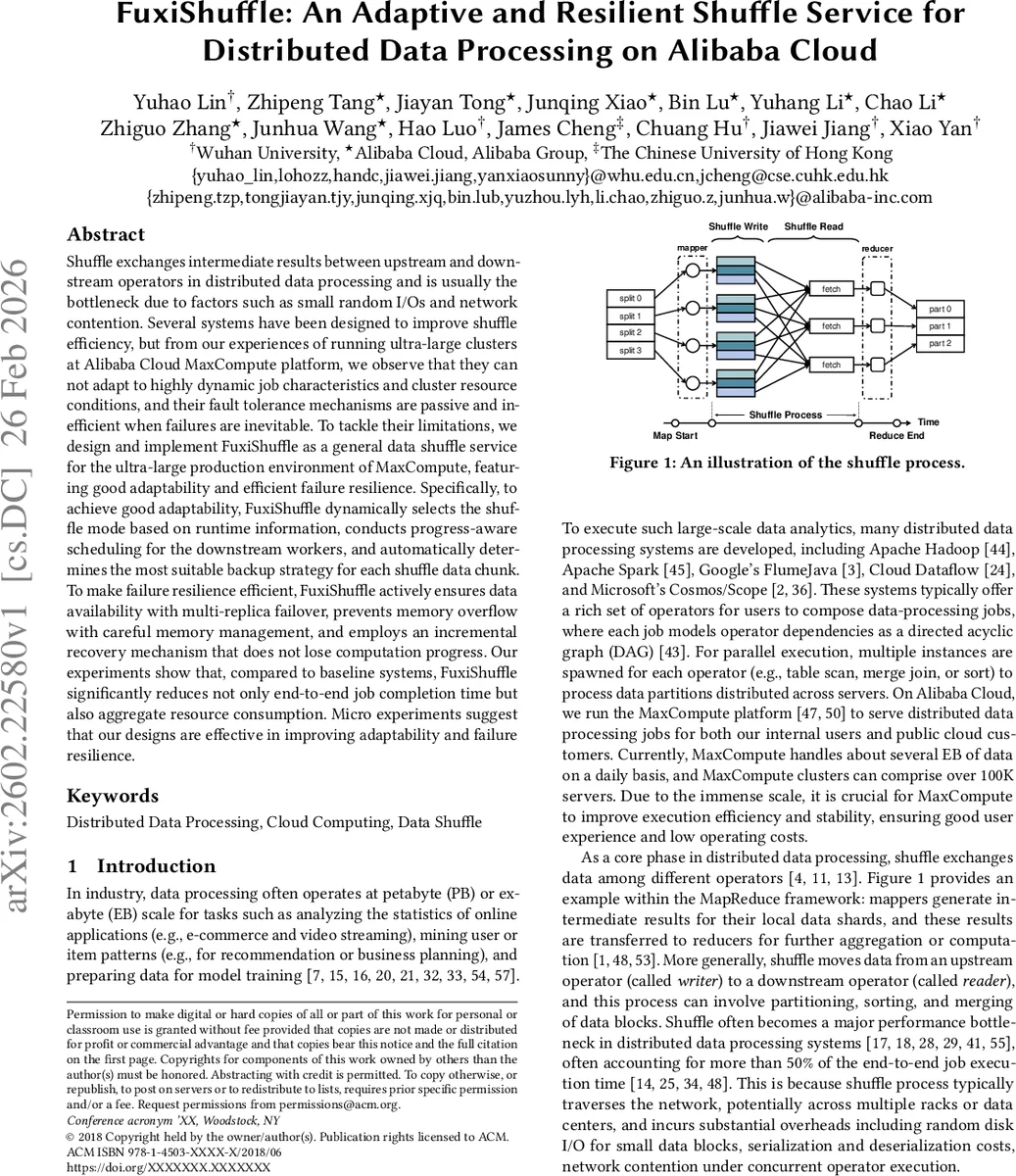

본 논문은 대규모 클라우드 환경에서 데이터 셔플이 전체 파이프라인의 병목이 되는 현상을 정확히 짚어낸다. 기존 시스템은 고정된 셔플 모드(메모리 혹은 디스크)와 정적인 스케줄링(스테이지드 혹은 갱 스케줄링)에 의존해 작업 특성이나 클러스터 자원 상황이 변동해도 유연하게 대응하지 못한다. 특히, 메모리 부족 시 디스크 스필이 발생하면서 작은 랜덤 I/O가 급증하고, 네트워크 혼잡이 심화돼 전체 지연이 크게 늘어난다. 또한, 장애 발생 시 수동적인 복구 방식(전체 업스트림 재실행)으로 인해 진행 중인 다운스트림 작업이 중단되고, 이미 읽은 데이터와 계산 결과가 버려지는 비효율이 발생한다.

FuxiShuffle은 이러한 문제점을 해결하기 위해 세 가지 핵심 적응 메커니즘을 설계했다. 첫째, 실행 시간 임계값 기반의 동적 셔플 모드 선택 로직을 도입해 작업의 데이터 규모와 현재 클러스터 메모리 여유를 실시간으로 평가한다. 짧은 실행 시간·소규모 데이터는 메모리 셔플을, 대규모·장기 작업은 디스크 셔플을 자동 전환함으로써 메모리 압박을 최소화한다. 둘째, 진행 상황을 감지하는 ‘프로그레시브 스케줄링’으로 다운스트림 리더를 단계적으로 활성화한다. 이는 모든 라이터가 종료될 때까지 대기하는 스테이지드 방식의 지연을 해소하고, 동시에 모든 리더를 동시에 띄우는 갱 방식에서 발생하는 아이들링을 줄여 자원 활용 효율을 높인다. 셋째, 파티션 별 백업 전략을 동적으로 결정한다. 데이터 크기·스키우, SLA 요구사항 등을 고려해 ‘집계 쓰기(aggregation write)’와 ‘복제 백업(replication backup)’을 혼합 적용함으로써 신뢰성과 성능 사이의 최적 균형을 유지한다.

장애 복구 측면에서도 혁신적인 설계가 돋보인다. 라이터 그룹을 목적 파티션별로 셔플 에이전트에 할당해 ‘셔플 에이전트 그룹’ 형태로 네트워크 부하를 분산하고, 각 에이전트에 다중 복제본을 유지해 단일 장애점(SPOF)을 제거한다. 메모리 관리에서는 우선순위 기반의 페이지 교체 정책을 적용해 OOM 상황을 사전에 방지한다. 가장 눈에 띄는 것은 ‘증분 복구(incremental recovery)’ 메커니즘이다. 라이터가 실패하면 해당 파티션만 재실행하고, 이미 진행 중인 리더는 중단되지 않은 채 남은 데이터를 계속 처리한다. 따라서 전체 작업이 재시작되는 오버헤드가 크게 감소하고, 반복 재실행 루프에 빠지는 현상이 억제된다.

실험에서는 Alibaba Cloud의 실제 프로덕션 클러스터(서버 수 10만 이상, 일일 처리 데이터 수 EB 규모)에서 FuxiShuffle을 적용한 결과, 베이스라인 시스템 대비 평균 작업 완료 시간이 76.36 % 단축되고, 전체 자원 소비가 67.14 % 감소했다. 단일 장애점이 발생해도 성능 저하가 10 % 이하에 머물렀으며, 지속적인 장애 상황에서도 안정적인 처리량을 유지했다. 또한, 마이크로 벤치마크를 통해 적응형 모드 선택, 프롤레시브 스케줄링, 동적 백업, 증분 복구 각각이 성능·복원성 향상에 기여함을 정량적으로 입증했다.

이러한 설계와 평가 결과는 대규모 클라우드 데이터 처리 시스템에서 셔플 단계의 적응성 및 복원성을 강화하는 실질적인 방안을 제시한다. 특히, 작업 특성에 기반한 실시간 모드 전환과 진행 상황 기반 스케줄링, 그리고 복제·증분 복구를 결합한 통합 프레임워크는 향후 다른 분산 처리 엔진(예: Spark, Flink)에도 적용 가능성이 높다. 논문은 또한 대규모 셔플 서비스 구축 시 고려해야 할 운영 인사이트(리소스 모니터링, 복제 정책 튜닝, 장애 감지 메커니즘 등)를 정리해 후속 연구와 실무 적용에 유용한 가이드라인을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기