에피스테믹 불확실성의 클래스별 분해와 안전성 향상

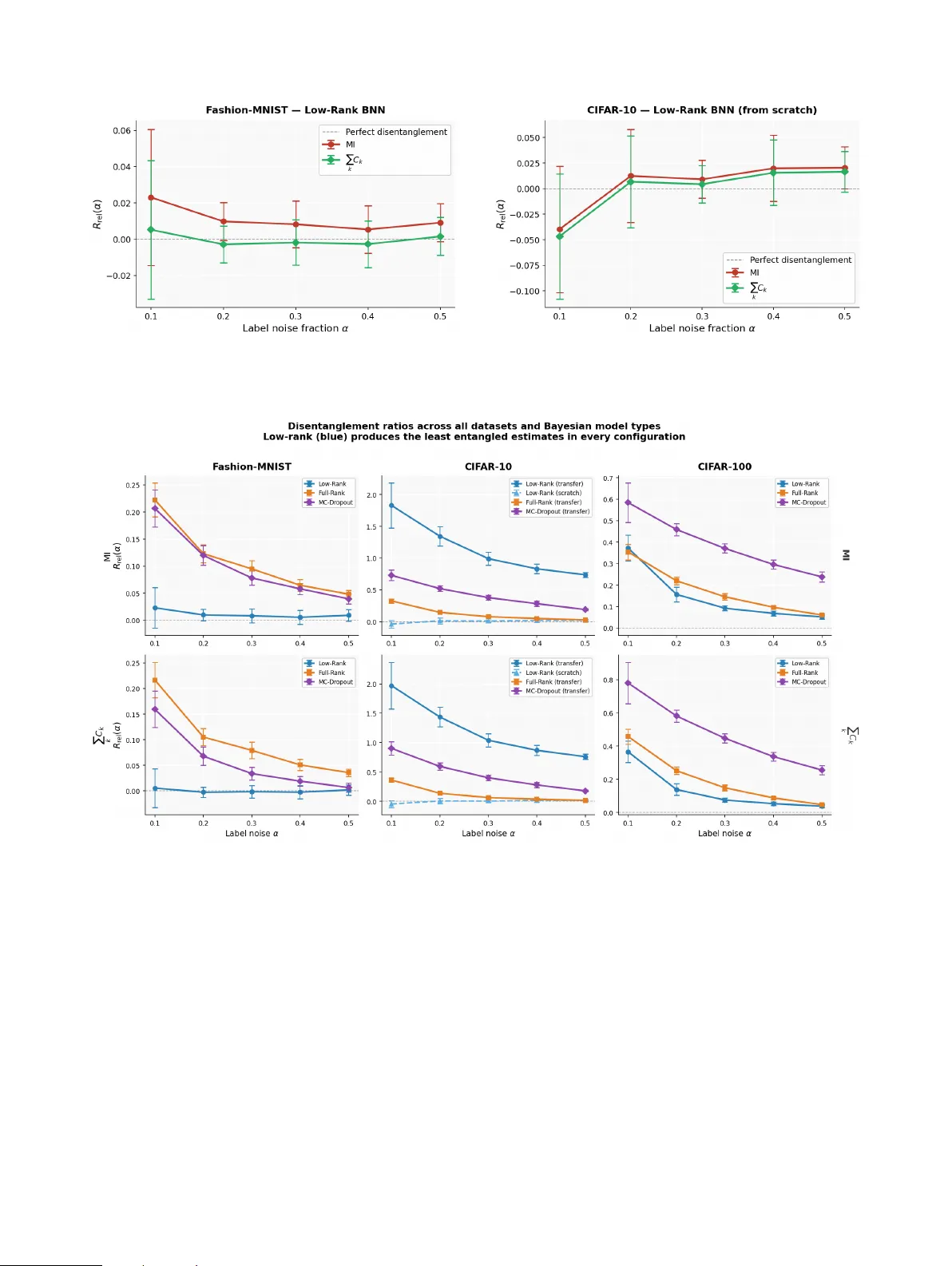

본 논문은 베이지안 딥러닝에서 사용되는 단일 스칼라 상호정보량(MI)을 클래스별 기여도로 분해한 새로운 지표 Cₖ(x)=σₖ²/(2μₖ)를 제안한다. 2차 테일러 전개와 1/μₖ 가중치를 통해 희소 클래스에서도 의미 있는 불확실성을 측정하며, 전체 Cₖ의 합은 MI를 근사한다. 제안 방법은 당뇨망막증 위험도 예측, OOD 탐지, 라벨 노이즈 실험에서 기존 MI와 분산 기반 방법보다 우수한 성능을 보이며, 후방 전파 방식과 posterior 근사…

저자: Mame Diarra Toure, David A. Stephens

본 연구는 안전‑중요 분류 작업에서 에피스테믹 불확실성을 클래스별로 정량화하는 새로운 방법론을 제시한다. 기존 베이지안 딥러닝은 모델 파라미터에 대한 posterior를 유지함으로써 aleatoric(데이터 자체의 잡음)과 epistemic(모델의 무지) 불확실성을 구분한다. 특히 epistemic 불확실성은 mutual information I(y;ω|x)=H(μ)−E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기