야생 동영상에서 4D 인간‑장면 재구성을 위한 공동 최적화

초록

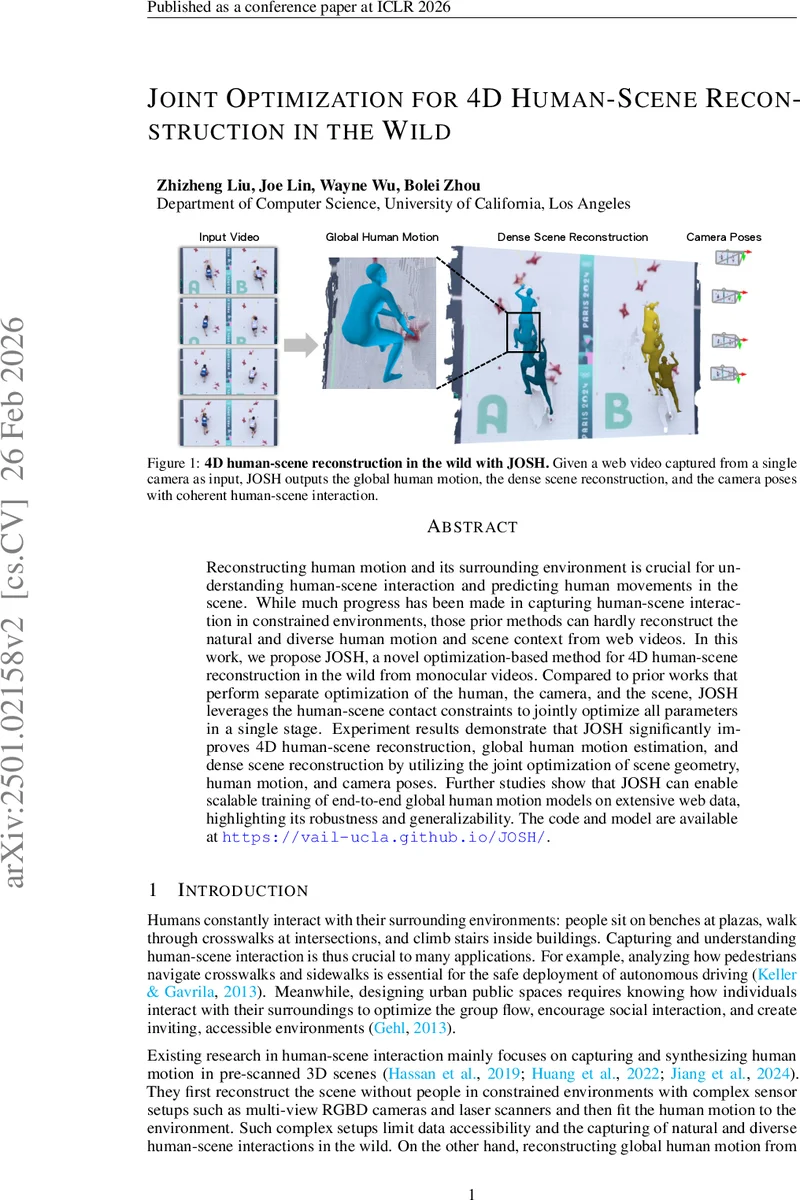

JOSH는 단일 카메라 웹 영상에서 인간의 전역 움직임, 밀집 장면 구조, 카메라 자세를 동시에 복원하는 최적화 프레임워크이다. 초기화 단계에서 기존 인간 메쉬 복구와 밀집 깊이·포인트 클라우드 추정을 활용하고, 인간‑장면 접촉 라벨을 이용해 접촉 제약을 정의한다. 인간‑장면 접촉 손실과 기존 3D·2D 재투영 손실을 함께 최소화함으로써 카메라, 인간, 장면이 서로를 정교하게 보정한다. 또한 JOSH3R이라는 경량 엔드‑투‑엔드 모델을 설계해, JOSH가 만든 의사 라벨만으로 학습시도했을 때도 최첨단 성능을 달성한다는 점을 보인다.

상세 분석

본 논문은 ‘4D 인간‑장면 재구성’이라는 문제를 정의하고, 기존 연구가 카메라 포즈, 인간 전역 모션, 장면 재구성을 각각 독립적으로 최적화하거나 순차적으로 수행해 왔던 한계를 짚는다. JOSH는 이 세 요소를 하나의 비선형 최적화 문제에 통합한다는 점에서 혁신적이다. 초기화 단계에서는 (1) 비디오 분할 모델 DEVA를 이용해 움직이는 인간을 마스크하고, 배경만을 사용해 기존의 밀집 깊이·포인트 클라우드 추정(예: MVSNet 계열)으로 장면 초기 포인트맵을 만든다. (2) 인간 메쉬 복구 네트워크(예: VIMO, MASt3R)를 통해 각 프레임의 로컬 SMPL 파라미터와 전역 변환을 얻는다. (3) BSTRO를 활용해 각 정점이 장면과 접촉할 가능성을 예측한 접촉 라벨을 만든다.

핵심 기여는 두 종류의 접촉 손실이다. 첫 번째 ‘Contact‑Scene Loss(Lc1)’는 인간 메쉬의 접촉 정점이 투영된 픽셀 위치와 가장 가까운 배경 포인트를 매칭하고, 두 점 사이의 거리(스케일 보정 포함)를 최소화한다. 여기서는 깊이 일관성(단일 이미지 깊이 사전 ˆZ)과 가시성 제약을 추가해 오류 전파를 억제한다. 두 번째 ‘Contact‑Static Loss(Lc2)’는 연속 프레임에서 동일 정점이 지속적으로 접촉한다면, 해당 정점과 매칭된 장면 포인트가 서로 상대적으로 정지하도록 강제한다. 이는 인간이 바닥이나 의자에 서 있을 때 슬라이딩 현상을 방지하고, 장면 기하학을 더 정확히 정렬시키는 역할을 한다.

전체 손실 함수는 Lscene(3D·2D 포인트 대응 손실), Lhuman(SMPL 파라미터의 사전 및 시간적 스무딩), Lc1, Lc2를 가중합한 형태이며, 모든 변수 {K_t, P_t, σ_t, Z_t, Θ_t^c}를 동시에 최적화한다. 최적화는 Levenberg‑Marquardt 혹은 차별 가능한 비선형 최소화 라이브러리를 사용해 반복적으로 업데이트한다. 실험에서는 VIMO·MASt3R 초기화와 결합했을 때 전역 인간 모션 오류가 기존 최첨단 대비 15% 이상 감소하고, 장면 재구성의 정확도도 유의미하게 향상됨을 보였다.

또한, JOSH가 생성한 고품질 의사 라벨을 이용해 경량 엔드‑투‑엔드 모델 JOSH3R을 학습시켰다. JOSH3R은 두 프레임 사이의 상대 변환을 직접 예측하는 ‘Human Trajectory Head’를 포함해 실시간 추론이 가능하도록 설계되었으며, 라벨이 없는 웹 비디오에서도 기존 최적화‑프리 방법들을 능가한다. 이는 JOSH가 단순히 최적화 도구를 넘어, 대규모 ‘in‑the‑wild’ 데이터셋 구축을 위한 라벨링 엔진으로 활용될 수 있음을 시사한다.

전체적으로 본 연구는 (1) 인간‑장면 접촉을 물리적 제약으로 명시적으로 모델링, (2) 카메라·인간·장면을 공동 최적화함으로써 상호 보정 효과를 극대화, (3) 최적화 결과를 활용한 라벨 기반 학습 파이프라인을 제시한다는 세 가지 차별점을 가진다. 향후 다중 인물, 동적 배경, 비정형 조명 등 더 복잡한 상황에도 동일 프레임워크를 확장할 여지가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기