적은 파라미터로 적외선·가시광 융합 학습

초록

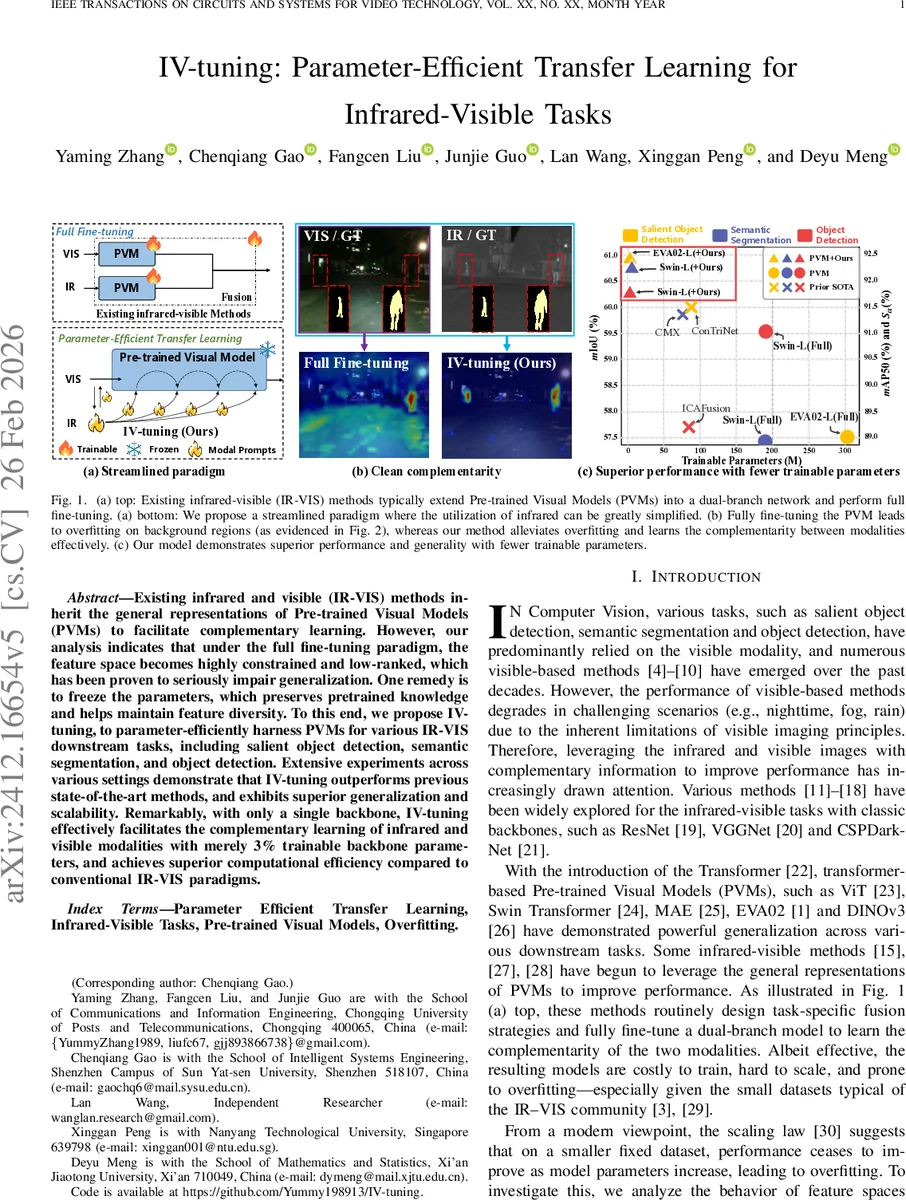

IV‑tuning은 사전 학습된 비전 모델을 고정하고, 적외선과 가시광 이미지의 특성을 반영한 모달리티‑프롬프트와 두 단계 융합 모듈만을 학습함으로써 전체 파라미터의 3 %만 업데이트한다. 전체 미세조정 시 발생하는 저차원, 과적합 문제를 피하고, 저주파 정보를 보존하는 선형 투영을 활용해 적외선 특성을 효과적으로 전달한다. 실험 결과, Salient Object Detection, Semantic Segmentation, Object Detection 등 3가지 IR‑VIS 과제에서 최신 방법들을 능가하며, 모델 규모와 연산 비용에서도 우수한 효율성을 보인다.

상세 분석

본 논문은 적외선·가시광 융합 과제에서 기존의 전이 학습 방식이 갖는 두 가지 근본적인 한계를 짚어낸다. 첫째, 사전 학습된 비전 모델(PVM)을 전체 미세조정(full fine‑tuning)할 경우, 깊은 층으로 갈수록 특징 공간이 급격히 압축되어 주성분 하나가 대부분의 분산을 차지하는 저차원 서브스페이스로 전락한다. 이는 정보 병목 현상과 유사하게 작동해 작은 데이터셋에 과적합을 초래하고, 일반화 능력을 크게 저하시킨다. 저자들은 PCA 분석을 통해 EV A02‑L+Segformer 모델의 5번째 레이어 이후 설명 가능한 분산 비율이 0.9 이상으로 집중되는 현상을 실증하였다.

둘째, 파라미터를 완전히 고정(freeze)하면 사전 학습된 표현을 보존해 특징 다양성은 유지되지만, 특정 과제에 필요한 판별 정보를 충분히 추출하지 못한다. 따라서 두 극단 사이의 절충점이 필요하다. 이를 해결하기 위해 저자는 Parameter‑Efficient Transfer Learning(PETL) 개념을 차용해, 백본은 고정하고 가벼운 어댑터 형태의 모듈만을 학습한다. 특히, 적외선 이미지가 저주파 성분을 강하게 포함한다는 물리적 특성을 분석하고, 3×3 컨볼루션이 저주파를 손실시키는 반면 전역 선형 투영은 이를 보존한다는 점을 강조한다.

IV‑tuning은 이러한 통찰을 바탕으로 두 가지 핵심 설계를 제안한다. 첫 번째는 Modality‑aware Prompter(MP)이다. MP‑α 블록은 적외선과 가시광 입력에 각각 선형 투영을 적용해 모달리티‑특화 프롬프트를 생성하고, 이를 초기 프롬프트 P₀로 사용한다. 두 번째는 두 단계 융합 전략이다. α‑fusion은 저차원(초기 레이어)에서 동일한 프롬프트를 공유해 간단히 결합하고, β‑fusion은 깊은 레이어에서 고차원 특징을 고려해 각 레이어별로 업데이트된 프롬프트를 적용한다. 이렇게 하면 초기 저주파 중심의 적외선 정보는 유지하면서, 깊은 층에서는 풍부한 고주파 텍스처와 시맨틱 정보를 효과적으로 통합한다.

실험에서는 Swin‑Transformer와 EVA‑02‑L 두 가지 최신 PVM을 백본으로 사용하고, 5개의 데이터셋(두 개 Salient Object Detection, 두 개 Semantic Segmentation, 하나 Object Detection)에서 전체 파라미터 대비 3 % 이하만 학습하였다. 결과는 전통적인 듀얼‑브랜치 구조와 전체 미세조정 대비 평균 2–4 %의 mIoU·F‑measure·AP 향상을 보였으며, 연산량과 메모리 사용량에서도 30 % 이상 절감 효과를 입증했다. 특히, 저주파 보존을 위한 선형 투영이 적외선 이미지의 열적 구조를 효과적으로 전달함으로써 야간·안개 등 가시광이 약한 환경에서도 강인한 성능을 유지한다는 점이 주목할 만하다.

요약하면, IV‑tuning은 (1) 전체 미세조정의 과적합 위험을 피하고, (2) 파라미터 고정을 통한 사전 지식 보존, (3) 모달리티‑특화 프롬프트와 단계적 융합을 통한 효율적 특징 통합이라는 세 축을 결합한 파라미터‑효율 전이 학습 프레임워크이다. 이는 향후 대규모 비전 모델을 다양한 센서 융합 과제에 적용할 때, 비용·성능·일반화 사이의 균형을 맞추는 강력한 설계 원칙을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기