번역 기반 다중언어 교차주의를 활용한 저자원 대만어 음성 인식

본 논문은 대만어(타이완어) 드라마 음성을 인식하기 위해, 다국어 번역 임베딩을 ASR 디코더에 병렬 게이트 교차주의(PGCA)로 융합하는 TG‑ASR 프레임워크를 제안한다. 30시간 규모의 YT‑THDC 코퍼스를 새롭게 공개하고, Whisper Small 모델을 두 단계로 미세조정함으로써 문자 오류율(CER)을 14.77 % 상대적으로 감소시켰다.

저자: Cheng-Yeh Yang, Chien-Chun Wang, Li-Wei Chen

본 연구는 대만어(타이완어)와 같은 저자원 언어의 음성 인식 성능을 향상시키기 위해, 번역 정보를 활용한 새로운 프레임워크 TG‑ASR를 제안한다. 대만어 드라마 영상에는 풍부한 음성 데이터가 존재하지만, 자막은 대부분 중국어(만다린)로 제공되어 대만어 전사본이 부족한 상황이다. 이를 해결하고자 저자들은 30시간 규모의 YT‑THDC(Youtube‑sourced Taiwanese Hokkien Drama Corpus) 코퍼스를 구축·공개하였다. 이 코퍼스는 50 000개 이상의 발화와 정확히 검증된 대만어 전사본, 그리고 동일 영상에 대응하는 만다린 자막을 포함한다.

TG‑ASR는 두 가지 핵심 아이디어를 결합한다. 첫째, 다국어 번역 임베딩을 활용해 의미적 보조 정보를 제공한다. 저자들은 SeamlessM4T를 이용해 대만어 음성에 대응하는 다섯 개 보조 언어(만다린, 영어, 힌디어, 스페인어, 프랑스어)의 번역문을 생성하고, 이를 사전 학습된 다국어 BERT(mBERT)로 인코딩해 임베딩 Eₗ을 얻는다. mBERT는 고정된 상태로 사용되어 번역 지식이 변형되지 않으며, 각 언어별 임베딩 차원은 768이다.

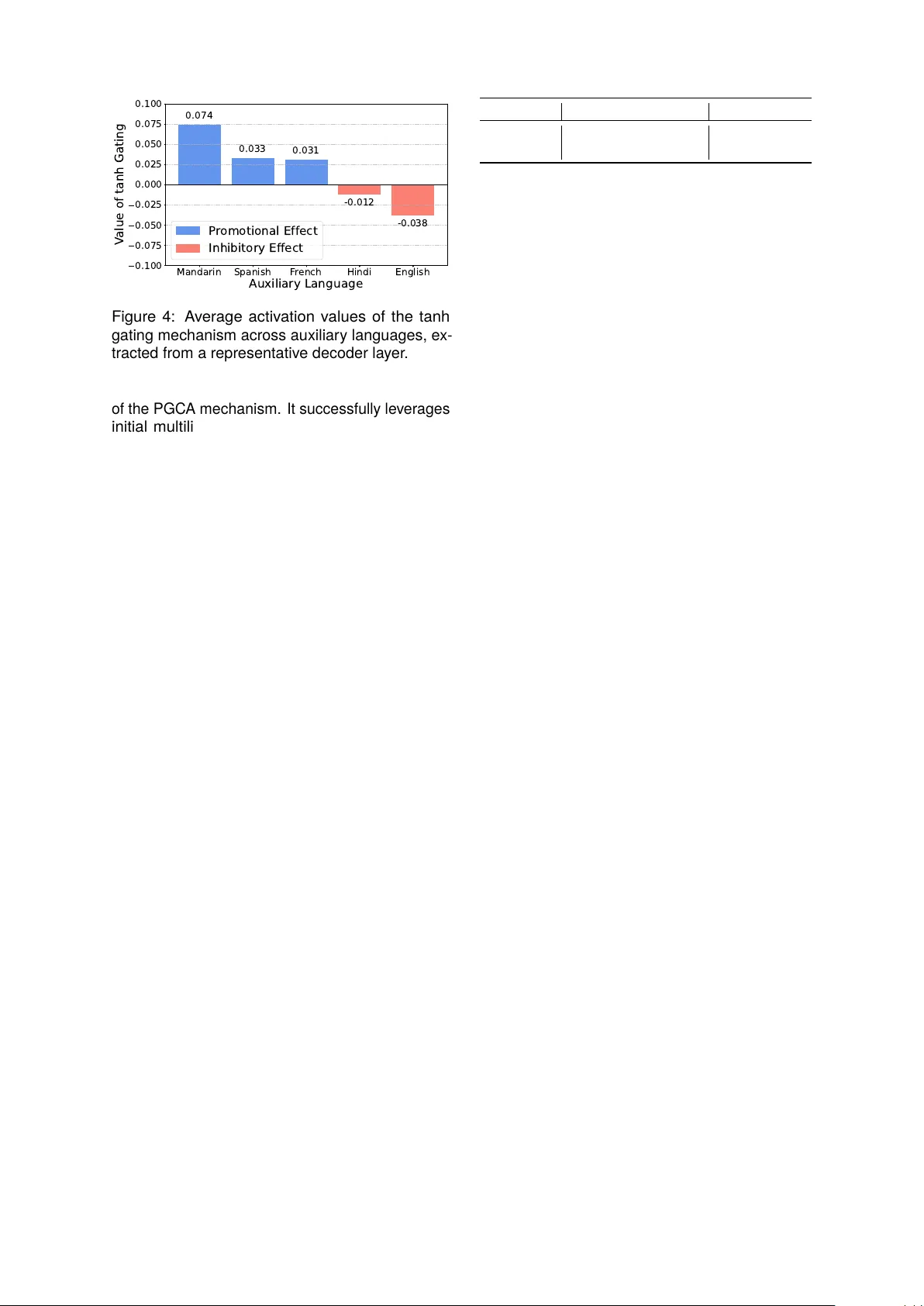

둘째, 이러한 임베딩을 Whisper 디코더에 병렬 게이트 교차주의(PGCA) 메커니즘으로 통합한다. PGCA는 기존 Whisper 디코더 블록의 앞부분에 L개의 독립적인 Cross‑Attention 모듈을 배치하고, 각 모듈은 디코더 입력 Y와 해당 언어 임베딩 Eₗ 사이에 어텐션을 수행한다. 이후 tanh‑gate 파라미터 αₗ^{attn}와 α^{FNN}이 각각 어텐션 결과와 피드포워드 네트워크 출력에 곱해져, 언어별 기여도를 동적으로 조절한다. 모든 게이트 파라미터는 학습 초기에 0으로 초기화돼, 초기 단계에서 과도한 언어 간 간섭을 방지하고 안정적인 최적화를 가능하게 한다.

학습은 두 단계로 진행된다. 1단계에서는 Whisper Small 모델 전체를 대만어 음성 데이터에 대해 fine‑tuning한다(배치 4, 학습률 1.25e‑5, 80 000 스텝). 2단계에서는 첫 단계에서 얻은 디코더 파라미터를 고정하고, PGCA 레이어만을 추가 학습한다(배치 8, 학습률 5.0e‑5, 180 000 스텝). Whisper 인코더와 mBERT는 모두 frozen 상태를 유지한다. 입력 음성은 10초 이하로 제한하고, 80개의 mel‑frequency bins를 사용한다.

평가 지표는 문자 오류율(CER)이며, 교사 강제(teacher‑forcing) 디코딩 환경에서 측정하였다. 베이스라인(A0)은 PGCA 없이 Whisper Small만을 사용했을 때 CER 13.40 %를 기록했다. 보조 언어를 하나씩 추가한 결과, 만다린(GT) 단독 사용 시 CER 11.87 %(11.42 % 상대 감소), 힌디어 13.17 %(1.72 % 감소), 영어 13.10 %(2.24 % 감소), 프랑스어 12.98 %(3.13 % 감소), 스페인어 12.84 %(4.18 % 감소)로 나타났다. 가장 큰 개선은 만다린과 스페인어를 동시에 사용한 A6에서 CER 11.42 %를 달성, 베이스라인 대비 14.77 %의 상대적 감소를 보였다. 이는 서로 다른 언어군이 제공하는 의미적 다양성이 대만어와의 교차 정렬에 시너지 효과를 만든 것으로 해석된다.

본 논문의 주요 공헌은 다음과 같다. (1) 번역 임베딩을 PGCA로 융합해 저자원 언어 ASR에 의미적 보조 정보를 제공하는 새로운 프레임워크 TG‑ASR 제안, (2) 대만어 드라마 음성·전사·만다린 자막을 포함한 30시간 규모의 YT‑THDC 코퍼스 공개, (3) 다국어 보조 정보가 ASR 성능에 미치는 영향을 체계적으로 분석하고, 특히 만다린·스페인어 조합이 가장 큰 효과를 보임을 입증.

한계점으로는 보조 언어 번역 품질에 대한 의존성이 크다는 점이다. 자동 번역 오류가 PGCA 입력에 그대로 반영될 경우, 오히려 성능 저하를 초래할 가능성이 있다. 또한, Whisper Small 모델의 입력 길이 제한과 파라미터 규모가 대규모 실시간 서비스에 적용하기엔 제한적일 수 있다. 향후 연구에서는 (a) 번역 품질 향상을 위한 후처리 및 인간 검증 파이프라인 도입, (b) 가변 길이 입력과 더 큰 Whisper 모델(예: Whisper Large)으로 확장, (c) PGCA를 시각 정보와 결합해 멀티모달 통합을 시도하는 방향을 제시한다.

전반적으로 TG‑ASR는 번역 기반 의미 지도(semantic guidance)를 효과적으로 활용해 저자원 언어의 음성 인식 정확도를 크게 개선했으며, 다국어 교차주의 메커니즘이 향후 다양한 언어·도메인에 적용될 가능성을 보여준다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기