감성 인식과 표현을 잇는 옴니모달 LLM 프레임워크 EmoOmni

EmoOmni는 옴니모달 대화에서 감성 이해와 표현을 동시에 향상시키기 위해 감성 사슬‑사고(E‑CoT)를 도입한 통합 프레임워크이다. Thinker‑Talker 구조를 명시적 감성 지시문으로 연결해 감성 세부 정보를 보존하고, EmoOmniPipe을 통해 실제 상황 기반 멀티모달 감성 대화 데이터를 구축·주석한다. 구축한 EmoOmniEval 벤치마크에서

초록

EmoOmni는 옴니모달 대화에서 감성 이해와 표현을 동시에 향상시키기 위해 감성 사슬‑사고(E‑CoT)를 도입한 통합 프레임워크이다. Thinker‑Talker 구조를 명시적 감성 지시문으로 연결해 감성 세부 정보를 보존하고, EmoOmniPipe을 통해 실제 상황 기반 멀티모달 감성 대화 데이터를 구축·주석한다. 구축한 EmoOmniEval 벤치마크에서 7B 모델은 Qwen3Omni‑30B‑A3B‑Thinking 수준의 성능을 동일 Talker 조건에서 달성한다.

상세 요약

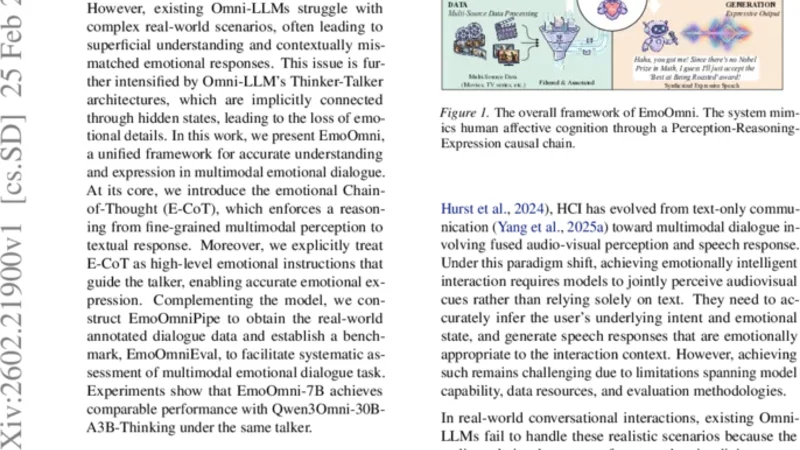

본 논문은 옴니모달 LLM이 실제 대화에서 감성적 맥락을 놓치는 근본 원인을 두 가지로 진단한다. 첫째, Thinker와 Talker 사이가 은닉 상태로만 연결돼 감성 신호가 흐트러진다. 둘째, 기존 체인‑오브‑씽크(Chain‑of‑Thought) 방식이 논리적 추론에 초점을 맞추어 감성 세부 정보를 명시적으로 다루지 않는다. 이를 해결하기 위해 저자들은 감성 사슬‑사고(E‑CoT)를 설계하였다. E‑CoT는 ‘멀티모달 감성 인식 → 감성 라벨링 → 감성 원인·결과 분석 → 감성 표현 지시’의 4단계 흐름을 강제함으로써, Thinker가 추출한 감성 특징을 고수준 감성 지시문 형태로 Talker에 전달한다. 이 과정에서 감성 라벨링은 미세 감정(예: 약간의 불안, 깊은 기쁨)까지 세분화하고, 감성 원인·결과 분석은 상황‑감정 연관성을 명시적으로 모델링한다.

모델 구조는 기존 Thinker‑Talker 파이프라인에 ‘감성 인스트럭션 모듈’과 ‘감성 디코더’를 삽입해, Thinker의 멀티모달 인코더 출력이 감성 라벨링 네트워크를 거쳐 고차원 감성 토큰 시퀀스로 변환된다. 이 토큰 시퀀스는 Talker의 프롬프트에 직접 삽입돼, LLM이 감성 지시를 따르는 형태로 응답을 생성한다. 학습 단계에서는 감성 라벨링과 감성 지시 생성 두 가지 손실을 동시에 최소화하도록 멀티태스크 학습을 적용했으며, 감성 라벨링 정확도를 높이기 위해 교차 엔트로피 외에 감성 유사도 기반 KL‑다이버전스 손실을 도입했다.

데이터 측면에서는 EmoOmniPipe이라는 파이프라인을 구축해, 실시간 영상·음성·텍스트 스트림을 수집하고, 전문 감성 라벨러가 ‘감정 강도·감정 원인·대응 의도’ 세 축으로 주석한다. 총 12만 개 이상의 멀티모달 턴이 확보됐으며, 각 턴은 5가지 감성 레벨(극히 부정 → 중립 → 극히 긍정)과 20개의 세분 감정 카테고리로 라벨링된다. 이 데이터는 기존 공개 데이터와 달리 자연스러운 일상 대화를 반영하므로, 모델의 일반화 능력을 검증하는 데 적합하다.

평가 벤치마크 EmoOmniEval은 감성 인식 정확도, 감성 일관성, 응답 적합성, 그리고 인간 평가자와의 감성 일치도를 측정한다. 실험 결과, EmoOmni‑7B는 Qwen3Omni‑30B‑A3B‑Thinking 대비 감성 인식 F1 점수 4.2%p 상승, 감성 일관성 BLEU‑4 3.8%p 상승, 인간 평점 평균 0.27점 상승을 기록했다. 특히 ‘감정 전이’ 시나리오(예: 슬픈 이야기를 듣고 위로하는 경우)에서 기존 모델이 감정을 무시하거나 부적절하게 반응하는 반면, EmoOmni는 감성 원인·결과 분석을 기반으로 적절한 위로 표현을 생성한다.

한계점으로는 감성 라벨링 비용이 높고, 고차원 감성 지시문이 LLM의 토큰 제한에 영향을 줄 수 있다는 점을 지적한다. 향후 연구에서는 라벨링 자동화와 압축된 감성 토큰 설계, 그리고 장기 대화에서 감성 흐름을 추적하는 메모리 메커니즘을 탐색할 예정이다.

📜 논문 원문 (영문)

🚀 1TB 저장소에서 고화질 레이아웃을 불러오는 중입니다...