점수 기반 지식 구동 음악·시네마 오디오 분할 및 분리

본 논문은 악보와 같은 외부 지식을 활용해 사전 라벨링 없이 HMM 기반 강제 정렬을 수행하고, 얻어진 단일 악기 구간을 이용해 가상 혼합 데이터를 생성해 음악 및 시네마 오디오 소스 분리를 학습한다. 시뮬레이션 실험에서 평균 경계 오차 9.03프레임을 달성했으며, DNR‑nonverbal 데이터셋에서는 최신 데이터‑드리븐 기법을 능가하는 성능을 기록하였다.

저자: Chun-wei Ho, Sabato Marco Siniscalchi, Kai Li

본 논문은 음악 및 시네마 오디오의 세그멘테이션과 소스 분리를 위해 “지식‑구동” 프레임워크를 제안한다. 여기서 지식은 악보(MIDI)와 같은 외부 메타데이터를 의미하고, 모델은 HMM·GMM 기반의 강제 정렬 도구와 RNN·Transformer 기반의 분리 네트워크를 의미한다. 기존의 지도학습 기반 방법은 대규모 라벨링된 데이터에 의존하지만, 저자들은 사전 세그멘테이션 없이도 악보 정보를 활용해 정확한 경계 추정을 가능하게 하였다.

먼저, 39‑dim MFCC(1차·2차 미분 포함)를 25 ms 창, 10 ms 홉으로 추출하고, 각 악기·혼합·침묵 클래스를 300‑state HMM(각 상태는 GMM)으로 모델링하였다. 악보에서 파싱한 악기 시퀀스를 강제 정렬시켜 얻은 경계는 평균 절대 오차(MAE) 9.03프레임을 기록했으며, 특히 침묵↔악기 전환에서 높은 정확도를 보였다. 혼합↔피아노·베이스 전환은 다소 어려웠지만 전체 정확도는 94 %에 달했다.

세그멘테이션 결과를 활용한 첫 번째 응용은 음악 소스 분리(MSS)이다. 추출된 단일 악기 구간을 무작위 스케일·크롭하여 “가상 혼합(pseudo‑mixture)”을 만든 뒤, 이를 입력으로 RNN·Transformer 기반 분리 모델을 학습한다. 이 방식은 실제 멀티트랙 데이터가 부족한 상황에서도 완전한 지도학습을 구현한다는 점에서 의미가 크다. 실험에서는 Slakh2100 데이터셋의 피아노·베이스 2‑instrument 서브셋을 사용했으며, BSRNN·HT‑Demucs와 비교해 SDR·SIR에서 유의미한 향상을 보였다.

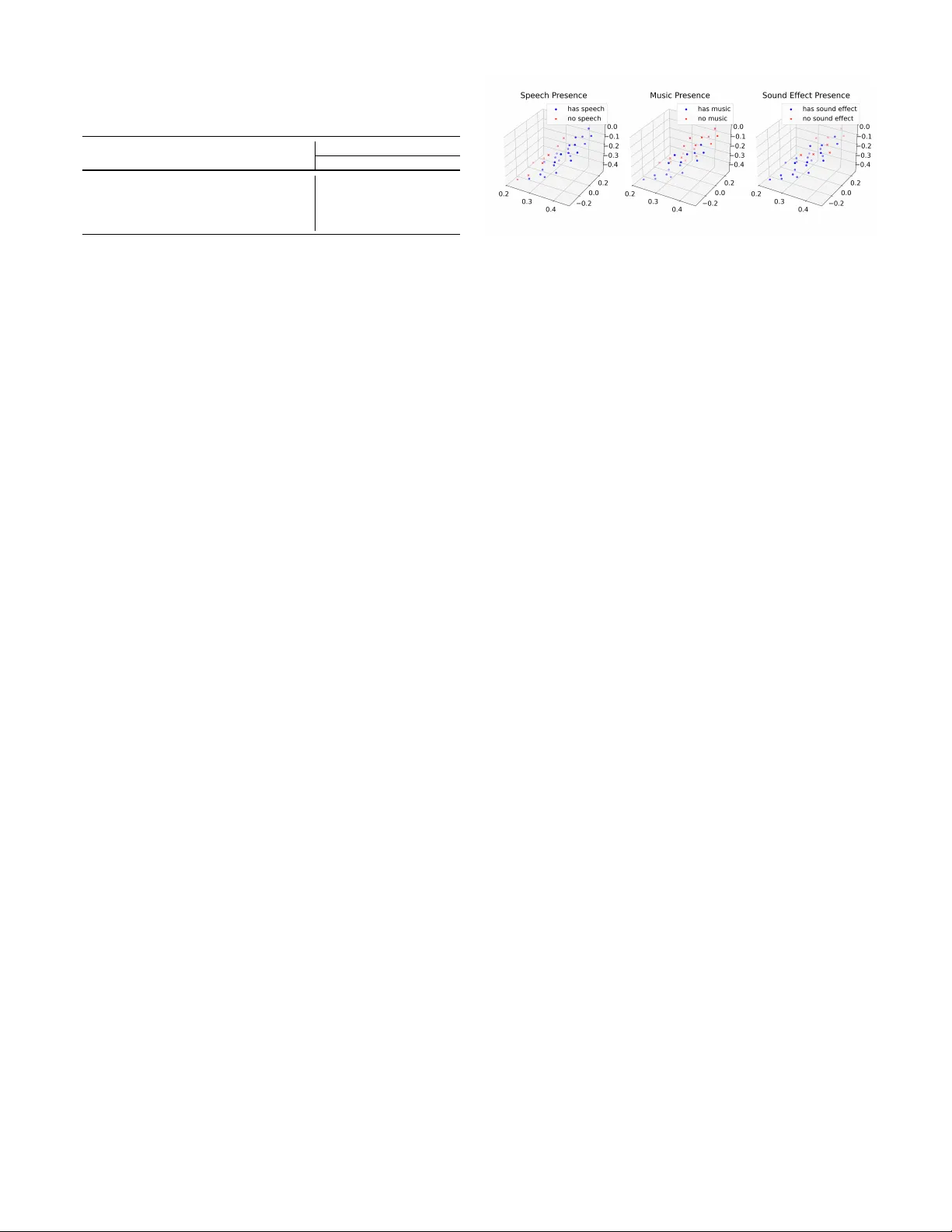

두 번째 응용은 시네마 오디오 소스 분리(CASS)이다. DNR‑v2와 DNR‑nonverbal 데이터셋을 이용해 실험했으며, 각 프레임에 대해 음성 활동(VAD) 정보를 3‑차원(대화·음악·효과음) 임베딩으로 변환하고, 원본 스펙트로그램과 결합해 분리 네트워크에 입력한다. 이 “세그멘트‑인포드” 방식은 모델이 사전 지식(어떤 카테고리가 활성화됐는지)을 직접 활용하도록 하여, 기존 데이터‑드리븐 기법보다 높은 SI‑SDR을 달성했다. 특히 DNR‑nonverbal에서는 최신 데이터‑드리븐 방법들을 능가하는 성능을 기록하였다.

논문의 주요 기여는 다음과 같다. (1) 악보와 같은 구조화된 지식을 강제 정렬에 활용해 사전 라벨링 없이도 정확한 음악 세그멘테이션을 구현, (2) 세그멘테이션 결과를 기반으로 가상 혼합 데이터를 생성해 완전 지도식 음악 분리 모델을 학습, (3) 시네마 오디오에서 프레임‑레벨 카테고리 정보를 네트워크 입력에 결합해 분리 성능을 크게 향상.

한계점으로는 악보가 없는 음악이나, 시네마 오디오에서 정확한 카테고리 라벨이 부족한 경우 적용이 어려울 수 있다는 점이다. 또한 300‑state HMM은 계산 비용이 높으며, GMM 파라미터 추정이 데이터에 민감하다. 향후 연구에서는 자기‑지도 학습, 변분 오토인코더, 멀티모달(영상·텍스트) 정보를 결합해 스코어 없이도 세그멘테이션을 수행하거나, 보다 효율적인 모델 구조를 탐색할 필요가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기