블랙박스 AI 신뢰도 인증: 자기일관성 샘플링과 컨포멀 보정

본 논문은 블랙박스 AI 시스템에 대해 “신뢰도 수준”이라는 단일 수치를 제공한다. 동일 질문을 여러 번 호출해 얻은 답변들의 빈도 순위를 자기일관성 샘플링으로 만들고, 소규모 인간 검증 배치를 이용해 컨포멀 캘리브레이션을 수행한다. 이 과정은 분포에 무관한 유한표본 보장을 제공하며, 모델 내부 정보 없이도 API 호출만으로 배포 게이트를 설계한다. 실험에서는 GPT‑4.1, GPT‑4.1‑nano 등 5개 모델을 5개 벤치마크에 적용해 66.…

저자: Charafeddine Mouzouni

**1. 서론 및 동기**

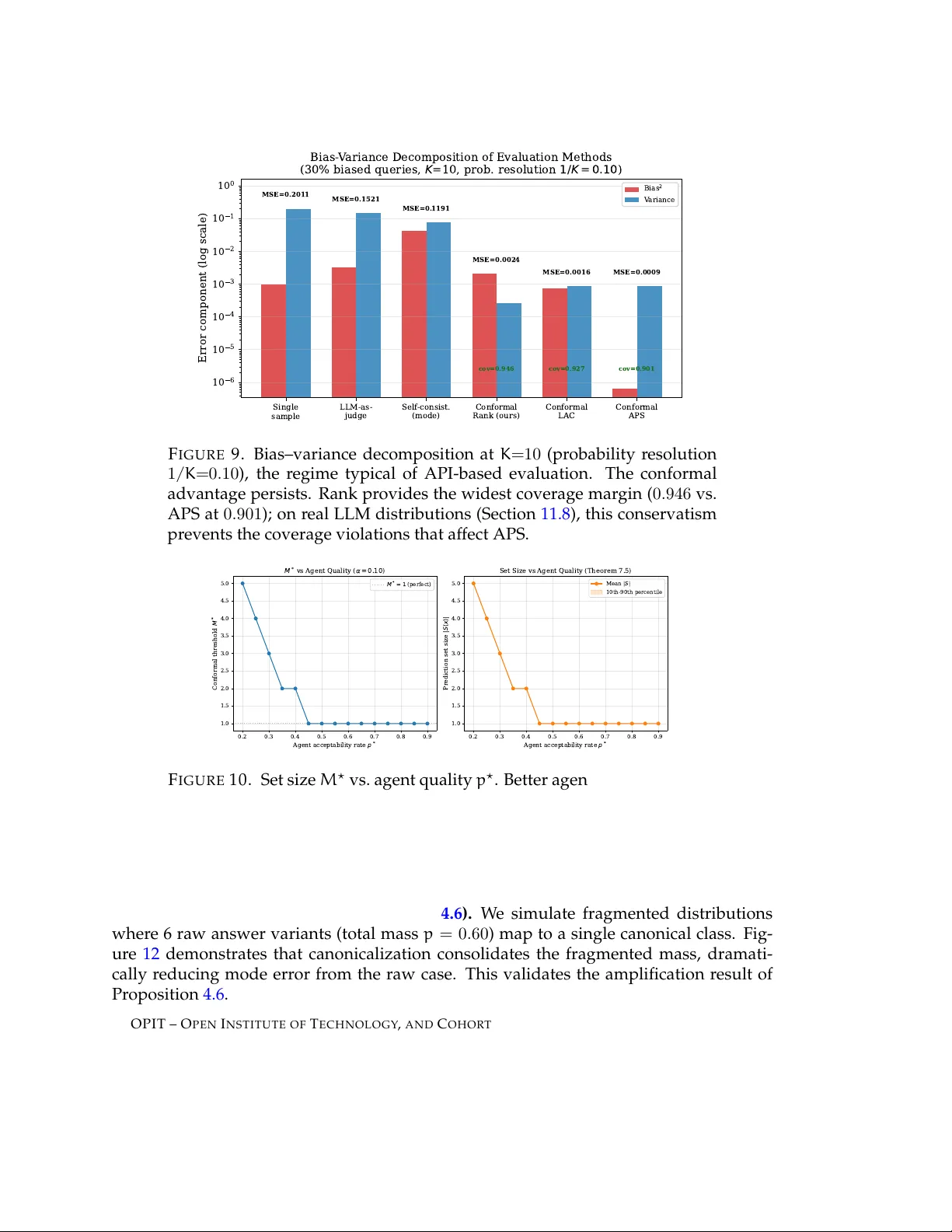

AI 시스템을 실제 서비스에 적용하기 전에 “얼마나 신뢰할 수 있는가”를 정량적으로 판단해야 한다. 기존 방법은 단일 샘플 평가, LLM‑as‑judge, 내부 로그확률 기반의 컨포멀 예측 등으로, 각각 편향·분산 문제를 안고 있다. 특히 상업용 API는 내부 파라미터에 접근할 수 없으므로, 외부에서만 평가할 수 있는 방법이 필요하다.

**2. 문제 정의**

질문 공간 X와 답변 공간 A가 주어지고, Accept(x,a)∈{0,1}으로 정답 여부를 판단한다. 모델 f_θ는 조건부 확률 P_θ(·|x)를 통해 답변을 생성한다. 목표는 각 질문에 대해 예측 집합 S(x)⊂C를 반환해 P(Y∈S(x))≥1‑α를 보장하는 것이다. 여기서 Y는 Accept가 1인 답변이다.

**3. 신뢰도 수준 정의**

신뢰도 수준 1‑α*는 “모드(가장 빈번한 답변)만 사용했을 때 보장되는 최소 커버리지”로 정의된다(정의 2.4). 이는 n개의 캘리브레이션 아이템에 대해 비순응도 점수 s_i(정답이 차지하는 순위)를 계산하고, (1‑α*)‑분위수를 취해 얻는다.

**4. 방법론 파이프라인**

1) 동일 질문을 K번 호출해 답변을 수집한다.

2) 동일 문자열을 그룹화하고 빈도 순으로 정렬한다(자기일관성 샘플링).

3) 작은 캘리브레이션 배치 n≈50–100을 무작위 추출하고, 인간이 최상위 답변이 정답인지 판단한다.

4) 각 아이템에 대해 비순응도 점수 s_i(정답 순위)를 구하고, 컨포멀 캘리브레이션을 적용해 신뢰도 수준 1‑α*를 산출한다.

**5. 이론적 결과**

- **정리 4.4**: K번 샘플링 시 모드 정확도가 1‑exp(‑cK)로 지수적 수렴.

- **정리 7.3**: 비순응도 점수 기반 컨포멀 캘리브레이션은 “분포‑자유, 유한표본” 보장을 제공하며, 커버리지 오류는 ≤1/(n+1).

- **정리 7.5**: 예측 집합 크기는 모델 편향을 직접 드러내는 지표이며, 큰 집합은 모델이 어려운 질문에 대해 불확실함을 의미한다.

- **정리 9.1**: Hoeffding 경계 기반 조기 중단 규칙을 통해 K를 동적으로 감소시켜 API 비용을 평균 50% 절감한다.

**6. 편향·분산 해부**

단일 샘플 평가(E₁)는 편향이 0이지만 분산이 최대 0.25로, 불확실한 질문에서 신뢰도가 낮다. LLM‑as‑judge(E_J)는 판단자 자체의 시스템 편향 b_J와 잡음 η_J를 포함해 편향·분산이 복합적으로 증가한다(정리 3.4). 제안 방법은 비순응도 점수를 순위 기반으로 정의해 편향을 명시적으로 드러내고, K번 샘플링을 통해 분산을 크게 감소시킨다.

**7. 실험**

- **벤치마크**: GSM8K(수학), TruthfulQA(사실성), MMLU(전문 지식) 등 5개.

- **모델**: GPT‑4.1, GPT‑4.1‑nano, Llama 4 Maverick, Mistral Small 24B 등 5개.

- **결과**: GPT‑4.1은 GSM8K에서 94.6%, TruthfulQA에서 96.8%의 신뢰도 수준을 기록. GPT‑4.1‑nano는 GSM8K에서 89.8%, MMLU에서 66.5%를 기록. 전체 조건부 커버리지는 0.93 이상이며, 커버리지 부족은 “해결 불가능한 아이템” 비율과 일치함을 확인.

- **비용 절감**: 순차적 샘플링 적용 시 평균 K가 6~7로 감소, API 호출 비용이 약 50% 절감.

**8. 관련 연구와 차별점**

자기일관성 디코딩

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기