제어 가능한 수술실 영상 합성을 위한 기하학적 추상화와 확산 모델

본 논문은 수술실(OR) 내 일상 및 드문 안전 위협 상황을 인공적으로 생성하기 위해, 인체·환자·장비를 타원형 기하학적 프리미티브로 추상화하고 이를 조건으로 활용하는 비디오 확산 프레임워크를 제안한다. 기하학적 추상화·조건부 모듈·미세조정된 확산 모델을 연계해 현실감 있는 OR 영상을 합성하고, 합성된 데이터로 멸균 구역 위반(near‑miss) 탐지 모델을 학습시켜 70 % 이상의 재현율을 달성하였다.

저자: Dominik Schneider, Lalithkumar Seenivasan, Sampath Rapuri

수술실(OR)은 환자 안전과 병원 운영 효율성에 핵심적인 역할을 하지만, 실제 OR에서 발생하는 드문 안전‑위험 이벤트(예: 멸균 구역 침범, 장비 오인도)를 대규모로 수집하기는 프라이버시·윤리·운영상의 제약으로 매우 어렵다. 이러한 데이터 부족은 OR 환경 인공지능(ambient intelligence) 모델의 개발을 저해한다. 본 논문은 이러한 문제를 해결하고자, OR 영상의 합성을 ‘기하학적 추상화 → 조건부 시퀀스 → 비디오 확산’이라는 3단계 파이프라인으로 구성한 새로운 프레임워크를 제안한다.

첫 번째 모듈인 Geometric Abstraction Module은 SAM2 기반 인스턴스 세그멘테이션과 Video Depth Anything 기반 깊이 추정을 결합해, OR 장면에 등장하는 인물, 환자, 장비 등을 2‑D 중심 좌표와 3‑D 타원(높이·폭·회전) 및 정규화된 깊이값으로 매핑한다. 각 엔티티는 6‑차원 기하학적 속성(g_j)과 2‑차원 클래스 색상(c_j)으로 표현되며, 이를 (R,G) 색채와 (B) 깊이 채널에 인코딩해 1024×768 해상도의 추상 이미지로 렌더링한다. 이 추상 장면은 엔티티 간의 공간·시간 관계를 그래프 G=(V,E) 형태로도 정의할 수 있어, 거리 기반 근접성, 앞뒤 관계(깊이) 등을 자동으로 파악한다.

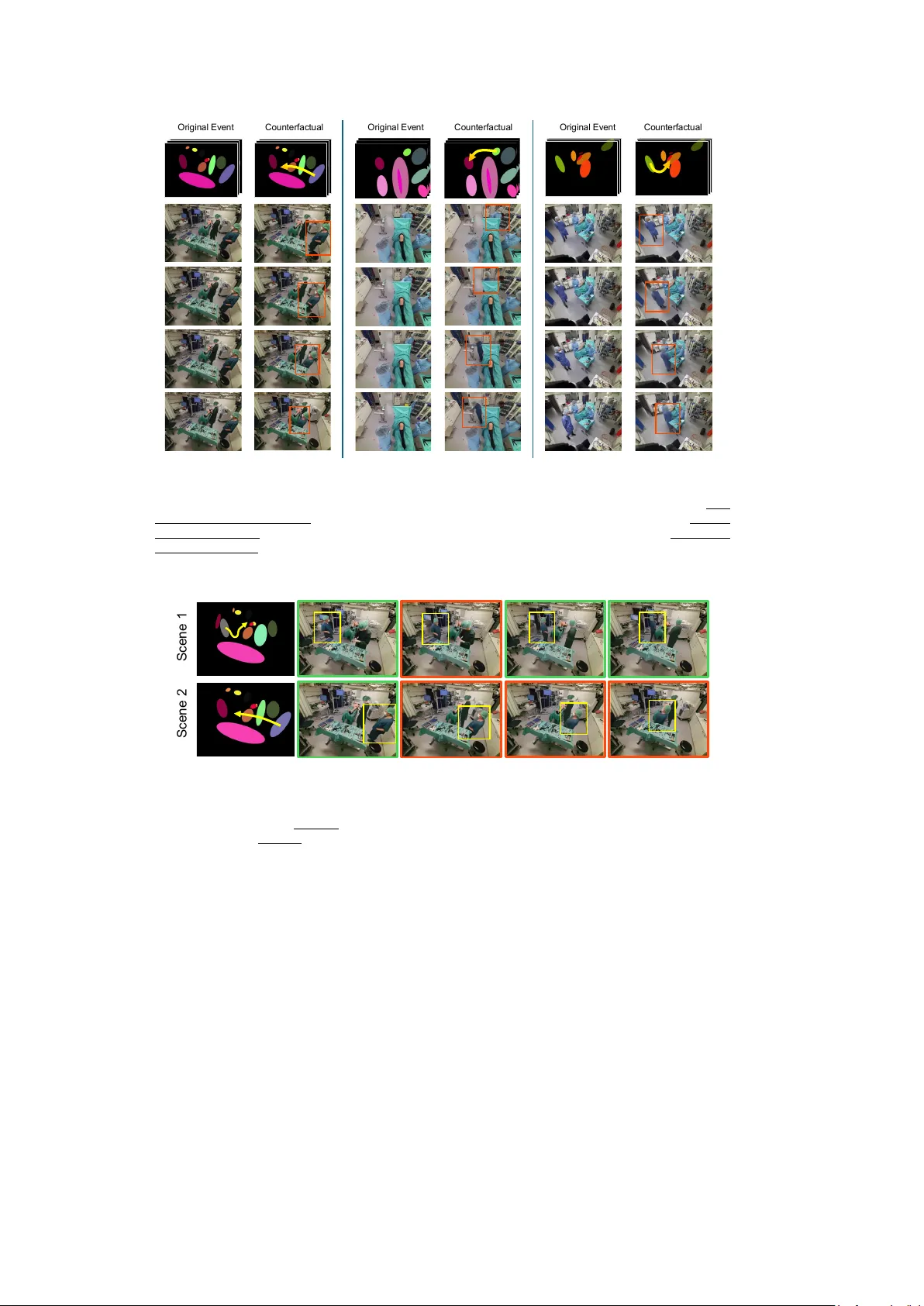

두 번째인 Conditioning Module은 추상 장면 시퀀스를 생성한다. 기존 OR 절차 영상에서 추출한 타임라인을 그대로 사용해 ‘Routine Path’를 만들거나, 사용자가 GUI에서 타원을 선택·드래그하거나 자유곡선으로 궤적을 그려 ‘Counterfactual Path’를 정의한다. 궤적은 프레임마다 선형 보간되어 타원 중심에 적용되며, 이를 통해 인위적으로 드물거나 위험한 상황을 설계한다. 예시로는 수술팀이 환자 쪽이 아닌 기구 테이블 주변을 이동하도록 하는 경우가 있다.

세 번째인 Diffusion Module은 LTX‑Video 기반의 Transformer‑latent 비디오 확산 모델을 사용한다. IC‑LoRA( In‑Context LoRA)를 적용해 비디오‑투‑비디오 조건부 학습을 수행하고, PatchGAN 손실을 추가해 국소 텍스처와 경계선의 사실성을 강화한다. 학습은 8000 스텝, 배치 크기 1, 학습률 2e‑4, LoRA rank/alpha 128, mixed‑precision fp16으로 진행되며, NVIDIA A100 한 대에서 수행된다. 추론 시에는 첫 프레임을 조건으로 제공하고, 전체 추상 시퀀스를 50 denoising step, guidance scale 3.5로 디노이징한다.

실험은 두 공개 데이터셋인 MMOR(내부 도메인)과 4DOR(외부 도메인)에서 수행되었다. 원본 영상은 1 fps를 24 fps로 보간하고, SAM2를 이용해 프레임‑별 세그멘테이션을 일관되게 유지하였다. 평가 지표로는 FVD(프레임‑레벨 동시성), SSIM, PSNR, LPIPS(시각적 품질)와 더불어 Bounding‑Box IoU, Segmentation IoU(조건부 정밀도)를 사용했다. 제안 방법은 기존 텍스트‑조건(SWAN), 이미지‑조건(SVD), 기본 LTX‑Base 대비 FVD를 MMOR에서 689→1190(≈‑42 %), 4DOR에서 265→699(≈‑62 %)로 크게 낮추었으며, SSIM/PSNR도 각각 0.86/23 dB, 0.90/25.9 dB로 향상되었다. LPIPS는 0.13~0.07 수준으로 낮아 시각적 차이가 최소화되었음을 보여준다. 또한, BB IoU와 Seg IoU를 통해 생성 영상이 입력된 타원 궤적과 높은 공간 정렬을 보였으며, 이는 사용자가 정의한 희귀 사건을 정확히 재현할 수 있음을 의미한다.

생성된 합성 데이터셋을 활용해 멸균 구역 위반(sterile‑field violation) 탐지 모델을 학습한 결과, Recall 70.13 %를 달성하였다. 이는 실제 OR에서 드물게 발생하는 near‑miss 이벤트를 탐지하는 데 충분한 성능이며, 데이터 라벨링 비용을 크게 절감하면서도 안전‑중요 AI 모델 개발을 가속화할 수 있음을 입증한다.

본 논문의 주요 기여는 다음과 같다. (1) OR 장면을 타원 기반 기하학적 프리미티브와 깊이 채널로 압축하는 새로운 추상화 방법을 제시, (2) 사용자 정의 궤적을 통해 드물고 위험한 상황을 자유롭게 생성할 수 있는 조건부 모듈을 구현, (3) IC‑LoRA와 PatchGAN을 결합한 비디오 확산 모델을 미세조정해 고품질·고정밀 합성 영상을 얻음, (4) 합성 데이터 기반 안전 이벤트 탐지 모델을 구축해 실용적인 성능을 검증. 향후 실제 OR 로봇 보조, 시뮬레이터, 교육용 데이터 증강, 그리고 다른 의료 분야(예: 응급실, 중환자실)로의 확장 가능성이 크다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기