최적화 알고리즘이 신경망 손실 지형에 미치는 영향

본 연구는 확률적 경사 하강법(SGD)과 제한 메모리 BFGS에 골든 섹션 서치를 결합한 L‑BFGS‑GSS 두 최적화 기법이 MNIST 데이터셋을 이용한 네 가지 신경망 구조(FCP, LeNet CNN, LSTM, 오토인코더)에서 찾아낸 파라미터 집합의 손실 지형 특성을 비교한다. 차원 축소(kPCA)와 새롭게 제안한 FourierPathFinder를 활용해 최적점 사이의 장벽 높이와 경로를 시각화한 결과, SGD는 낮은 장벽과 부드러운 베이…

저자: Jianneng Yu, Alex, re V. Morozov

본 논문은 신경망 학습 과정에서 사용되는 최적화 기법이 손실 지형(loss landscape)의 구조와 모델 일반화 성능에 미치는 영향을 체계적으로 분석한다. 연구자는 네 가지 대표적인 신경망 아키텍처—두 개의 은닉층을 가진 완전 연결 퍼셉트론(FCP), LeNet 구조의 합성곱 신경망(CNN), 48개의 은닉 유닛을 갖는 LSTM, 그리고 2‑계층 인코더·디코더를 가진 샬로우 오토인코더—를 선택하고, 모두 MNIST 손글씨 데이터셋(훈련 5만 장, 테스트 1만 장)으로 학습한다.

두 가지 최적화 방법을 비교한다. 첫 번째는 미니배치(64) 기반의 확률적 경사 하강법(SGD)이며, 두 번째는 제한 메모리 BFGS(L‑BFGS)에 골든 섹션 서치(GSS)를 결합한 L‑BFGS‑GSS이다. L‑BFGS‑GSS는 1차 미분 정보와 근사 2차 정보를 동시에 활용해 검색 방향을 결정하고, 파라미터 업데이트 스텝 크기를 파생 없이 효율적으로 찾는다. 두 방법 모두 조기 종료를 적용해 과적합을 방지한다.

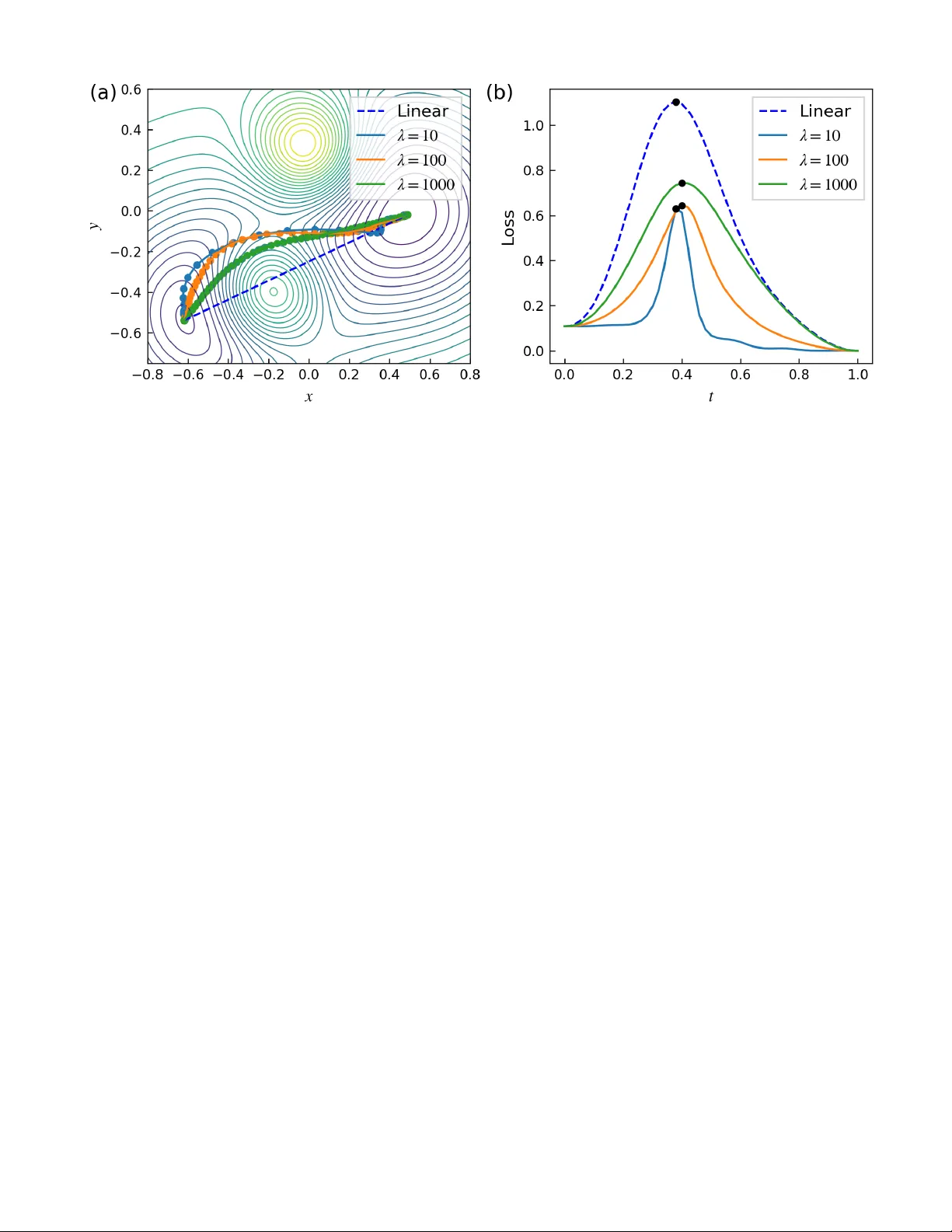

학습이 완료된 후, 각 최적화 방법이 만든 파라미터 집합을 손실 지형 상에서 시각화하고 비교한다. 이를 위해 저자들은 (1) 커널 주성분 분석(kPCA, RBF 커널, σ² = N_prm)으로 고차원 파라미터를 2차원에 투영하고, (2) FourierPathFinder라는 새로운 경로 탐색 알고리즘을 개발해 두 파라미터 사이의 저손실 경로와 장벽 높이(barrier height)를 측정한다. FourierPathFinder는 직선과 10차까지의 사인 푸리에 급수를 결합한 곡선을 최적화함으로써, 경로상의 누적 손실과 매끄러움 제어항(λ=10⁻⁴)을 최소화한다. 경로의 최대 손실 H는 두 최적점 사이의 장벽을 정량화한다.

실험 결과는 다음과 같다. (1) 손실 깊이 측면에서 L‑BFGS‑GSS는 SGD보다 훨씬 낮은 훈련 손실을 달성한다. 예를 들어 FCP 모델에서 L‑BFGS‑GSS는 평균 훈련 손실 0.018을, SGD는 0.042를 기록했다. 그러나 테스트 정확도는 두 방법이 조기 종료를 적용했을 때 비슷했으며, L‑BFGS‑GSS가 훈련 손실을 과도하게 최소화하면 테스트 정확도가 급격히 감소한다. (2) 파라미터 공간에서의 분포는 크게 다르다. kPCA 시각화에서 L‑BFGS‑GSS 해들은 서로 멀리 떨어진 여러 클러스터를 형성하고, SGD 해들은 상대적으로 밀집된 하나의 클러스터를 만든다. 이는 L‑BFGS‑GSS가 더 높은 차원의 “깊은 골짜기”에 도달하지만, 그 골짜기들이 서로 간에 높은 장벽을 가지고 있음을 의미한다. (3) FourierPathFinder를 이용한 장벽 측정에서도 동일한 경향이 확인된다. 동일 아키텍처 내에서 SGD 해들 사이의 평균 장벽 높이(H_SGD)는 0.12~0.18 수준인 반면, L‑BFGS‑GSS 해들 사이의 평균 장벽(H_L‑BFGS)은 0.40~0.55 수준으로 현저히 높았다. 이는 L‑BFGS‑GSS가 찾은 최소점이 서로 독립적인 영역에 위치함을 시사한다.

또한, L‑BFGS‑GSS가 찾은 최소점은 파라미터 변동에 대한 민감도가 높아 “날카로운(minima)” 형태를 띠는 경우가 많다. 이는 기존 연구에서 평탄한 최소점이 일반화에 유리하다는 주장과 일치한다. 반면 SGD는 작은 배치 크기와 노이즈가 있는 그래디언트 업데이트 덕분에 손실 지형의 평탄한 골짜기를 탐색하고, 결과적으로 파라미터 변동에 강인한 해를 제공한다.

논문은 이러한 차이가 실제 모델 설계와 학습 전략에 어떤 함의를 갖는지 논의한다. 만약 목표가 최저 훈련 손실을 달성하는 것이라면 L‑BFGS‑GSS와 같은 2차 기반 최적화가 유리할 수 있다. 그러나 일반화와 견고함이 중요한 실용적 상황에서는 SGD와 같은 1차 기반, 노이즈가 섞인 최적화가 더 적합하다. 또한, 손실 지형 탐색을 위한 도구로 FourierPathFinder와 kPCA를 제시함으로써, 향후 다양한 최적화 알고리즘 간의 구조적 차이를 정량적으로 비교할 수 있는 방법론을 제공한다.

결론적으로, 최적화 알고리즘 선택은 손실 지형 탐색 경로, 최소점의 깊이와 평탄성, 그리고 파라미터 간 장벽 구조에 결정적인 영향을 미친다. SGD는 낮은 장벽과 부드러운 베이스를 형성해 일반화에 유리한 반면, L‑BFGS‑GSS는 더 깊고 고립된 최소점을 찾아내지만 일반화 성능은 저하될 위험이 있다. 이러한 통찰은 새로운 최적화 기법 개발, 학습 스케줄링 설계, 그리고 모델 선택에 있어 중요한 지침이 될 것이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기