상관 네트워크의 인접 스펙트럼 임베딩: 푸리에 계수 학습으로의 해석

본 논문은 시계열 데이터를 기반으로 만든 상관 네트워크가 저차원 잠재 구조를 갖는다는 것을 이론적으로 증명한다. 시계열이 제한된 푸리에 기저로 표현될 때, 상관 행렬은 푸리에 계수들의 저랭크 행렬로 분해될 수 있다. 또한, 노이즈가 섞인 관측 시계열에 대해 인접 스펙트럼 임베딩(ASE)을 적용하면, 적절한 조건 하에 실제 푸리에 계수를 복원할 수 있음을 보인다.

저자: Keith Levin

본 논문은 시계열 기반 가중 네트워크, 즉 상관 네트워크에 대한 통계적 이해를 새롭게 제시한다. 전통적인 네트워크 모델(예: SBM, RDPG)은 엣지가 잠재 변수에 조건부 독립적으로 생성된다고 가정한다. 그러나 실제로는 동일한 시계열이 여러 엣지에 동시에 사용되기 때문에 이 가정이 크게 위배된다. 그럼에도 불구하고, 연구자들은 인접 스펙트럼 임베딩(ASE)과 같은 방법을 적용해 성공적인 결과를 얻어 왔다. 논문은 이러한 경험적 성공을 이론적으로 뒷받침한다.

먼저, 저자는 n개의 길이 T 시계열 Z★₁,…,Z★ₙ을 정의하고, 관측 시계열 Zᵢ = Z★ᵢ + Nᵢ (Nᵢ는 독립적인 측정 노이즈) 로 모델링한다. 각 시계열을 평균 제거하고 표준편차로 정규화한 행렬 eZ★를 만든 뒤, 상관 행렬 R★ = eZ★ eZ★ᵀ 로 정의한다. 이때, 푸리에 변환 Ω를 적용하면 eZ★ = (1/√T) F★ Ω 로 표현되며, F★는 각 시계열의 푸리에 계수 행렬이다. 푸리에 변환의 유니터리성으로부터 R★ = (1/T) F★F★ᴴ 라는 저랭크 형태가 도출된다.

핵심 가정은 모든 시계열이 d₀개의 푸리에 기저(주파수)만으로 정확히 표현 가능하다는 것이다. 이 경우 F★는 최대 2d₀개의 비제로 열을 가지며, 따라서 R★의 랭크는 d ≤ 2d₀가 된다. 고유값 분해 R★ = U★Λ★U★ᵀ 를 수행하고 X★ = U★Λ★¹ᐟ² 를 정의하면, X★X★ᵀ = R★ 가 성립한다. 이는 전통적인 저차원 잠재 변수 모델과 동일한 구조이며, X★는 각 노드가 가지고 있는 푸리에 계수(실수·허수 부분을 포함)의 저차원 표현이다.

다음으로, 실제 관측된 상관 행렬 R은 노이즈가 섞인 Z를 사용해 R = (1/T) Σ⁻¹ᐟ² Z M Zᵀ Σ⁻¹ᐟ² 로 만든다. 저자는 N이 평균 0, 독립이며 분산이 충분히 작을 경우, R = R★ + E 형태로 쓸 수 있음을 보인다. 여기서 E는 평균 0인 교란 행렬이며, 기존 ASE 이론이 요구하는 조건(평균 0, 독립 혹은 약한 의존, 적절한 스펙트럼 노름)과 일치한다.

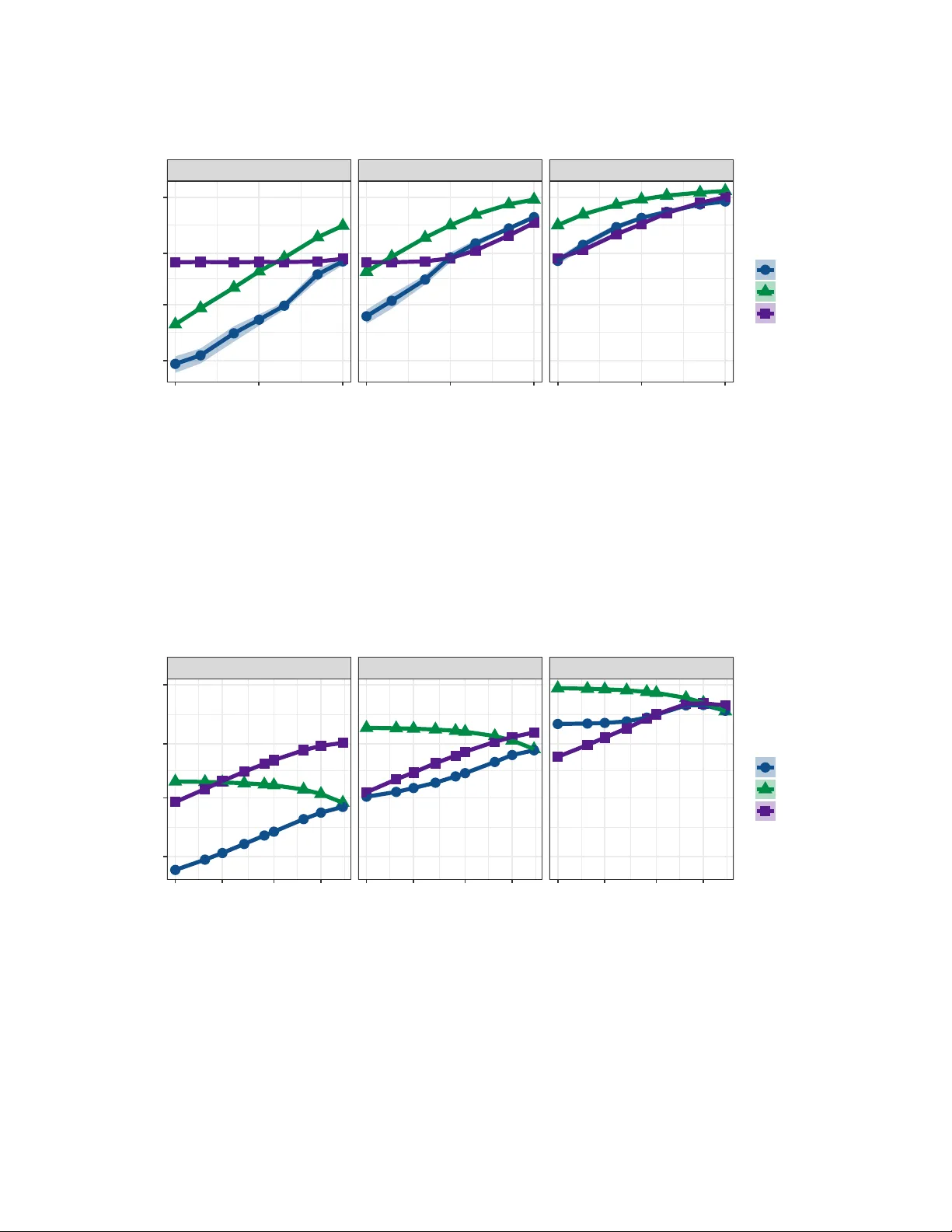

정리 1에서는 이러한 조건 하에 ASE(R, d) 가 X★와 정규 직교 변환 Q∈O(d) 뒤에 거의 동일하게 수렴함을 증명한다. 수렴 속도는 샘플 길이 T와 노이즈 수준에 따라 O_p(√(log n / T) + 1/√T) 로 제시된다. 즉, T가 충분히 크고 노이즈가 적당하면, ASE는 실제 푸리에 계수를 거의 정확히 복원한다.

이론적 결과는 실무적 함의를 가진다. 첫째, 상관 네트워크에 대한 “엣지 독립성 무시”라는 경험적 관행이 수학적으로 정당화된다; 실제로는 푸리에 계수라는 저차원 구조가 존재하므로, 독립성 가정이 없어도 ASE가 의미 있는 잠재 좌표를 제공한다. 둘째, 네트워크 분석가들은 상관 행렬을 직접 임베딩함으로써 시계열 데이터의 주요 주파수 성분을 추정할 수 있다. 이는 뇌 연결망(혈액산소 수준의 상관), 금융 자산(가격 변동 상관), 미생물 군집(종 풍부도 상관) 등 다양한 분야에 바로 적용 가능하다.

마지막으로, 논문은 현재의 임베딩 방법을 푸리에 기반 잠재 구조와 연결함으로써, 향후 연구가 다음과 같은 방향으로 확장될 수 있음을 제시한다. (1) 비선형 변환(웨이브렛, 사전학습된 딥러닝 기저)으로 일반화, (2) 시간에 따라 변하는 네트워크(동적 상관)에서의 연속적 잠재 구조 추정, (3) 비정규화된 상관(예: 부분 상관)이나 공분산 행렬에 대한 유사한 이론 구축. 이러한 확장은 현재의 결과가 네트워크 과학과 신호 처리 사이의 교량 역할을 수행함을 보여준다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기