푸시섬 기반 분산 최적화의 안정성 및 일반화

본 논문은 방향성 그래프 상에서 동작하는 푸시섬 기반 분산 학습 알고리즘인 Stochastic Gradient Push(SGP)의 유한 반복 안정성 및 일반화 오차를 이론적으로 분석한다. 저자는 정규화된 불균형 파라미터 δ와 스펙트럼 갭 (1‑λ)를 이용해 합의 편차를 정밀히 제어하는 일관성 경계를 제시하고, 이를 바탕으로 convex와 Polyak‑Łojasiewicz(PL) 조건을 만족하는 비convex 문제에 대한 최적화 및 일반화 수렴률…

저자: Yifei Liang, Yan Sun, Xiaochun Cao

본 논문은 방향성(비대칭) 통신 그래프 위에서 동작하는 푸시섬 기반 분산 최적화 알고리즘인 Stochastic Gradient Push(SGP)의 유한 반복 안정성 및 일반화 특성을 체계적으로 분석한다. 기존 연구는 주로 수렴 속도와 최적화 정확도에 초점을 맞추었으나, 실제 학습 시스템에서는 반복 횟수가 제한된 상황에서 알고리즘의 안정성(데이터 교체에 대한 민감도)과 일반화 오차가 핵심 이슈가 된다. 특히, 열‑확률적(column‑stochastic) 혼합 행렬을 사용하는 푸시섬 프로토콜은 균일 평균 보존이 깨지면서 구조적 편향을 유발한다. 이러한 편향을 정량화하고, 일반화에 미치는 영향을 규명하는 것이 본 연구의 주요 목표이다.

1. **토폴로지 특성 정의**

- **불균형 파라미터 δ**: 그래프의 stationary distribution π의 최소값을 정규화한 값으로, δ = 1/m이면 그래프가 균형(balanced)하고 푸시섬 보정이 불필요함을 의미한다. δ < 1/m인 경우에는 열‑확률적 매트릭스가 균일 평균을 보존하지 않으므로, 푸시섬 정규화가 필수적이다.

- **스펙트럼 갭 1‑λ**: 전이 행렬의 두 번째 큰 고유값 λ에 대한 보완으로, 혼합 속도를 나타낸다. 갭이 클수록(λ이 작을수록) 합의가 빠르게 이루어진다.

2. **일관성 경계(Lemma 9)**

저자는 푸시섬 프로토콜의 합의 편차를 두 파라미터 δ와 (1‑λ)로 분리하여 O(1/(δ(1‑λ))) 수준으로 제한한다. 이는 기존 대칭 그래프에서 O(1/(1‑λ))에 해당하는 결과를 일반화한 것으로, 불균형이 심할수록 합의 오차가 크게 증가함을 수식적으로 보여준다.

3. **안정성 분석**

- **Uniform Stability 프레임워크**를 적용해, 데이터 하나를 교체했을 때 알고리즘 출력이 얼마나 변하는지를 ε_stab으로 정의한다.

- **Convex 손실**에 대해 상수 스텝 사이즈 γ를 사용할 경우, ε_stab = O(γ/(δ(1‑λ)))·T 로 선형적으로 증가한다. 이는 반복 횟수가 늘어날수록 불균형·느린 혼합이 안정성을 크게 악화시킨다.

- **감소 스텝 사이즈(γ_t ∝ 1/t)**를 적용하면 ε_stab = O(γ log T) 수준으로 완화된다.

4. **최적화 및 일반화 경계**

- **Convex 경우**: 최적화 오차는 O(1/(mn))와 같은 통계적 항과 O(γ C_λ / δ) 형태의 토폴로지 편향 항으로 분해된다. 여기서 C_λ ≈ 1/(1‑λ)이다.

- **PL(Polyak‑Łojasiewicz) 조건**: 비convex이지만 PL을 만족하는 경우, 수렴 속도는 강한 convex와 유사하게 선형(지수) 수렴을 보이지만, 상수에 κ·(1 + 1/(δ(1‑λ)))가 곱해진다. 즉, 문제 조건수 κ와 토폴로지 불균형이 동시에 영향을 미친다.

- **조기 종료 최적화**: 전체 과잉 위험을 통계적 항 + 토폴로지 편향 항으로 분해하고, 두 항을 동시에 최소화하는 최적 반복 횟수 T* ≈ √(mn δ(1‑λ))/γ 를 도출한다. 이때 최소 위험은 O(1/√(mn) + γ/(δ(1‑λ))) 수준이다.

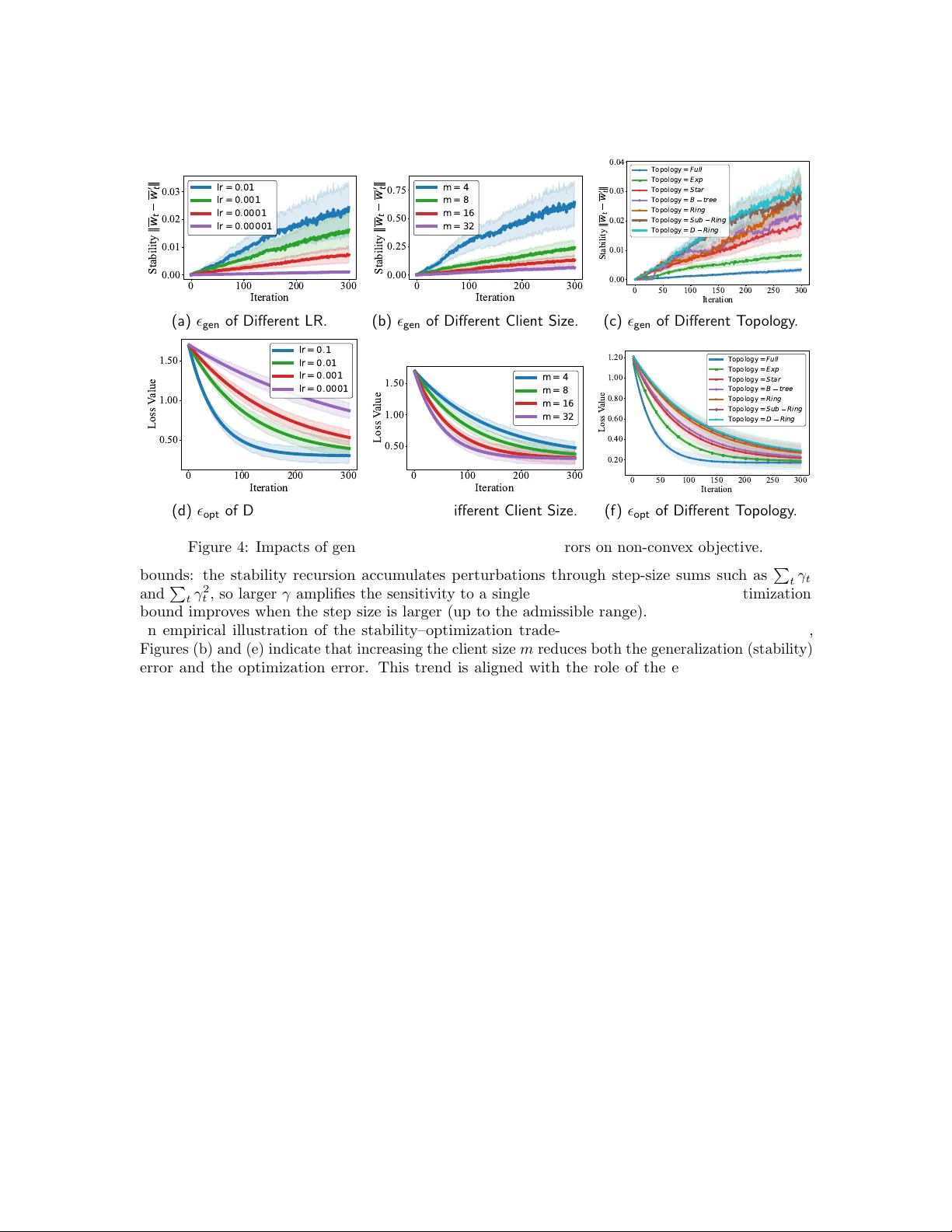

5. **실험 검증**

- **Logistic Regression (a9a)**와 **CIFAR‑10 (LeNet)**을 사용해 다양한 방향성 그래프(원형, 스타, 비균형 랜덤)에서 SGP와 D‑SGD를 비교하였다.

- δ가 작고 λ이 1에 가까운(혼합이 느린) 그래프에서는 D‑SGD가 편향을 크게 누적시켜 일반화 오차가 급증함을 확인했다. 반면, SGP는 푸시섬 정규화를 통해 편향을 보정하고, 이론적 예측과 일치하는 일반화 성능을 보였다.

- 스텝 사이즈 스케줄에 따라 조기 종료 시점이 달라지는 현상도 관찰했으며, 제시된 T*와 실제 최적 성능이 근접함을 실증했다.

6. **의의 및 한계**

- **의의**: 기존의 대칭 그래프 기반 안정성·일반화 분석을 방향성 그래프에 확장하면서, 불균형 파라미터 δ와 스펙트럼 갭 (1‑λ)를 명시적으로 분리해 토폴로지 특성이 학습 성능에 미치는 영향을 정량화했다. 이는 실제 비대칭 통신 환경(예: 무선 센서 네트워크, 엣지 컴퓨팅)에서 알고리즘 설계와 파라미터 튜닝에 실용적인 가이드라인을 제공한다.

- **한계**: 분석은 주로 i.i.d. 데이터와 고정된 그래프 구조를 가정한다. 동적 토폴로지 변화, 비동기 통신, 그리고 비정규화된 손실(예: 비스무스) 등에 대한 확장은 향후 연구 과제로 남는다.

결론적으로, 본 논문은 푸시섬 기반 분산 최적화가 방향성 그래프에서 안정성과 일반화 측면에서 어떤 제약을 갖는지 명확히 밝히고, 불균형·느린 혼합을 보정하기 위한 설계 원칙과 조기 종료 전략을 제시함으로써, 이론과 실험을 아우르는 포괄적인 이해를 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기