맥락 기반 안전 추론 및 실시간 적용을 위한 CORE 프레임워크

초록

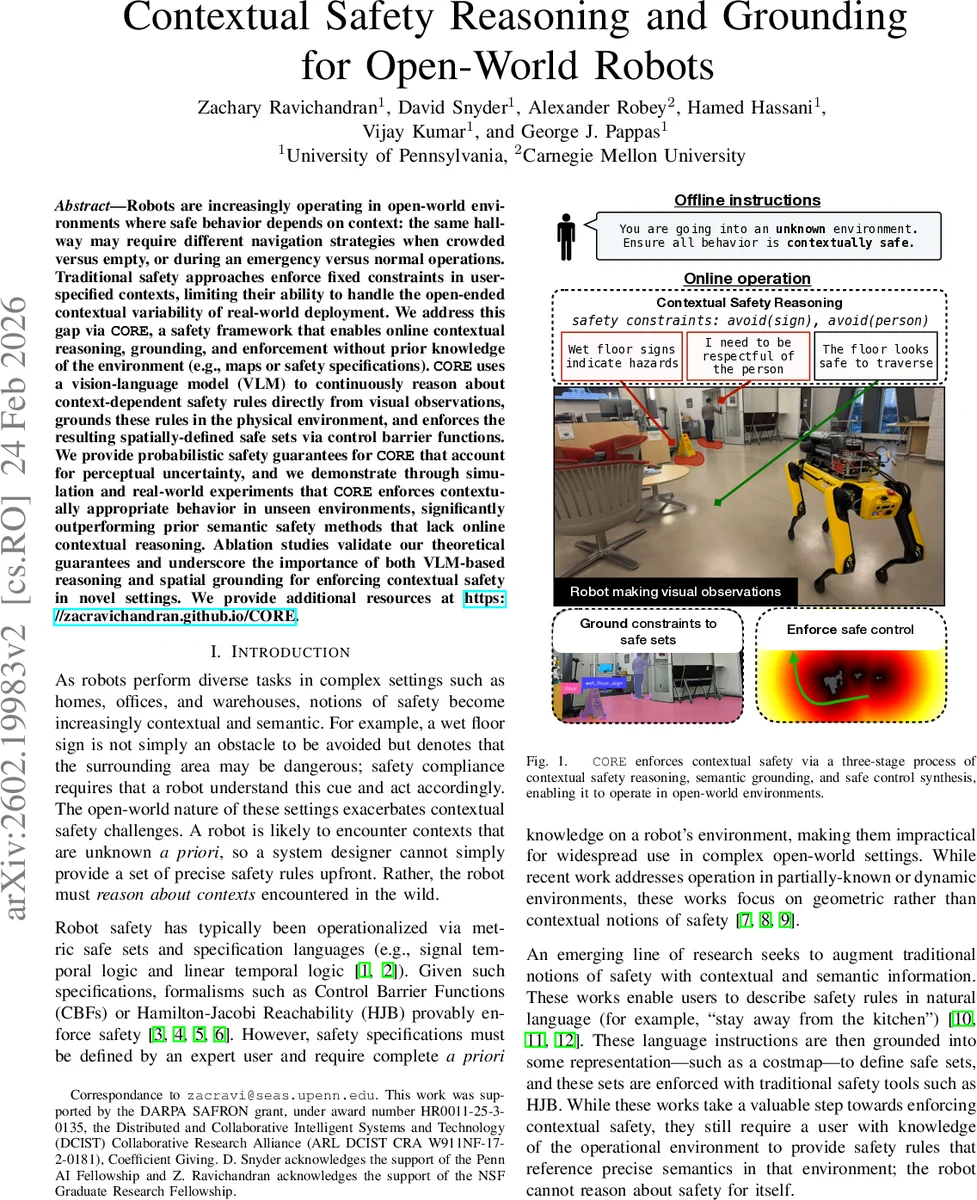

CORE는 비전‑언어 모델(VLM)을 이용해 로봇이 관찰한 영상에서 상황‑특정 안전 규칙을 자동으로 추론하고, 이를 실시간으로 물리적 공간에 매핑한 뒤 제어 장벽 함수(CBF)로 안전 제어를 수행한다. 인식 불확실성을 확률적 안전 보장에 포함시켜, 사전 지도나 사전 정의된 안전 규칙 없이도 새로운 환경에서 맥락에 맞는 안전 행동을 구현한다.

상세 분석

본 논문은 로봇이 사전 지식 없이도 “맥락 기반 안전”을 달성할 수 있도록 세 가지 핵심 모듈을 결합한 프레임워크 CORE를 제안한다. 첫 번째 모듈은 최신 비전‑언어 모델을 활용해 실시간 영상에서 위험 신호(예: 젖은 바닥 표지, 사람, 장애물 등)를 식별하고, “ON”, “NEAR”, “AROUND”, “BETWEEN”과 같은 공간 연산자를 결합한 구조화된 안전 술어 집합을 생성한다. 이때 VLM은 단순 객체 인식에 그치지 않고, 상황에 맞는 연산자를 선택하고 체인‑오브‑생각 형태의 정당성을 제공함으로써 추론의 신뢰성을 높인다.

두 번째 모듈인 의미적 그라운딩은 오픈‑보캘러리 세그멘테이션 모델을 통해 VLM이 제시한 클래스에 대한 픽셀 마스크를 얻고, 각 연산자에 맞는 형태학적 변환(예: AROUND은 팽창, BETWEEN은 볼록 껍질)으로 이미지 공간에서 안전·위험 영역을 구분한다. 깊이 정보를 이용해 이 픽셀 집합을 3‑D 포인트 클라우드로 투사하고, 로봇 작업 공간을 2‑D 그리드로 이산화한다. 각 셀에 안전·위험 포인트 수를 누적해 베이지안 방식으로 “셀 이 안전할 확률”을 추정하고, 사전 정의된 임계값 τ를 넘는 셀을 최종 안전 집합 S 로 정의한다.

세 번째 모듈은 제어 장벽 함수(CBF)를 기반으로 안전 제어 입력 u_safe 를 합성한다. h(x) 를 S 의 부호 거리 함수로 정의하고, 전방 불변성을 만족하도록 1‑계 제한식(Quadratic Program) 형태로 nominal control u_nom 과의 편차를 최소화한다. 핵심은 인식 불확실성을 확률적 안전 보장으로 정량화한 점이다. 논문은 h(x) 가 확률적 경계에 의해 변동할 때, K‑step 내 안전 집합을 벗어날 확률이 δ 이하가 되도록 보장하는 정리를 제시한다. 이는 기존 CBF가 상태·동역학 불확실성만을 고려한 것과 달리, perception‑driven barrier construction 의 불확실성을 직접 모델링한다는 점에서 혁신적이다.

실험에서는 시뮬레이션과 실제 로봇(모바일 베이스)에서 CORE가 사전 정의된 “oracle” 규칙과 비교해 5배 이상 높은 안전 성공률을 보였으며, 맥락이 바뀔 때(예: 혼잡한 복도 vs. 비혼잡 복도, 비상 상황 vs. 정상 상황) VLM이 자동으로 규칙을 전환한다는 점을 입증했다. Ablation 연구에서는 VLM 추론 없이 단순 세그멘테이션만 사용하거나, 그라운딩 없이 직접 CBF에 입력했을 때 안전 보장이 크게 약화됨을 확인했다.

한계점으로는 VLM의 추론 오류가 전체 파이프라인에 전파될 위험, 실시간 성능을 위해 연산량을 제한해야 하는 점, 그리고 복합적인 다중 에이전트 상황에서의 맥락 충돌 해결이 아직 미비함을 언급한다. 향후 연구는 VLM‑CBF 간의 공동 최적화, 멀티‑모달(음성·텍스트) 컨텍스트 통합, 그리고 대규모 현장 테스트를 통한 일반화 검증을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기