TD 학습의 통계적 추론 고차원 베리 에센 정리와 온라인 분산 추정

초록

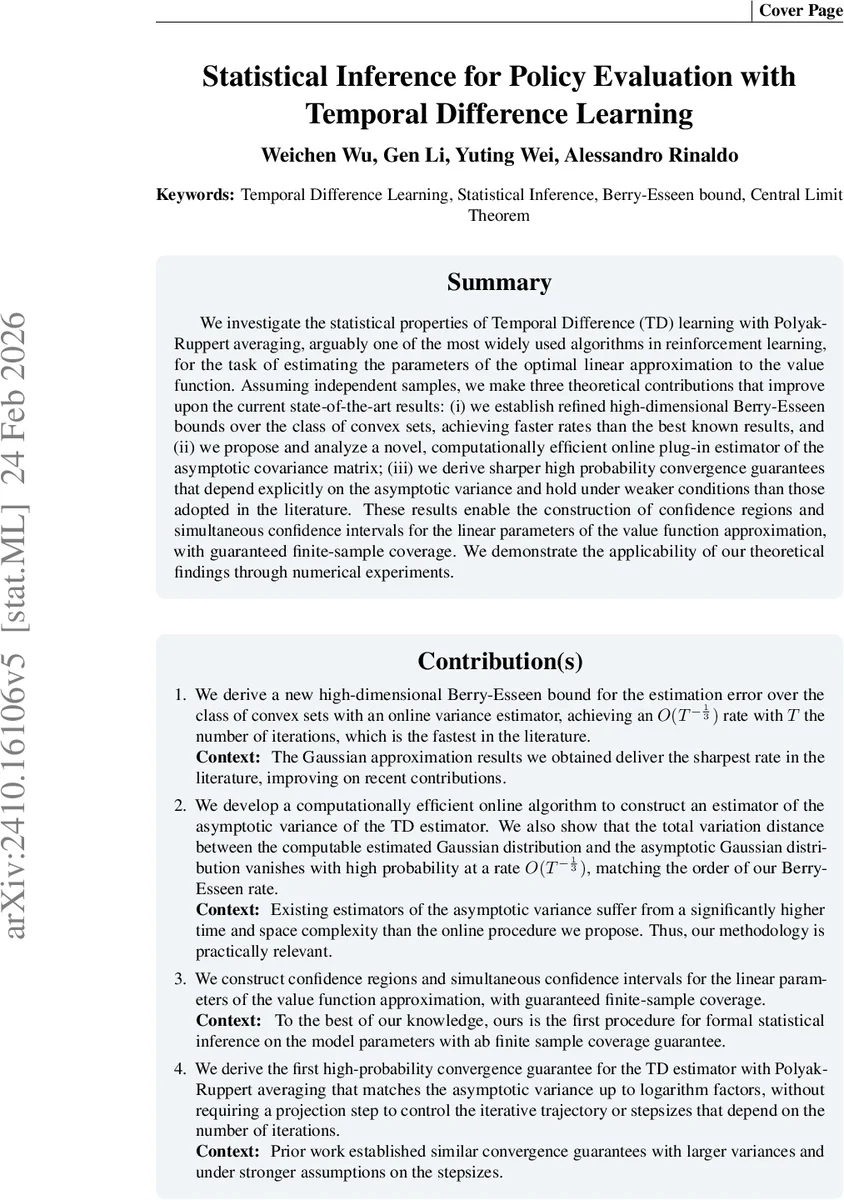

본 논문은 i.i.d. 샘플을 가정한 선형 함수 근사 TD(Temporal Difference) 학습에 Polyak‑Ruppert 평균화를 적용한 뒤, 고차원 베리‑에센 정리를 이용해 O(T⁻¹ᐟ³) 속도의 수렴률을 보이고, 온라인 플러그인 방식의 공분산 추정기를 제안한다. 또한, 비정규화된 단계 크기와 투사 없이도 asymptotic variance에 맞는 고확률 수렴 보장을 제공하며, 이를 기반으로 유한 표본 커버리지를 갖는 신뢰구간과 동시 신뢰구간을 구성한다. 실험을 통해 이론적 결과의 실효성을 확인한다.

상세 분석

이 논문은 강화학습에서 정책 평가를 위한 TD(Temporal Difference) 알고리즘에 Polyak‑Ruppert 평균화를 적용한 뒤, 그 통계적 특성을 고차원 환경에서도 정밀하게 분석한다. 기존 연구들은 주로 고정 차원에서만 CLT(중심극한정리)를 이용해 asymptotic normality를 보였으며, 수렴 속도에 대한 정량적 결과는 부족했다. 저자들은 먼저 TD 추정 오차 Δ_T = θ̄_T – θ에 대해 convex set 클래스에 대한 베리‑에센 거리 d_C(P_{Δ_T}, N(0,Λ))를 평가한다. 여기서 Λ*는 asymptotic covariance matrix이며, 기존의 O(T⁻¹ᐟ⁴)보다 빠른 O(T⁻¹ᐟ³) 속도를 달성한다. 이 결과는 고차원 Berry‑Esseen 이론을 선형 SA(Stochastic Approximation) 구조에 맞게 정교화한 것으로, 샘플 독립성(i.i.d.) 가정 하에 단계 크기 η_t = c·t⁻¹ 형태만으로도 충분함을 보여준다.

핵심 기술은 두 부분으로 나뉜다. 첫째, SA의 잔차를 마팅게일 차분으로 분해하고, 이를 고차원 마팅게일 중심극한정리와 최신 비정규화 마팅게일 불평등을 결합해 오차 항을 엄격히 제어한다. 둘째, 공분산 추정기 \hatΛ_T 를 온라인 방식으로 구축한다. 구체적으로, 각 단계에서 A_t와 b_t를 이용해 순간 공분산을 누적하고, 적절한 스케일링을 적용해 \hatΛ_T 를 얻는다. 이 추정기는 O(d²) 메모리와 O(d) 연산 복잡도로 실시간 업데이트가 가능하며, 총 변이 거리 d_TV(N(0,\hatΛ_T), N(0,Λ*)) 역시 O(T⁻¹ᐟ³) 확률적 수렴을 보인다.

고확률 수렴 보장은 Δ_T의 Euclidean norm이 √{Tr(Λ*)·log(1/δ)}·T⁻¹ᐟ² 수준으로, δ에 대한 로그 팩터만 남겨 두고 asymptotic variance와 일치한다. 특히, 투사(projection) 단계 없이도 이 결과를 얻는 것이 중요한데, 이는 기존 작업이 요구하던 강한 단계 크기 제약이나 추가적인 정규화 조건을 완화한다.

마지막으로, 위의 두 이론적 도구를 결합해 유한 표본 신뢰구간과 동시 신뢰구간을 구성한다. 베리‑에센 정리와 온라인 공분산 추정기의 정확성을 이용해, 신뢰구간의 실제 커버리지가 1–δ 수준으로 보장됨을 증명한다. 실험에서는 3차원 피처를 갖는 MDP에서 10,000번 독립 시뮬레이션을 수행해, Δ_T·√T가 정규분포에 수렴하는 모습을 시각화하고, 제안된 신뢰구간이 명시된 커버리지를 달성함을 확인한다. 전체적으로 이 논문은 고차원 강화학습에서 통계적 추론을 실현하기 위한 이론적·알고리즘적 토대를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기