다중 입자 행동을 위한 확산 SSM 정책 DiSPo

초록

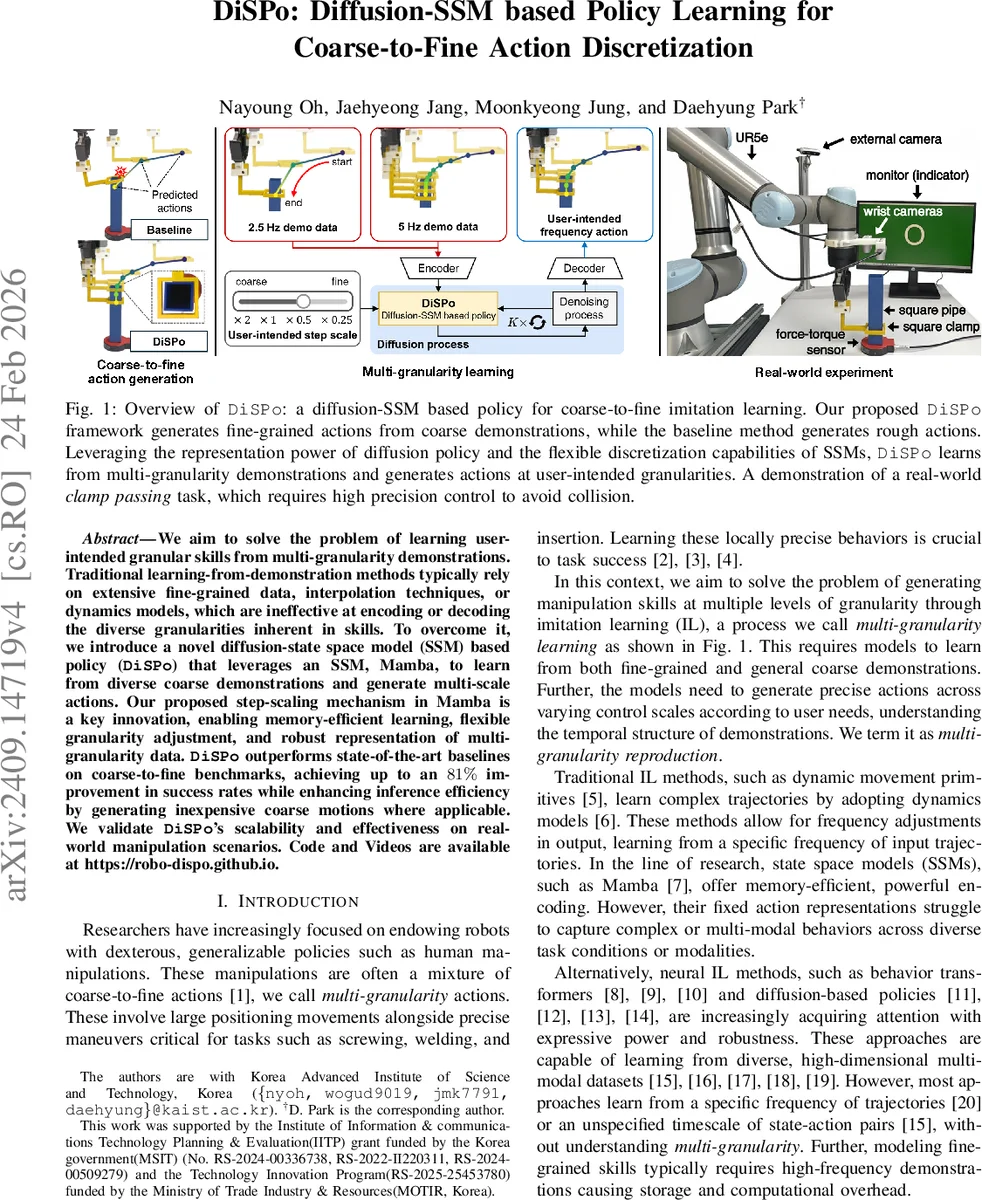

DiSPo는 확산 모델과 최신 상태공간 모델인 Mamba를 결합해, 거친 시연부터 정밀 시연까지 다양한 시간·공간 스케일의 로봇 행동을 학습한다. 단계‑스케일링 메커니즘을 통해 사용자가 원하는 입자(시간) 해상도를 자유롭게 조절할 수 있으며, 기존 방법 대비 성공률이 최대 81 % 향상되고 추론 효율도 크게 개선된다.

상세 분석

본 논문은 로봇 조작에서 흔히 나타나는 ‘거친‑정밀(coarse‑to‑fine)’ 행동을 하나의 정책으로 통합하려는 시도를 다룬다. 전통적인 학습‑시연(LfD) 접근법은 고해상도 시연 데이터를 대량으로 필요로 하거나, 외부 보간·동역학 모델에 의존해 정밀 제어를 구현한다. 이러한 방식은 메모리·연산 비용이 크게 증가하고, 새로운 작업에 대한 일반화가 제한적이다. DiSPo는 이러한 한계를 극복하기 위해 두 가지 핵심 아이디어를 제시한다. 첫째, 확산 기반 디노이징 프레임워크(DDPM)를 정책 네트워크에 적용해, 노이즈가 섞인 행동 시퀀스를 단계별로 정제한다. 둘째, 최신 상태공간 모델(SSM)인 Mamba를 변형해 ‘step‑scaled’ 블록을 도입함으로써, 시간 간격(Δt)을 사용자가 지정한 스케일 팩터 r에 따라 동적으로 조정한다. 이때 r은 관측 시퀀스와 행동 시퀀스 모두에 동일하게 적용되어, 전체 시퀀스의 시간 해상도를 일관되게 변환한다.

DiSPo의 아키텍처는 N개의 DiSPo 블록으로 구성되며, 각 블록은 Mamba의 핵심 연산(A, B, C 파라미터)을 입력 시퀀스와 r에 조건화한다. 입력은 관측 임베딩(o)과 현재 노이즈가 섞인 행동(a^(k))이며, diffusion step k와 r을 함께 인코딩해 adaLN을 통해 정규화한다. 이후 step‑scaled SSM이 Δ(i) = r·SoftPlus(f_Δ(u^(i))) 형태로 동적 시간 스텝을 계산하고, 이를 기반으로 연속적인 상태 전이와 출력 y를 생성한다. 최종적으로 행동 헤드(H_a)는 업데이트된 시퀀스에서 노이즈 ε̂^(k)를 추정하고, DDPM 공식 a^(k‑1) = α·a^(k) − γ·ε̂^(k)+𝒩(0,σ²I) 로 다음 단계의 행동을 복원한다.

학습 단계에서는 두 가지 손실을 결합한다. ① 행동 노이즈 예측 MSE(L_ε)와 ② 관측 재구성 MSE(L_o)이며, λ로 가중치를 조절한다. 또한, 다중 해상도 학습을 위해 샘플 레이트 증강을 수행한다. 원본 시연 데이터를 임의의 스케일 팩터 r_j 로 재샘플링해 다양한 주파수(ω_j) 시퀀스를 생성하고, 이를 모두 학습에 활용한다. 고해상도 행동이 부족한 경우, 사전 학습된 DiSPo를 이용해 ‘가짜 시연(pseudo demonstration)’을 생성한다. 구체적으로, 목표 주파수 ω_target 에 맞는 r을 설정하고, Gaussian 노이즈에서 시작해 K 단계 디노이징을 수행해 노이즈가 없는 고해상도 행동 시퀀스를 만든 뒤, 이를 원본 시연과 혼합해 미세 튜닝한다.

실험은 세 가지 시뮬레이션 벤치마크(클램프 통과, 통로 통과, 버튼 터치)와 실제 로봇 클램프 패싱 작업에서 수행되었다. DiSPo는 기존 행동 변환기, 행동 디퓨전, Mamba 기반 정책 등 최신 baselines 대비 성공률이 31 %~81 % 향상되었으며, 특히 비정밀 구역에서는 coarse 행동을 먼저 생성해 연산량을 절감했다. 또한, step‑scaled 메커니즘 덕분에 사용자가 원하는 정밀도(예: 2배, 4배 finer)로 행동을 즉시 조정할 수 있었으며, 이는 기존 고정 스텝 모델이 제공하지 못하는 유연성이다.

전반적으로 DiSPo는 (1) 메모리 효율적인 SSM 기반 인코더, (2) 확산 디노이징을 통한 강인한 행동 재구성, (3) 단계‑스케일링을 통한 입자 제어 해상도 조절이라는 세 축을 결합해, 다중‑입자 로봇 조작 학습에 새로운 패러다임을 제시한다. 향후 연구에서는 더 복잡한 다관절 로봇, 비정형 센서(예: 촉각)와의 통합, 그리고 온라인 r 예측기의 강화 학습 기반 최적화가 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기