빠른 영상‑언어 질의 서비스, QuickGrasp: 토크나이제이션 가속과 엣지 증강 인퍼런스

초록

QuickGrasp는 로컬‑우선 아키텍처와 필요 시 엣지 서버를 활용하는 하이브리드 시스템이다. 영상 토크나이제이션을 가속화하고, 로컬 모델의 신뢰도 기반으로 엣지 증강을 동적으로 결정하며, 토큰 밀도를 지연‑정밀도 균형을 맞추는 다중무장 밴딧 방식으로 선택한다. 실험 결과, 대형 VLM과 동등한 정확도를 유지하면서 평균 응답 지연을 최대 12.8배 감소시켰다.

상세 분석

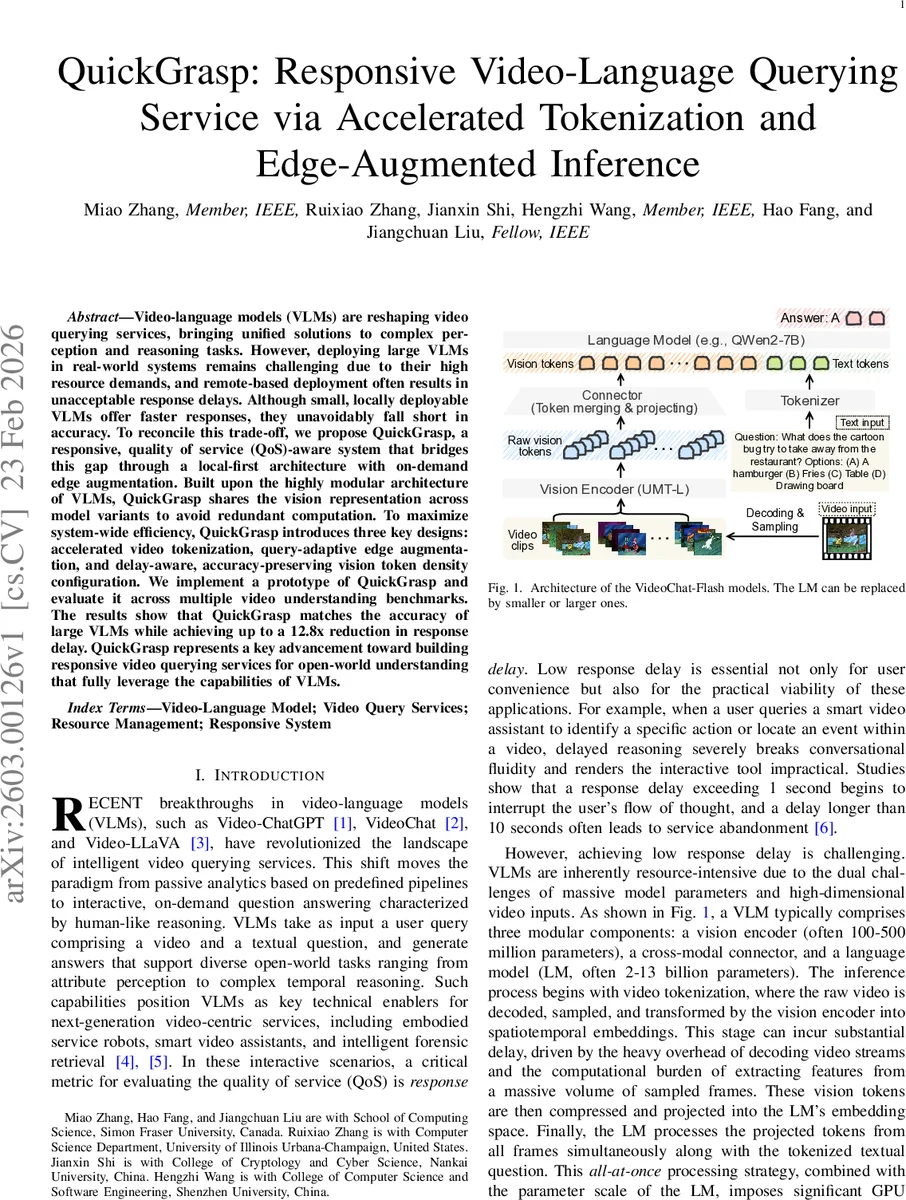

본 논문은 영상‑언어 모델(VLM)의 두드러진 병목 현상을 체계적으로 분석하고, 실시간 서비스에 적합한 설계 원칙을 도출한다. 첫 번째 병목은 영상 디코딩·프레임 샘플링 단계이며, 특히 길이가 긴 영상에서는 전체 파이프라인 지연의 42%~73%를 차지한다. 기존 연구가 비전 인코더 가속이나 LLM 토큰 생성 최적화에 집중한 반면, QuickGrasp는 ‘키프레임 정렬 샘플링 + 파이프라인 토크나이제이션’이라는 전처리 가속기를 도입해 이 부분을 크게 단축한다. 두 번째 핵심은 로컬‑우선 전략에서 엣지 서버를 언제 호출할지의 의사결정이다. 단순 텍스트 난이도 예측이 아닌, 로컬 VLM이 출력한 확신(confidence) 점수를 활용해 동적으로 라우팅함으로써 불필요한 네트워크 전송을 최소화한다. 이는 로컬 모델이 60%~76%의 경우 대형 모델과 동일한 답을 제공한다는 실험적 근거와, ‘오라클 라우팅’ 시 정확도가 대형 모델을 능가한다는 이론적 상한을 통해 정당화된다. 세 번째 설계는 토큰 밀도 조절이다. 비전 토큰 수는 LM 입력 길이와 직접 연관되며, 과다 토큰은 전송량·연산량을 늘려 지연을 초래하고, 부족 토큰은 정확도를 저하시킨다. 저자는 이를 컨텍스트 다중무장 밴딧(CMAB) 문제로 모델링하고, 실시간 보상(정답률·지연) 기반으로 토큰 밀도를 적응적으로 선택한다. 이렇게 하면 간단한 질의에서는 최소 토큰을 전송해 지연을 최소화하고, 복잡한 질의에서는 토큰 수를 늘려 정확도를 보전한다. 구현 측면에서는 동일한 비전 인코더(UMT‑L)를 로컬·엣지 모두에 공유함으로써 비전 토큰을 재사용하고, 엣지 모델이 원시 영상을 받지 않아 네트워크 부하를 크게 낮춘다. 실험은 MVBench(짧은 영상)과 Video‑MME(짧음·중간·긴 영상) 등 3가지 벤치마크에서 수행됐으며, 2B 로컬 모델과 7B 엣지 모델을 조합한 QuickGrasp가 대형 모델 대비 평균 12.8배 빠른 응답을 보이면서도 정확도는 거의 동일했다. 전체 시스템 설계는 모듈화된 VLM 구조를 그대로 유지하면서도, 토크나이제이션 가속, 신뢰도 기반 라우팅, 토큰 밀도 최적화를 통해 실시간 영상‑언어 질의 서비스에 필요한 ‘속도‑정확도’ 트레이드오프를 효과적으로 해결한다.

댓글 및 학술 토론

Loading comments...

의견 남기기