다이나믹 로봇 조작을 위한 적응형 세계 모델 기반 확산 정책

초록

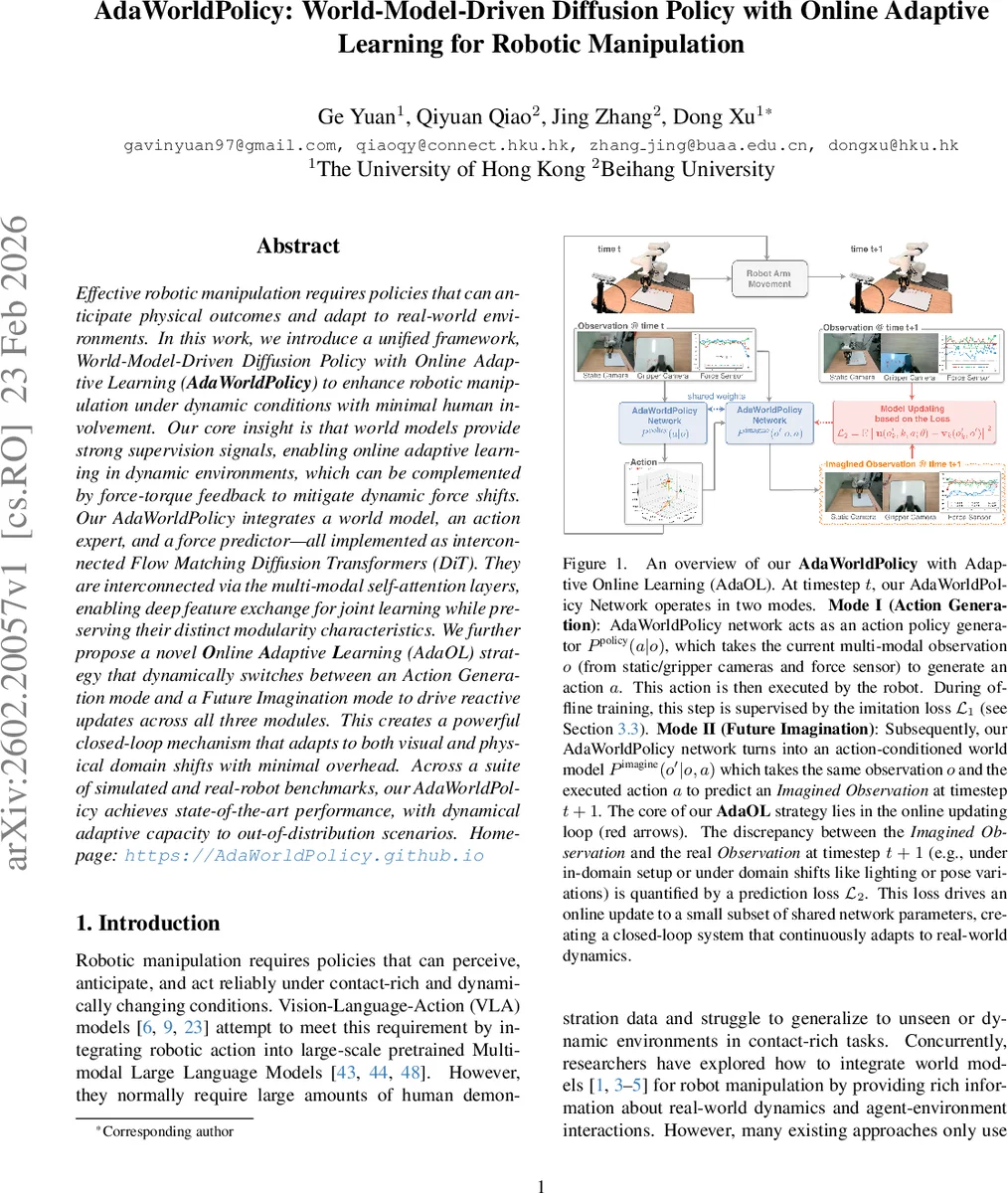

AdaWorldPolicy는 세계 모델, 행동 전문가, 힘 예측기를 하나의 흐름 매칭 확산 트랜스포머(DiT) 아키텍처에 결합하고, 온라인 적응 학습(AdaOL)으로 시각·물리 도메인 변화를 실시간 보정한다. 두 모드(행동 생성·미래 상상)를 전환하며 손실을 자체 생성해 파라미터를 빠르게 업데이트해, 시뮬레이션·실제 로봇에서 최첨단 성능을 달성한다.

상세 분석

AdaWorldPolicy는 로봇 조작의 핵심 과제인 “예측‑행동‑피드백” 루프를 하나의 통합 네트워크로 재구성한다. 핵심 구성요소는 (1) 사전학습된 Cosmos‑Predict2 기반 세계 모델, (2) 경량화된 행동 전문가, (3) 힘‑토크 예측기이며, 모두 흐름 매칭(Flow Matching) 손실을 이용한 확산 트랜스포머(DiT) 구조로 구현된다. 이 세 모듈은 다중모달 자기‑주의(Multi‑modal Self‑Attention, MMSA) 레이어를 통해 깊이 있는 피처 교환을 수행하면서도 각 모듈의 독립성을 유지한다는 점이 특징이다.

AdaWorldPolicy의 가장 큰 혁신은 온라인 적응 학습(AdaOL) 전략이다. 매 타임스텝마다 네트워크는 두 가지 모드 중 하나를 선택한다. Mode I에서는 행동 토큰을 순수 노이즈로 입력해 현재 관측(o)으로부터 행동(a)을 생성하고, 행동 전문가의 출력은 행동 모방 손실 L₁으로 지도된다. 이후 Mode II로 전환해 동일 행동을 조건으로 세계 모델과 힘 예측기가 미래 관측(o′)과 힘(f′)을 예측한다. 예측값과 실제 관측·힘 사이의 차이를 예측 손실 L₂로 계산하고, 이 손실을 공유 파라미터(주로 LoRA‑형식의 저차원 어댑터)만을 대상으로 역전파한다. 이렇게 하면 시각적 도메인 시프트(조명, 배경, 카메라 포즈)와 물리적 도메인 시프트(접촉 강도, 마찰 변화)를 동시에 보정할 수 있다.

기술적인 관점에서 주목할 점은 (1) 흐름 매칭 기반 확산 모델이 기존 행동 복제 기반 정책보다 물리적 일관성을 자연스럽게 인코딩한다는 점, (2) MMSA가 서로 다른 모달리티(이미지, 힘, 텍스트, 로봇 상태)를 하나의 토큰 시퀀스로 통합해 교차‑어텐션을 수행함으로써 정보 손실을 최소화한다는 점, (3) LoRA‑형 어댑터를 활용해 온라인 업데이트 시 연산·메모리 오버헤드를 극히 낮추면서도 실시간 적응을 가능하게 한다는 점이다.

실험에서는 PushT, CALVIN, LIBERO 등 다양한 시뮬레이션 벤치마크와 실제 로봇 환경에서 AdaWorldPolicy가 기존 최첨단 방법보다 OOD 상황에서 5 % 이상, 인‑도메인 상황에서 약 1 % 향상을 보였다. 특히 힘‑예측 모듈을 포함한 버전은 접촉이 빈번한 작업(예: 삽입, 조립)에서 힘 오차를 크게 감소시켜 안정적인 제어를 구현했다. 전체 시스템은 두 모드 전환과 손실 계산, LoRA 업데이트를 포함해 평균 10 ms 이하의 추가 지연만을 발생시켜 실시간 제어 요구를 충족한다.

요약하면, AdaWorldPolicy는 세계 모델을 단순 예측기가 아니라 행동 정책의 실시간 교정 장치로 활용하고, 확산 기반 다중모달 트랜스포머와 저비용 온라인 적응 메커니즘을 결합해 동적·접촉‑풍부한 로봇 조작에 대한 일반화와 적응성을 크게 향상시킨다.

댓글 및 학술 토론

Loading comments...

의견 남기기