뇌 영감 아날로지 기반 가중치 생성으로 적은 샘플 클래스 증분 학습 혁신

초록

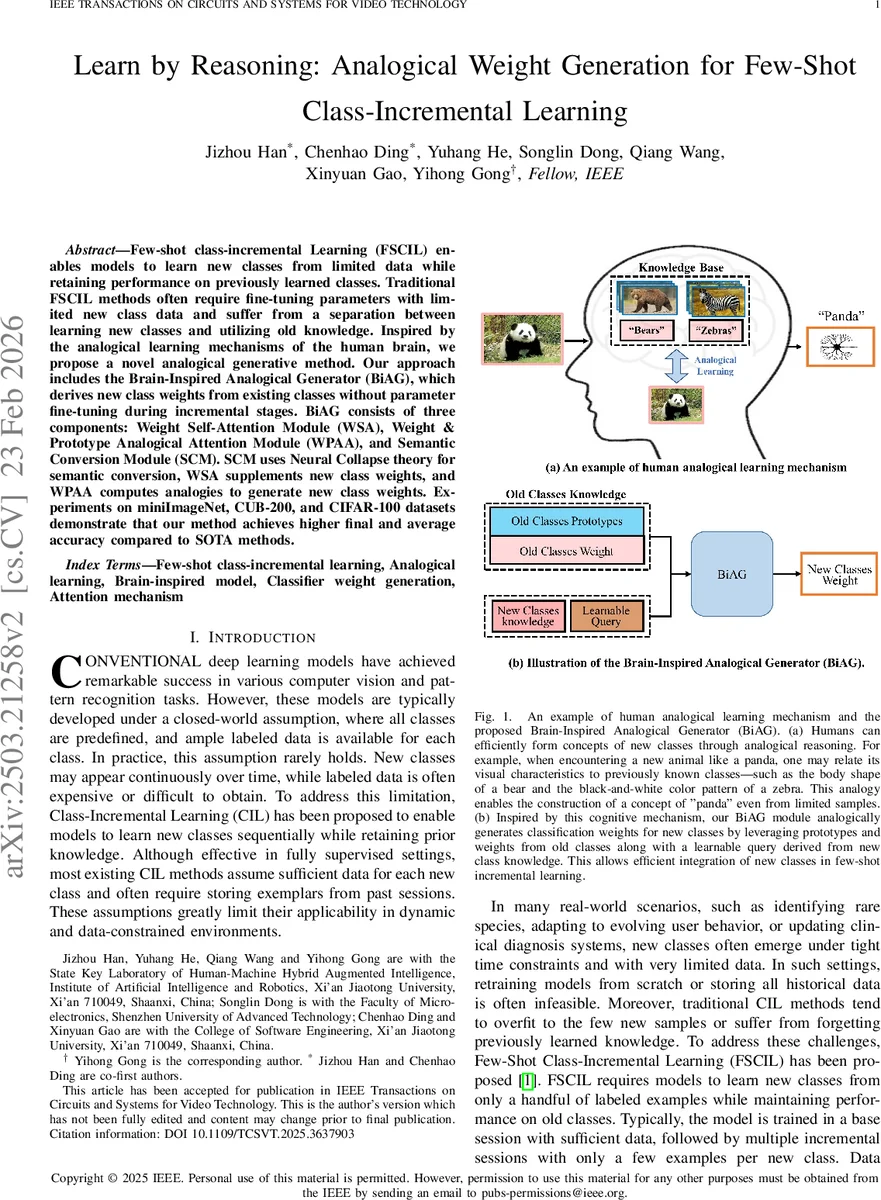

본 논문은 인간의 유추 학습 메커니즘을 모방한 Brain‑Inspired Analogical Generator(BiAG)를 제안한다. BiAG는 기존 클래스의 프로토타입과 분류 가중치를 활용해 새로운 클래스의 가중치를 직접 생성함으로써, 증분 단계에서 파라미터 미세조정 없이도 높은 정확도를 유지한다. SCM, WSA, WPAA라는 세 가지 모듈로 구성되며, Neural Collapse 이론을 기반으로 프로토타입‑가중치 변환을 수행한다. miniImageNet, CUB‑200, CIFAR‑100에서 기존 최첨단 방법들을 앞서는 최종·평균 정확도를 기록한다.

상세 분석

이 연구는 Few‑Shot Class‑Incremental Learning(FSCIL)이라는 매우 제한된 데이터 환경에서 기존 모델이 겪는 ‘과적합’과 ‘망각’ 문제를 인간의 유추(analogical) 학습 원리를 차용해 해결하고자 한다. 핵심 아이디어는 새로운 클래스를 학습할 때, 기존에 학습된 클래스들의 가중치와 프로토타입을 ‘비유’하여 새로운 분류 가중치를 생성하는 것이다. 이를 위해 저자들은 Brain‑Inspired Analogical Generator(BiAG)를 설계했으며, BiAG는 세 개의 서브모듈로 구성된다.

-

Semantic Conversion Module(SCM): Neural Collapse 이론에 근거해 클래스 프로토타입과 분류 가중치 사이의 의미적 변환을 학습한다. Neural Collapse는 학습이 충분히 진행될 때 클래스별 특징이 고정된 방향으로 수렴하고, 프로토타입과 가중치가 동일한 구조를 갖는 현상을 말한다. SCM은 이 이론을 활용해 프로토타입을 가중치 공간으로 매핑함으로써, 이후 모듈들이 직접 가중치를 생성할 수 있는 기반을 제공한다.

-

Weight Self‑Attention Module(WSA): 새 클래스의 초기 가중치를 자체‑주의 메커니즘으로 보강한다. 입력으로는 새 클래스의 프로토타입과 기존 가중치들이 들어오며, 자기‑주의를 통해 새 클래스가 기존 클래스와 공유하는 핵심 특성을 강조한다. 이는 인간이 새로운 개념을 파악할 때 먼저 핵심 속성을 추출하고, 이를 기존 지식과 연결하는 과정과 유사하다.

-

Weight & Prototype Analogical Attention Module(WPAA): 가장 혁신적인 부분으로, 기존 클래스의 가중치와 프로토타입을 ‘아날로지’(유추) 관계에 놓고 새로운 가중치를 생성한다. 구체적으로, WPAA는 쿼리(learnable query)와 기존 가중치·프로토타입 사이의 유사도 행렬을 계산하고, 이를 기반으로 가중치 재구성을 수행한다. 이 과정에서 기존 클래스들의 관계 구조가 그대로 보존되면서도, 새 클래스에 맞는 변형이 가해진다.

BiAG는 베이스 세션에서 충분한 데이터로 feature extractor와 초기 가중치를 학습한 뒤, ‘pseudo‑incremental’ 방식으로 자체 생성 능력을 훈련한다. 즉, 베이스 클래스들을 임의로 ‘old’와 ‘new’로 나누어 가중치 생성 과정을 시뮬레이션하고, 생성된 가중치와 실제 가중치 사이의 L_G 손실을 최소화한다. 증분 단계에서는 feature extractor와 BiAG 파라미터를 전혀 업데이트하지 않고, 새로운 클래스의 프로토타입만을 입력으로 가중치를 즉시 생성한다.

실험 결과는 세 개의 벤치마크 데이터셋(miniImageNet, CUB‑200, CIFAR‑100)에서 기존 SOTA(FSCIL‑iCaRL, TOPIC, ALFSCIL 등)보다 평균·최종 정확도가 현저히 높음을 보여준다. 특히, 증분 세션이 진행될수록 파라미터 미세조정이 필요 없는 BiAG의 장점이 두드러져, 모델 복잡도와 메모리 사용량을 크게 줄이면서도 성능 저하를 방지한다.

이 논문은 (1) 인간의 유추 학습 메커니즘을 딥러닝에 성공적으로 도입, (2) Neural Collapse 이론을 실용적인 가중치 변환 도구로 활용, (3) 파라미터 고정 상태에서 새로운 클래스를 빠르게 통합하는 효율적인 프레임워크를 제공한다는 점에서 FSCIL 분야에 중요한 기여를 한다. 향후 연구에서는 BiAG를 다른 도메인(예: 자연어 처리)이나 대규모 연속 학습 시나리오에 확장하는 방향이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기