실제 적용 가능한 다중턴 LLM 에이전트 학습을 위한 근접 기반 최적화

초록

ProxMO는 멀티턴 LLM 에이전트의 학습에서 에피소드 난이도와 단계별 의미적 유사성을 동시에 고려해 신뢰도 높은 크레딧을 할당한다. 에피소드 수준에서는 성공률에 따라 이득을 증폭·감쇠하는 성공률 인식 모듈을, 단계 수준에서는 TF‑IDF 기반 코사인 유사도로 연속적인 가중치를 부여하는 근접 기반 소프트 집계 방식을 도입한다. ALFWorld와 WebShop 벤치마크에서 기존 GRPO·GiGPO 대비 8~18%p의 절대 성능 향상을 달성했으며, 하이퍼파라미터에 대한 강인성도 입증하였다.

상세 분석

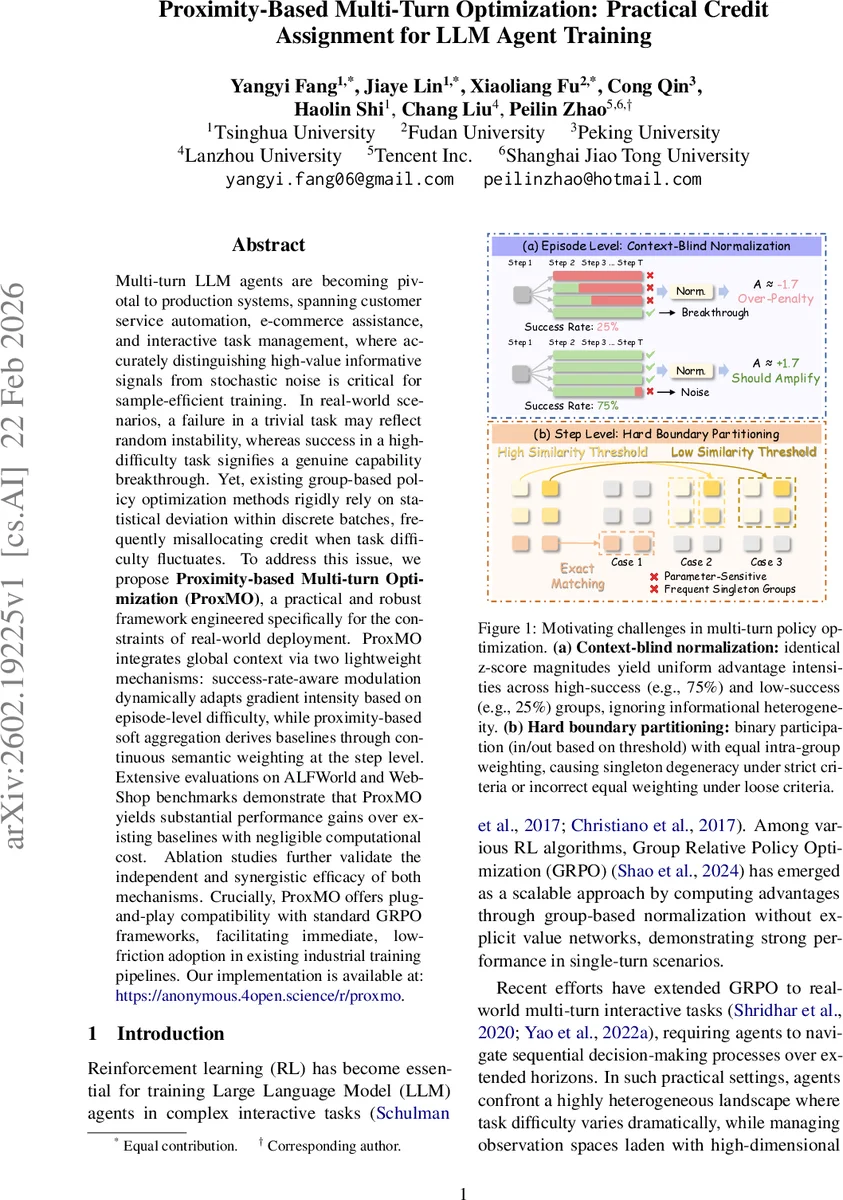

본 논문은 멀티턴 LLM 에이전트 학습 시 “크레딧 할당” 문제를 핵심으로 다룬다. 기존 그룹 기반 정책 최적화(GRPO)는 에피소드 집단 내 평균·표준편차를 이용해 z‑score 정규화를 수행하지만, 이는 동일한 통계적 편차가 서로 다른 난이도 환경에서 동일한 학습 신호로 해석되는 한계를 가진다. 예를 들어 성공률이 75%인 쉬운 과제에서의 실패는 잡음일 가능성이 높지만, 성공률이 25%인 어려운 과제에서의 성공은 실제 능력 향상의 증거가 된다. 이러한 맥락 의존성을 무시하면 에이전트가 잘못된 방향으로 업데이트될 위험이 크다.

ProxMO는 두 단계에서 이 문제를 해결한다.

① 에피소드‑레벨 성공률 인식 모듈(PSC): 에피소드 집단의 실험적 성공률 p를 추정하고, 성공( R=1 )과 실패( R=0 )에 대해 각각 Sigmoid 함수를 적용해 가중치 w(R,p)=1+β·f(R,p) 를 계산한다. 성공은 낮은 p일수록, 실패는 높은 p일수록 가중치가 크게 변하도록 설계돼, 낮은 성공률 집단에서의 성공은 강화되고 높은 성공률 집단에서의 실패는 완화된다. 이는 기존 z‑score가 제공하던 절대적 이득을 상대적 난이도에 맞춰 재조정한다.

② 단계‑레벨 근접 기반 소프트 집계(PSA): 각 단계의 상태 sᵢₜ를 TF‑IDF 벡터로 표현하고 코사인 유사도로 측정한다. 온도 파라미터 τ를 이용해 유사도에 따라 연속적인 가중치 wᵢⱼ를 부여함으로써, 동일 에피소드 내 모든 상태가 “근접도”에 비례해 베이스라인 Bᵢₜ에 기여한다. τ→0이면 가장 유사한 이웃만을 사용해 기존 하드 매칭과 동일해지고, τ→∞이면 균등 가중치가 적용돼 에피소드‑레벨 베이스라인과 동일해진다. 실험에서는 τ=0.1이 안정성과 민감도 사이의 최적 균형을 제공한다.

두 모듈의 이점을 결합해 최종 어드밴티지는 ˜A_E(τᵢ)+ω·A_S(aᵢₜ) 로 정의하고, PPO 클리핑 손실에 삽입한다. 여기서 ω는 기본값 1이며, 필요에 따라 에피소드와 단계 신호의 비중을 조절할 수 있다.

실험에서는 Qwen2.5‑1.5B/7B‑Instruct 모델을 기반으로 ALFWorld(3,827 과제)와 WebShop(1.1M 제품) 두 실제 멀티턴 환경에서 평가했다. ProxMO는 기존 GRPO 대비 평균 8~18%p(절대) 향상을 보였으며, 특히 긴 호라이즌( Look, Cool, Pick2) 과제에서 큰 이득을 기록했다. 또한, 작은 1.5B 모델이 GPT‑4o·Gemini‑2.5‑Pro와 맞먹는 성능을 달성해 비용 효율성을 입증했다. 하이퍼파라미터 민감도 분석에서는 α=4.0, β=0.1, τ=0.1이 폭넓은 설정에서도 안정적인 결과를 유지함을 보여, 대규모 산업 적용 시 별도 튜닝 비용이 최소화될 수 있음을 시사한다.

Ablation 실험에서는 PSC와 PSA를 각각 제거했을 때 성능이 현저히 감소했으며, 특히 PSA 제거 시 장기 의존성이 강한 과제에서 급격한 하락을 보였다. 이는 단계‑레벨 연속 가중치가 에이전트가 세밀한 행동 차이를 인식하도록 하는 핵심 메커니즘임을 확인한다.

요약하면, ProxMO는 (1) 성공률 기반의 에피소드 가중치로 난이도에 민감한 신호를 제공하고, (2) 의미적 근접성을 활용한 소프트 집계로 단계별 베이스라인을 부드럽게 추정함으로써, 기존 그룹 기반 정책 최적화의 구조적 한계를 효과적으로 보완한다. 플러그‑인 형태로 GRPO와 호환 가능하므로, 기존 산업 파이프라인에 최소한의 코드 변경만으로 바로 적용할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기