증거 순서 민감성으로 인한 압축 실패 예측

초록

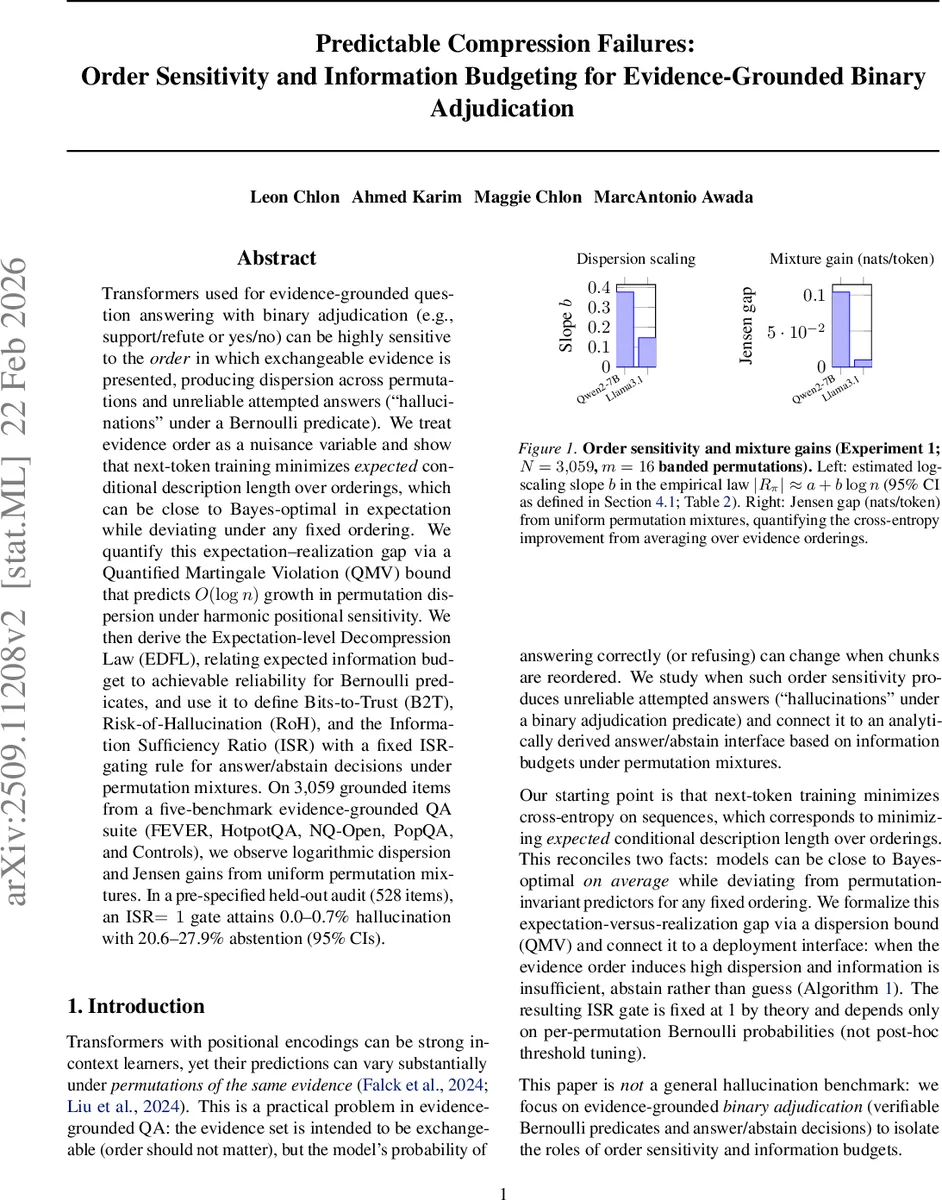

이 논문은 증거 기반 이진 판정(예: 참/거짓)에서 변환기 모델이 증거의 순서에 따라 답변이 크게 달라지는 현상을 분석한다. 순열을 잡음 변수로 보고, 다음 토큰 학습이 순열 평균 조건부 설명 길이를 최소화함을 보이며, 이를 통해 기대값에서는 베이즈 최적에 가깝지만 개별 순열에서는 편차가 발생한다는 이론적 근거를 제시한다. 순열에 의한 분산을 O(log n)으로 제한하는 “Quantified Martingale Violation”(QMV) 경계와, 기대 정보 예산과 신뢰도 사이의 관계를 나타내는 “Expectation-level Decompression Law”(EDFL)를 도출한다. 이를 바탕으로 Bits‑to‑Trust, Risk‑of‑Hallucination, Information Sufficiency Ratio라는 지표와 ISR = 1 게이팅 규칙을 제안하고, 다섯 개 벤치마크(FeVER·HotpotQA·NQ‑Open·PopQA·Controls)에서 로그 스케일의 분산과 순열 혼합에 의한 Jensen 이득을 실증한다. 사전 정의된 검증에서 ISR = 1 게이팅은 0.00.7 %의 허위 생성률과 20.627.9 %의 보류율을 달성한다.

상세 분석

본 연구는 증거가 교환 가능한 상황에서 변환기 기반 QA 모델이 순서에 민감하게 반응한다는 실증적 문제를 이론적으로 정형화한다. 먼저, 증거 순열을 확률 변수 π로 두고, 모델이 다음 토큰을 예측하는 과정이 순열에 대한 기대 조건부 설명 길이(conditional description length)를 최소화한다는 사실을 증명한다. 이는 순열 평균에서는 베이즈 최적에 근접하지만, 특정 순열에서는 확률 분포가 크게 달라질 수 있음을 의미한다. 이를 정량화하기 위해 ‘Permutation‑induced residual’ Rπ = qπ − \bar{q} 를 정의하고, 인접 순위 변화에 대한 로그잇(logit) 민감도를 총 변동량 TV_i 로 측정한다. Assumption 1에 따라 TV_i의 합이 유한한 B로 제한될 때, Theorem 1은 E|Rπ| ≤ (1/4)∑_i TV_i 로 순열에 의한 분산을 상계한다. 특히, 위치 민감도가 조화적(harmonic) 감소(α = 1)를 보이면, Theorem 2는 E|Rπ| ≤ (C/4)(log n − 3/2+o(1)) 형태의 O(log n) 성장률을 제시한다. 이는 실험 1에서 관측된 a + b log n 스케일과 일치한다.

다음으로, 기대 정보 예산 \bar{Δ}=E_π

댓글 및 학술 토론

Loading comments...

의견 남기기