GRASP – 중복 레이어를 적응형 특잇값으로 교체하는 효율적 모델 압축 기법

초록

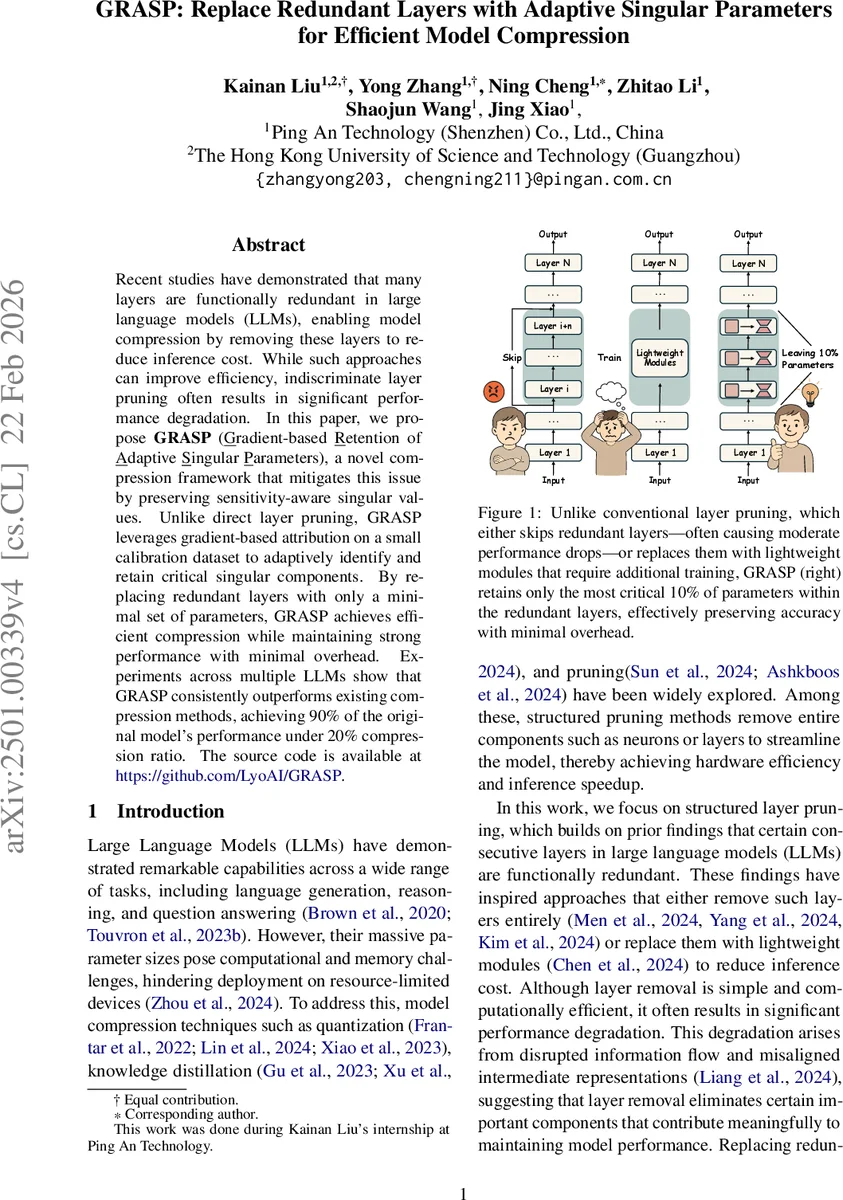

GRASP는 LLM에서 변환 효과가 거의 없는 레이어를 코사인 유사도로 선별하고, 해당 레이어의 가중치를 SVD로 분해한 뒤 작은 캘리브레이션 데이터셋을 이용한 그래디언트 기반 중요도 평가로 핵심 특잇값만 남긴다. 이렇게 선택된 저‑랭크 파라미터만으로 레이어를 대체해 20 % 압축 비율에서도 원 모델 성능의 90 % 이상을 유지한다. 훈련 없이 바로 적용 가능하며, 최소 샘플로 후‑학습 보정 시 성능 회복이 빠르게 이루어진다.

상세 분석

GRASP는 기존 레이어 프루닝이 “레이어를 완전히 삭제하거나 무작위 초기화된 경량 모듈로 교체”하는 방식과 달리, 레이어 내부의 저‑랭크 구조를 활용한다는 점에서 차별화된다. 먼저 인접 레이어 출력 히든 상태 간 코사인 유사도를 계산해 변환이 거의 일어나지 않는 레이어를 ‘중복’으로 정의한다. 이 단계는 기존 연구와 동일하지만, 이후 단계에서 특잇값의 절대 크기가 아니라 그 특잇값이 최종 손실에 미치는 영향을 직접 측정한다는 점이 핵심이다.

특잇값 중요도는 식 (6)의 1차 그래디언트 근사식으로 추정한다. 구체적으로, 각 특잇값 σ_k와 대응하는 좌·우 특이벡터 u_k, v_k에 대해 손실 L에 대한 편미분을 구하고, 이를 가중합해 I(Φ_k)를 산출한다. 이 과정은 전체 모델 파라미터가 아니라 선택된 레이어의 SVD 구성요소에만 적용되므로 계산 비용이 크게 감소한다. 또한, 2차 헤시안 항을 생략함으로써 실용성을 높였으며, 실험에서는 512개의 WikiText‑2 샘플만으로 충분한 중요도 추정이 가능함을 보였다.

중복 레이어마다 상위 r % 특잇값(예: 10 %)만을 보존하고 나머지는 0으로 만든 뒤, 남은 특잇값·특이벡터를 재조합해 저‑랭크 가중치 행렬 ˜W를 복원한다. 이렇게 하면 레이어의 주요 변환 능력은 유지하면서 파라미터 수와 연산량을 크게 줄일 수 있다. 압축 비율과 r % 사이의 관계는 부록 A.3에 상세히 제시되어 있어, 사용자는 목표 압축률에 맞춰 r을 조정할 수 있다.

실험에서는 LLaMA‑7B/13B, LLaMA‑3.1‑8B‑Instruct, Mistral‑7B 등 5개 모델과 19개 데이터셋을 대상으로 두 가지 시나리오를 평가했다. (1) 훈련‑프리 설정에서는 20 % 압축 비율에서도 평균 정확도가 78.6 %에 달해, 기존 레이어 프루닝·모듈 프루닝·저‑랭크 프루닝 방법을 모두 앞섰다. (2) 후‑학습 보정에서는 Alpaca 데이터셋을 1 epoch만 fine‑tune함으로써 원 모델 성능의 94.9 %를 회복했으며, 수렴 속도와 안정성에서도 우수함을 보였다.

GRASP의 장점은 다음과 같다.

- 그래디언트 기반 특잇값 선택으로 단순 magnitude‑based 기준보다 실제 downstream 성능과 높은 상관관계를 확보.

- 훈련‑프리 압축이 가능해 대규모 모델을 빠르게 경량화할 수 있음.

- 저‑랭크 구조 활용으로 파라미터 수 감소와 연산량 감소가 동시에 이루어짐.

- 후‑학습 보정 비용 최소화—수십~수백 샘플만으로도 성능 회복 가능.

하지만 몇 가지 한계도 존재한다. 첫째, 코사인 유사도 기반 레이어 선택이 모델 아키텍처에 따라 다소 민감할 수 있다(예: 혼합형 레이어가 많은 변형 모델). 둘째, 1차 그래디언트 근사는 손실 곡면이 비선형인 경우 정확도가 떨어질 가능성이 있다. 셋째, 현재는 Transformer의 Attention과 MLP 가중치에만 적용했으며, LayerNorm·Positional Encoding 등 다른 파라미터는 다루지 않는다. 향후 연구에서는 이러한 비선형 효과를 보정하기 위한 2차 근사 도입, 다양한 아키텍처에 대한 레이어 선택 기준 확장, 그리고 전체 모델 파라미터에 대한 통합 압축 전략을 탐색할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기