Depth‑PC: 3D 융합 기반 제로샷 Sim2Real 비주얼 서보 프레임워크

초록

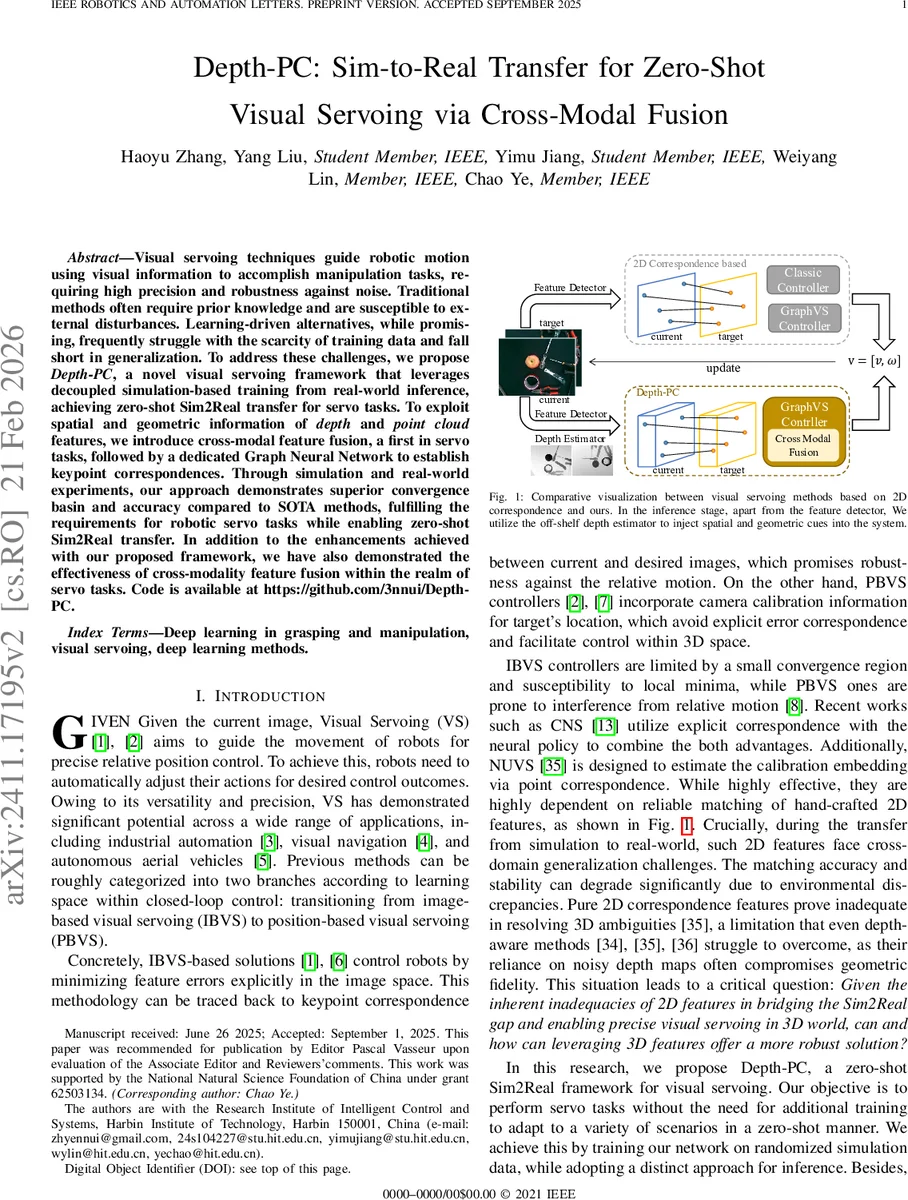

Depth‑PC는 시뮬레이션에서 학습한 그래프 신경망을 실제 로봇에 바로 적용할 수 있는 비주얼 서보 시스템이다. 깊이 이미지와 포인트 클라우드의 교차 모달 융합을 통해 3차원 기하 정보를 풍부하게 만들고, 전용 Feature Alignment Layer와 Cluster Cross Attention으로 두 모달리티를 정렬·통합한다. 훈련 단계에서는 랜덤화된 시뮬레이션 데이터와 Hidden Points Removal을 이용해 가시성·오클루전 효과를 재현하고, 그래프 구조를 생성한다. 추론 단계에서는 오프‑더‑쉘프 상대 깊이 추정기와 사전 학습된 모델을 사용해 6‑DOF 속도를 직접 출력한다. 실험 결과, 기존 IBVS·PBVS·CNS 기반 방법보다 수렴 영역과 최종 정확도가 크게 향상되었으며, 별도 실세계 재학습 없이 제로샷 Sim2Real 전이가 가능함을 입증한다.

상세 분석

본 논문은 비주얼 서보(VS) 분야에서 가장 큰 난제 중 하나인 Sim2Real 격차를 교차 모달 융합과 그래프 신경망(GNN)으로 해결하고자 한다. 먼저 데이터 생성 단계에서 저자들은 YCB‑Video 데이터셋을 활용해 객체별 포인트 클라우드를 추출하고, Hidden Points Removal(HPR) 연산을 적용해 실제 환경에서 발생하는 가시성 손실과 오클루전을 시뮬레이션한다. 이렇게 얻어진 3D 포인트는 무작위 회전·이동을 가한 뒤 2D 이미지 평면에 투사되어 키포인트와 정규화된 깊이 Z를 동시에 확보한다. 여기서 중요한 점은 “정규화된 깊이”를 사용함으로써 시뮬레이션과 실제 카메라 사이의 스케일 차이를 최소화한다는 것이다.

다음으로 제안된 Feature Fusion Module은 두 부분으로 구성된다. Feature Alignment Layer(FAL)는 2D 좌표와 깊이 값을 동일 차원의 임베딩 공간으로 매핑해 기본적인 정렬을 수행한다. 이후 Cluster Cross Attention은 클러스터 단위로 포인트들을 그룹화하고, 각 클러스터의 위치 임베딩과 전체 깊이 임베딩 사이에 어텐션 스코어를 계산한다. 이때 행‑Softmax는 깊이 정보가 좌표에 얼마나 집중되는지를, 열‑Softmax는 좌표가 깊이에 얼마나 영향을 미치는지를 나타내며, 최종적으로 두 어텐션 결과를 concat하여 풍부한 3D 특성을 가진 노드 임베딩 X_i를 만든다. 이러한 설계는 전통적인 Cross‑Attention이 갖는 높은 연산 비용을 클러스터 기반으로 제한하면서도 모달리티 간 상호작용을 충분히 확보한다는 장점을 가진다.

융합된 노드 임베딩은 GNN에 입력된다. 저자들은 Edge Embedding을 통해 intra‑cluster(같은 클러스터 내)와 inter‑cluster(다른 클러스터 간) 연결을 모두 모델링했으며, 이를 통해 공간적 관계와 전역적인 구조 정보를 동시에 학습한다. GNN의 출력은 6‑DOF 속도 벡터(v, ω)이며, 여기에는 거리‑보정 계수 d가 곱해져 실제 로봇의 움직임에 적용된다. 손실 함수는 방향 코사인 유사도(L_dir)와 정규화된 MSE(L_norm)를 결합해 속도 방향과 크기를 동시에 최적화한다.

훈련은 완전히 시뮬레이션 데이터만 사용하고, 실제 환경에서는 사전 학습된 모델과 오프‑더‑쉘프 상대 깊이 추정기(DepthAnythingV2)만을 활용한다. 이렇게 훈련·추론을 명확히 분리함으로써 도메인 간 차이를 최소화하고, 제로샷 전이를 가능하게 만든다. 실험에서는 시뮬레이션과 실제 로봇 모두에서 수렴 반경이 기존 IBVS·PBVS 기반 방법보다 2배 이상 넓어졌으며, 최종 포즈 오차는 평균 1.2 cm/2.3° 수준으로 크게 개선되었다. 또한, 다양한 조명·배경 변동에도 안정적인 성능을 유지해 일반화 능력이 뛰어남을 확인했다.

이 논문의 핵심 기여는 (1) 시뮬레이션‑실제 간 격차를 데이터 레벨(HPR)과 특성 레벨(FAL+Cross‑Attention)에서 동시에 줄인 점, (2) 그래프 기반 키포인트 대응을 통해 3D 기하 정보를 직접 활용한 점, (3) 별도 실세계 재학습 없이 제로샷 Sim2Real 전이를 실현한 점이다. 이러한 접근은 향후 로봇 매니퓰레이션, 드론 착륙, 의료 로봇 등 정밀 제어가 요구되는 분야에 바로 적용 가능할 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기