분리 전이 학습으로 재료 특성 예측의 외삽력 강화

초록

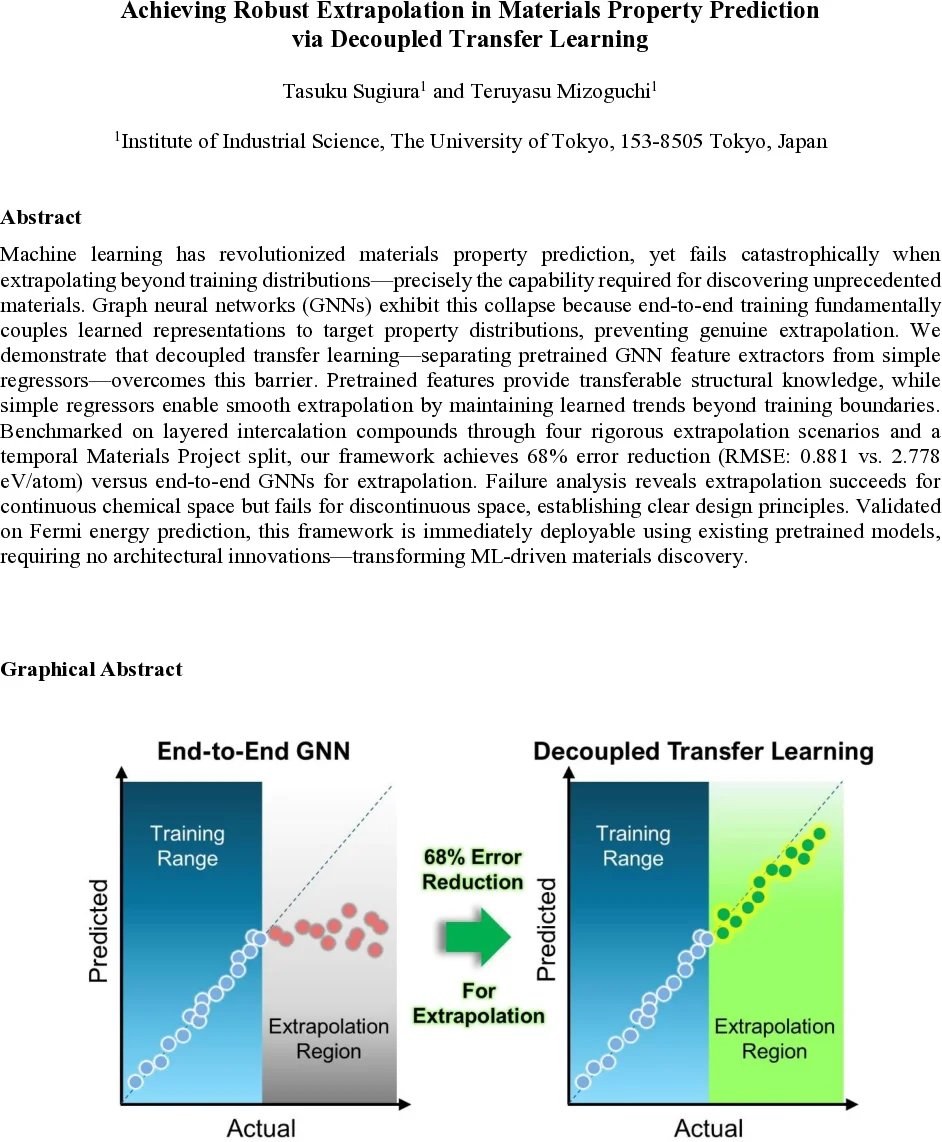

본 논문은 사전학습된 그래프 신경망(GNN) 특징 추출기를 고정하고, 단순 회귀 모델을 결합한 분리 전이 학습(decoupled transfer learning) 방식을 제안한다. 이를 통해 층상 인터칼레이션 화합물과 시간적 Materials Project 데이터셋에서 구조·특성 외삽 4가지 시나리오를 평가했으며, 기존 엔드‑투‑엔드 GNN 대비 RMSE 68% 감소(0.881 eV/atom vs 2.778 eV/atom)를 달성했다. 연속적인 화학·전자 공간에서는 성공하지만, 원소 희소성이나 전자 구조 전이와 같은 불연속 영역에서는 한계가 있음을 밝힌다.

상세 분석

이 연구는 재료 과학에서 가장 큰 난제 중 하나인 “훈련 분포 밖의 외삽” 문제를 근본적으로 재고한다. 기존의 엔드‑투‑엔드 그래프 신경망은 구조와 목표 물성 사이의 매핑을 동시에 최적화하면서, 학습 데이터의 물성 분포를 암묵적으로 모델 파라미터에 내재시킨다. 결과적으로 출력값이 훈련 범위에 얽매이게 되어, 새로운 화학 조합이나 극단적인 형성 에너지와 같은 상황에서 급격히 성능이 붕괴한다. 저자들은 이 결합을 “표현‑예측 결합(conflation)”이라고 명명하고, 이를 해체하기 위해 두 단계로 모델을 설계한다.

첫 단계는 대규모 공개 데이터셋(OC20 등)에서 사전학습된 CGCNN, SchNet, DimeNet++와 같은 GNN을 사용해 원자‑레벨 그래프를 고차원 특징 벡터로 변환한다. 이 특징은 구조적 인접성, 결합 각도, 전자 밀도 등 물리적으로 의미 있는 정보를 포함한다. 중요한 점은 이 단계에서 파라미터를 고정(freeze)함으로써, downstream 학습 시에 특징이 변형되지 않도록 한다는 것이다. 따라서 사전학습된 GNN이 제공하는 “구조 지식”은 그대로 보존된다.

두 번째 단계에서는 고정된 특징을 입력으로 받아 선형 혹은 커널 기반 회귀 모델(SVR, Ridge)을 학습한다. 회귀 모델은 선형 조합을 통해 출력값을 생성하므로, 학습 데이터의 범위를 넘어서는 값도 자연스럽게 예측할 수 있다. 이는 딥러닝에서 흔히 발생하는 출력 제한(activation saturation)이나 정규화 효과와 달리, 가중치가 직접적인 스케일링 역할을 수행하기 때문이다. 저자들은 이러한 회귀 헤드가 “외삽 친화적(extrapolation‑friendly)”이라고 정의한다.

실험 설계는 네 가지 외삽 시나리오와 하나의 시간적 스플릿을 포함한다. (1) 랜덤 스플릿은 전형적인 인터폴레이션 기준이며, (2) 호스트 기반 스플릿은 훈련에 포함되지 않은 새로운 결정구조를 예측한다. (3) 에너지 임계값 스플릿은 훈련 범위 밖의 형성 에너지(극히 안정하거나 불안정한 물질)를 목표로 하며, (4) 구조·에너지 복합 스플릿은 두 요소를 동시에 변형한다. 마지막으로 MP18→MP21 시간적 스플릿은 실제 연구 흐름을 모사해 2018년 데이터로 2021년 신규 물질을 예측한다.

결과는 일관되다. 인터폴레이션에서는 기존 CGCNN과 거의 동등한 R² > 0.995, RMSE ≈ 0.055 eV/atom을 기록한다. 구조 외삽에서는 테스트 RMSE = 0.099 eV/atom으로, 엔드‑투‑엔드 CGCNN(0.120 eV/atom)보다 우수했다. 특성 외삽에서는 RMSE = 0.205 eV/atom을 달성했으며, 엔드‑투‑엔드 모델은 훈련 범위에 머무는 현상을 보였다. 복합 외삽에서도 동일한 경향이 유지돼, 회귀 헤드가 훈련 데이터에 얽매이지 않고 선형적으로 확장될 수 있음을 증명한다.

실패 분석에서는 두 가지 주요 원인을 제시한다. 첫째는 “희소 원소” 문제로, 훈련에 충분히 등장하지 않은 원소가 포함된 경우 특징 벡터가 충분히 일반화되지 않는다. 둘째는 “불연속 전자 구조 전이”로, 기존 데이터베이스에 거의 존재하지 않는 결합 형태(예: 그래파이트와 같은 2D 층상 구조)에서는 사전학습된 GNN 자체가 해당 패턴을 포착하지 못한다. 이러한 경우는 추가적인 타깃 데이터 수집이나 특수한 사전학습 전략이 필요함을 시사한다.

전반적으로 이 논문은 “표현 학습은 대규모 사전학습으로, 물성 예측은 단순 회귀로”라는 두 가지 설계 원칙을 제시한다. 이는 기존의 “더 큰 모델, 더 깊은 학습” 패러다임을 뒤집으며, 실용적인 재료 탐색 파이프라인에 즉시 적용 가능하도록 만든다. 특히, 사전학습된 GNN을 그대로 활용하고, 회귀 모델만 교체하면 되므로 계산 비용과 구현 복잡도가 크게 낮아진다. 이러한 접근법은 향후 다양한 DFT 기반 물성(밴드갭, 전도도, 열전도도 등)에도 확장될 가능성이 높다.

댓글 및 학술 토론

Loading comments...

의견 남기기