다국어 주장 허위 검증 벤치마크 MUCH

초록

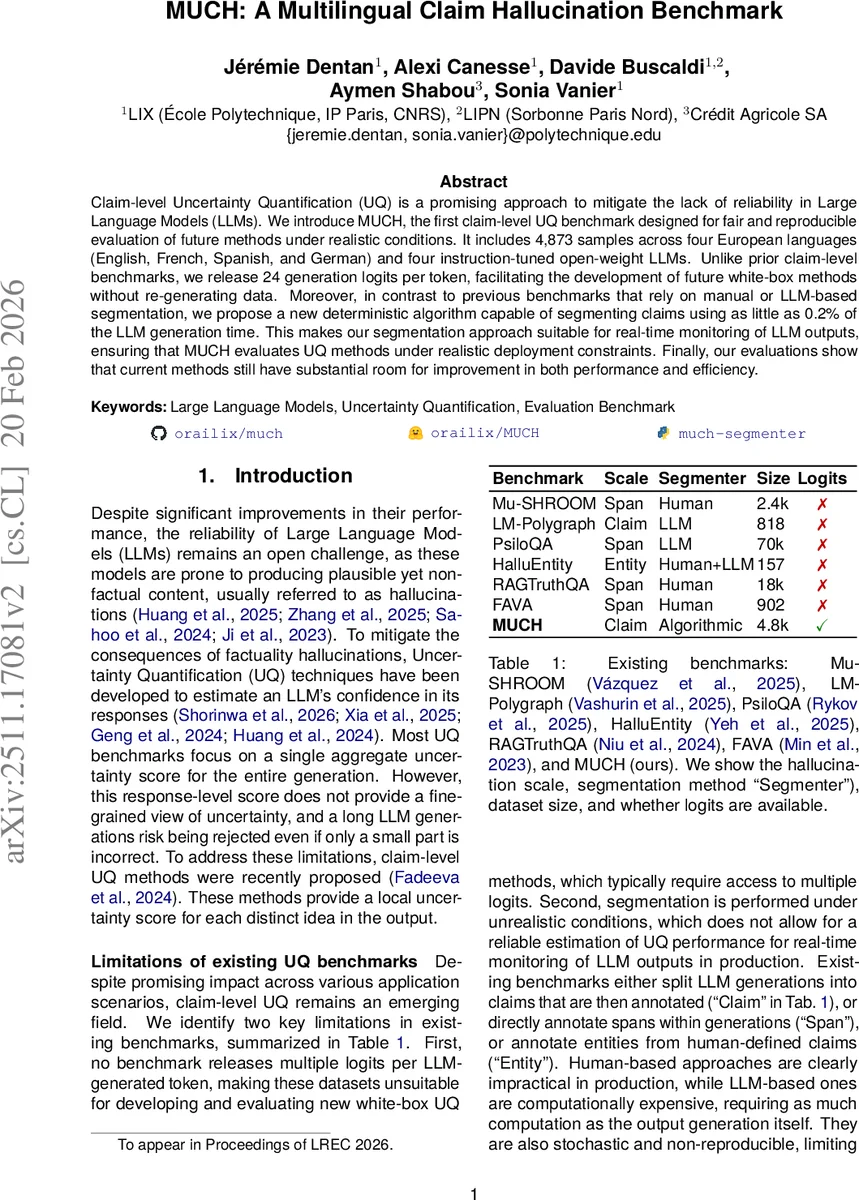

MUCH는 영어·프랑스어·스페인어·독일어 4개 언어와 4개의 오픈‑웨이트 LLM을 대상으로 4,873개의 응답을 수집한 최초의 주장‑레벨 불확실성 정량화(UQ) 벤치마크이다. 토큰당 24개의 로짓을 공개하고, 0.2 % 수준의 연산 비용으로 실시간 분할이 가능한 규칙 기반 claim‑segmenter를 제공한다. 현재 공개된 UQ 기법들은 성능·효율성 모두에서 크게 개선될 여지가 있음을 실험을 통해 보여준다.

상세 분석

MUCH는 기존 주장‑레벨 UQ 벤치마크가 갖고 있던 두 가지 근본적인 한계를 동시에 해결한다. 첫째, 대부분의 기존 데이터셋은 단일 로짓(또는 상위 k 개 로짓)만을 제공해 백‑박스 혹은 화이트‑박스 접근법을 제한했다. MUCH는 토큰당 24개의 로짓을 공개함으로써, 로그 확률, 엔트로피, 토큰‑레벨 신뢰도 등 다양한 화이트‑박스 메트릭을 자유롭게 실험할 수 있게 한다. 이는 특히 로그분포를 직접 활용하는 최신 UQ 방법(CCP, Token Likelihood 등)의 재현성을 크게 높인다.

둘째, 주장 분할 과정이 비현실적인 비용과 비결정성을 내포하고 있었다. 기존은 인간 어노테이션이나 별도 LLM을 이용해 “Claim”을 추출했으며, 이는 재현 불가능하거나 전체 파이프라인 비용이 생성 비용과 동등하거나 그 이상으로 증가하는 문제를 야기했다. MUCH는 규칙 기반 much_segmenter를 제안한다. 이 알고리즘은 NLTK TreebankWordTokenizer로 단어와 구두점을 추출하고, 사전 정의된 키워드·구두점 패턴을 이용해 주장 시작점을 식별한다. 이후 문자 인덱스를 토큰 인덱스로 매핑해 claim‑to‑token 정렬을 보장한다. 실험 결과 전체 데이터셋을 처리하는 데 소요된 연산량은 LLM 생성 시간의 0.2 %에 불과했으며, 완전 결정적이어서 동일 입력에 대해 언제나 동일한 분할 결과를 제공한다.

데이터 구축 과정도 꼼꼼히 설계되었다. 질문은 Mu‑SHROOM 테스트셋에서 200개씩 추출했으며, 각 질문에 대해 4개의 모델(Llama 3.1 8B‑Instruct, Llama 3.2 3B‑Instruct, Ministral 8B‑Instruct, Gemma 3.4B‑Instruct)와 두 가지 온도(1.0, 0.7)로 8개의 응답을 생성했다. 자동 라벨링은 GPT‑4o와 GPT‑4.1을 이용해 위키피디아 정답 페이지와 비교했으며, 두 모델의 라벨이 일치하는 경우에만 최종 샘플에 포함시켰다. 이 과정을 통해 20,751개의 주장에 대해 이진 사실성 라벨(‑1/ +1)을 확보했으며, 인간 검증을 소규모로 수행해 자동 라벨링의 품질을 확인했다(인간 간 변동성과 유사).

벤치마크 평가에서는 기존 최고 성능을 보인 CCP, SAR, Token Likelihood, Token Entropy, Maximum Likelihood 등 다섯 가지 화이트‑박스 메서드를 적용했다. 결과는 ROC‑AUC, PR‑AUC, TPR@10 % 등 다양한 지표에서 모두 70 % 이하의 성능을 기록, 현재 기술이 주장‑레벨 UQ에서 충분히 신뢰할 수 있는 수준에 도달하지 못했음을 시사한다. 특히 효율성 측면에서 로그‑수집 비용이 높은 모델은 실시간 서비스에 적용하기 어려운 것으로 드러났다.

MUCH는 다음과 같은 연구 방향을 제시한다. (1) 토큰‑레벨 로짓을 활용한 새로운 불확실성 추정기 설계, (2) 다언어 환경에서 언어별 특성을 반영한 claim‑segmenter 개선, (3) 라벨링 품질을 높이기 위한 인간‑LLM 혼합 어노테이션 프로토콜, (4) 실시간 모니터링 시나리오에 맞춘 경량화된 UQ 메트릭 개발 등이다. 전체적으로 MUCH는 주장‑레벨 UQ 연구에 필요한 데이터·도구·프로토콜을 한 번에 제공함으로써, 향후 연구자들이 보다 현실적인 조건에서 방법을 개발·비교할 수 있는 기반을 마련한다.

댓글 및 학술 토론

Loading comments...

의견 남기기