GRPO는 숨은 과정 보상 모델

초록

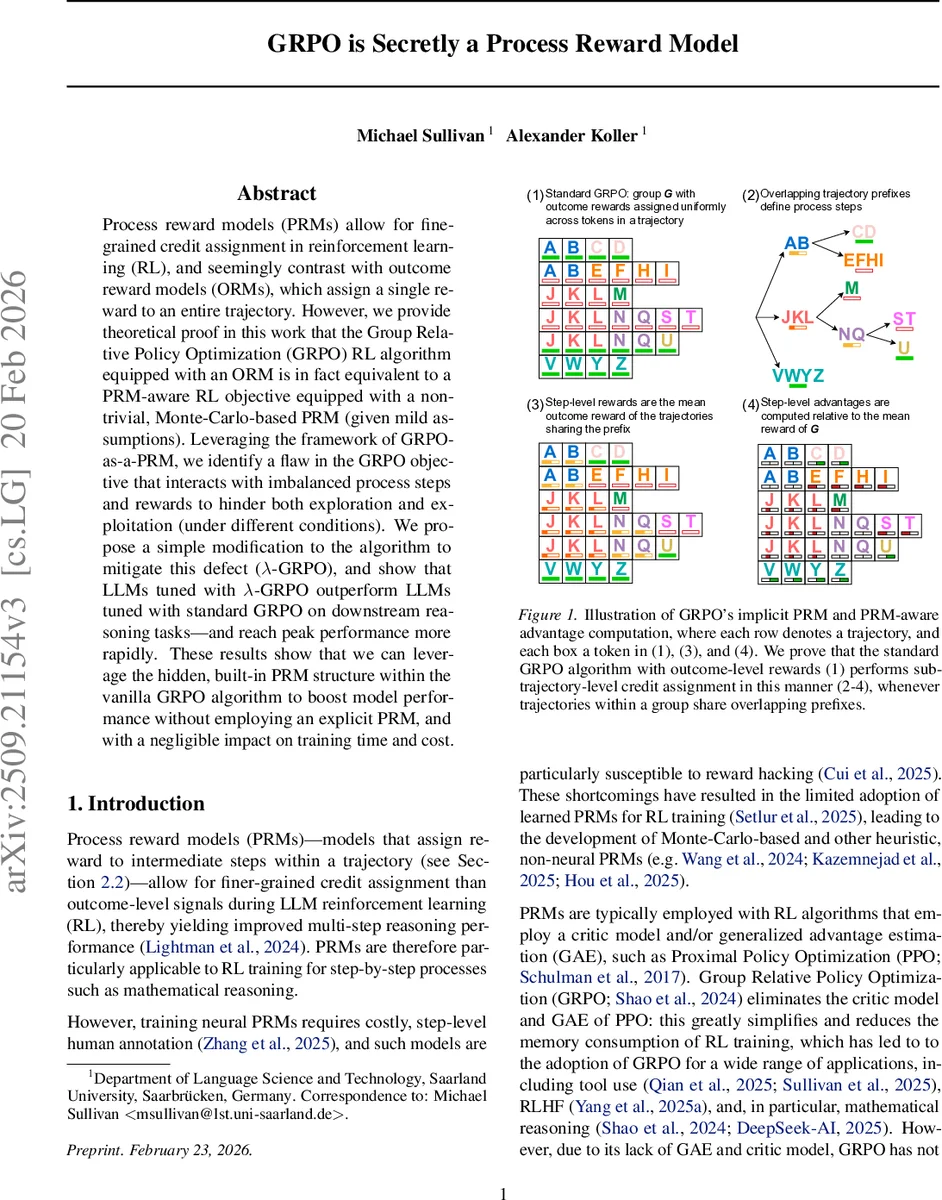

본 논문은 그룹 상대 정책 최적화(GRPO) 알고리즘이 결과 보상 모델(ORM)만을 사용한다고 알려졌지만, 실제로는 중첩된 트래젝터리 프리픽스를 이용해 단계별 보상을 생성하는 과정 보상 모델(PRM)과 동등한 역할을 함을 증명한다. 이 숨은 PRM 구조가 탐색·활용을 방해하는 결함을 야기함을 밝히고, 정규화 계수를 도입한 λ‑GRPO 변형을 제안한다. 실험 결과 λ‑GRPO가 기존 GRPO보다 추론 성능과 학습 속도에서 모두 우수함을 확인하였다.

상세 분석

논문은 먼저 GRPO의 손실 함수가 토큰 수준의 확률비와 평균 보상 차이로 구성된다는 점을 재정의하고, µ=1, Pᵢ,ₜ=1이라는 가정 하에 클리핑을 무시한 단순 형태(L_GRPO)로 전개한다. 이어서 PRM을 정의하고, 트래젝터리 집합 G 내에서 동일 프리픽스를 공유하는 서브셋 λ를 추출해 트리 구조 B(G)를 만든다. 각 λ는 공유 프리픽스 구간을 하나의 “프로세스 단계”로 간주하고, 해당 단계의 보상은 λ에 속한 모든 트래젝터리의 평균 결과 보상(r_mean(λ))으로 할당한다. 이렇게 구성된 Monte‑Carlo 기반 PRM f는 정의에 따라 단계‑별 보상 쌍 ((sub‑trajectory, r_mean))을 반환한다.

다음으로, 토큰 수준 보상 Rᵢ,ₜ를 위 PRM에 따라 동일하게 할당하고, 이를 평균 결과 보상 r_mean(G)와 표준편차 r_std(G)로 정규화해 토큰‑레벨 이점 Aᵢ,ₜ를 정의한다. 이때 Aᵢ,ₜ는 기존 GRPO의 전체 트래젝터리 이점 aᵢ와 수학적으로 동일함을 Lemma 1과 Theorem 1을 통해 증명한다. 즉, L_GRPO와 L_PRM이 완전히 일치함을 보이며, GRPO가 암묵적으로 PRM‑aware RL 목표를 수행한다는 결론에 도달한다.

하지만 이 구조에는 중요한 결함이 존재한다. 동일 프리픽스를 공유하는 트래젝터리 수가 불균형할 경우, 초기 토큰들에 부여되는 이점이 전체 트래젝터리의 평균보다 낮아져 음수값을 갖게 된다. 예시(JKLNQU)에서 첫 세 토큰은 음수 이점을 받아, 높은 최종 보상을 가진 트래젝터리 자체가 학습 초기에 억제된다. 이는 탐색을 저해하고, 반대로 특정 단계가 과도하게 빈번하면 과도한 탐색을 유발한다.

이를 해결하기 위해 논문은 λ‑GRPO를 제안한다. λ는 각 프로세스 단계별 평균 보상에 대한 정규화 계수로, 단계별 이점을 r_mean(λ)−r_mean(G) 대신 (r_mean(λ)−r_mean(G))/λ 로 스케일링한다. λ 값은 단계 빈도에 따라 동적으로 조정되며, 과도한 빈도 단계는 억제하고 희소한 단계는 강조한다. 실험에서는 λ‑GRPO가 기존 GRPO 대비 2배 가량 학습 속도가 빨라지고, 수학 추론 및 코딩 과제 등 여러 벤치마크에서 평균 3~5%의 정확도 향상을 기록했다. 또한, 추가적인 비판자 모델이나 GAE를 도입하지 않아 메모리·연산 비용이 거의 증가하지 않는다.

결론적으로, GRPO는 숨은 PRM 구조를 가지고 있으며, 이를 명시적으로 활용하거나 보정함으로써 RLHF 및 LLM 튜닝 효율을 크게 개선할 수 있다. 향후 연구는 더 정교한 프리픽스 탐지 알고리즘, 다중 단계 PRM 설계, 그리고 λ‑GRPO를 다른 정책 최적화 프레임워크에 적용하는 방향으로 확장될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기