비디오 질의 성능 예측을 위한 최초 벤치마크 VQPP

초록

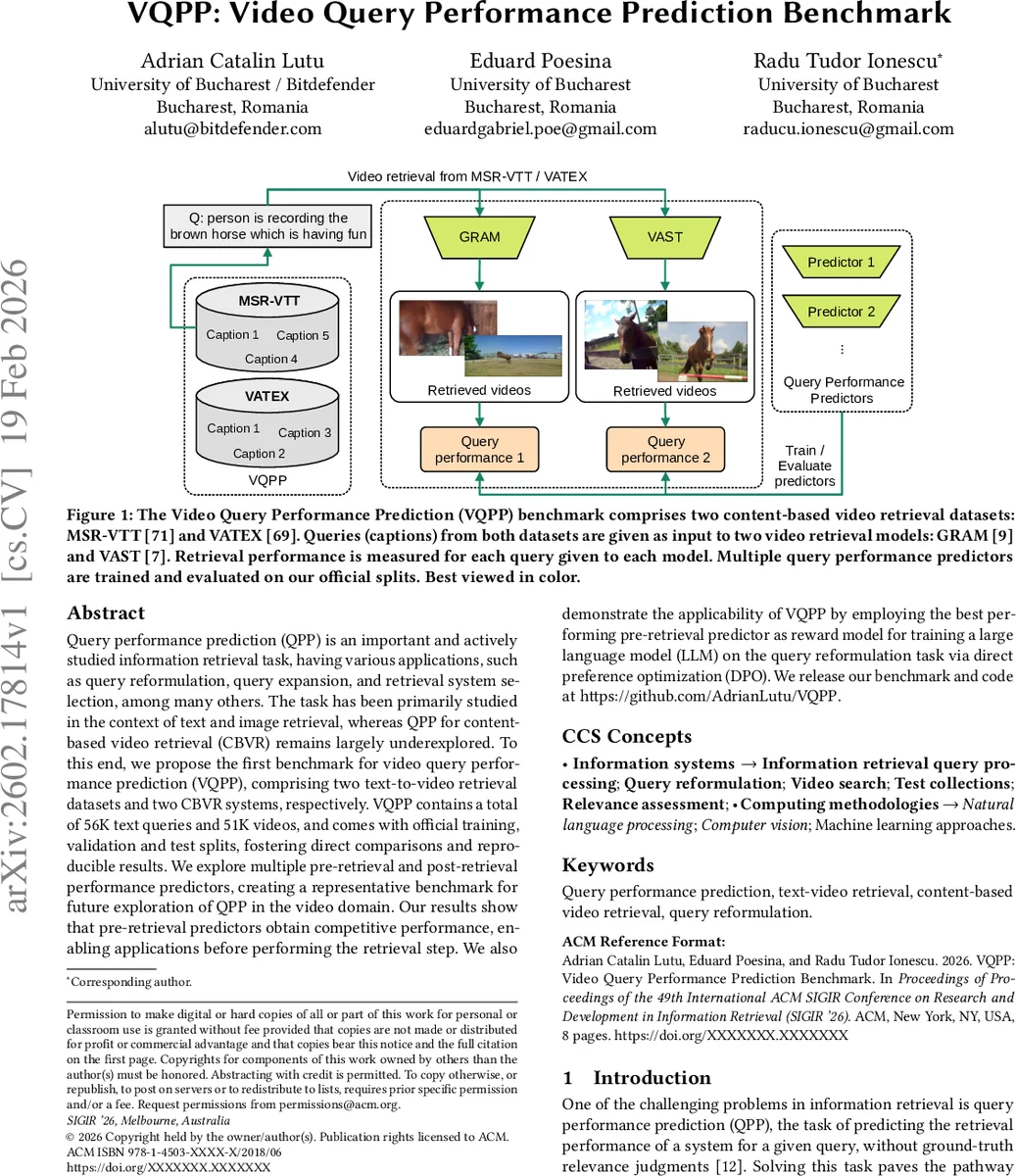

본 논문은 텍스트‑비디오 검색에서 질의당 검색 성능을 사전에 예측하는 VQPP 벤치마크를 제안한다. MSR‑VTT와 VATEX 두 데이터셋, GRAM·VAST 두 검색 모델을 결합해 56 천 개 질의와 51 천 개 비디오를 제공한다. 사전‑예측(pre‑retrieval)과 사후‑예측(post‑retrieval) 방식을 모두 평가했으며, BERT 기반 사전‑예측기가 모든 시나리오에서 최고 성능을 보였다. 또한 이 예측기를 보상 모델로 활용해 LLM을 직접 선호 최적화(DPO) 방식으로 질의 재작성에 튜닝, 검색 성능을 향상시켰다.

상세 분석

VQPP는 기존 텍스트·이미지 QPP 연구와 달리, 시간적·다중모달 특성을 가진 비디오 검색에 특화된 첫 번째 공개 벤치마크이다. 데이터 구성은 두 가지 측면에서 다양성을 확보한다. 첫째, MSR‑VTT는 10 000개의 ‘in‑the‑wild’ 비디오와 20개의 캡션을 제공해 풍부한 시각·언어 변동성을 담고 있다. 둘째, VATEX는 짧은 10초 클립 41 250개와 10개의 영문 캡션을 보유해 짧은 동영상에 대한 질의 특성을 반영한다. 두 데이터셋 모두 무작위 추출된 32 732·18 055개의 질의를 학습·검증·테스트로 분할해 총 56 K 질의를 확보하였다.

검색 모델로는 GRAM과 VAST를 선택했다. GRAM은 텍스트‑비디오 임베딩을 Gramian 볼륨 최소화라는 기하학적 제약으로 정렬해 높은 정밀도를 달성한다. VAST는 영상, 오디오, 자막, 텍스트 등 다중 모달을 통합해 시각 정보가 불명확한 경우에도 강건한 검색을 제공한다. 두 모델을 각각 적용해 112 K(질의·모델) 쌍에 대한 실제 검색 성능(RR, Recall@10)과 상위 100개의 결과 리스트를 사전 제공함으로써, 연구자는 무거운 비디오 검색 파이프라인 없이 QPP 모델을 학습·평가할 수 있다.

예측기 설계는 전통적인 통계 기반 사전‑예측(단어 수, synset 수, 품사 비율 등)과 최신 딥러닝 기반 사전‑예측(BERT, RoBERTa 등), 그리고 사후‑예측(클러스터링 경향, 스코어 분산, 명확도 점수 등)을 모두 포함한다. 실험 결과, 사전‑예측기 중 파인튜닝된 BERT가 Pearson ρ와 Kendall τ 모두에서 가장 높은 상관성을 기록했으며, 이는 검색 결과를 실제로 확인하지 않아도 질의 난이도를 정확히 추정할 수 있음을 의미한다. 흥미롭게도, 일부 깊은 사후‑예측기도 경쟁적인 성능을 보였지만, 계산 비용과 구현 복잡도 측면에서 사전‑예측이 유리했다.

가장 뛰어난 BERT 사전‑예측기를 보상 모델로 활용해, Phi‑4‑mini‑instruct LLM을 Direct Preference Optimization(DPO) 방식으로 질의 재작성에 튜닝하였다. 재작성된 질의는 원본보다 높은 RR·Recall@10을 달성했으며, 이는 QPP 예측기가 실제 검색 파이프라인 개선에 직접 활용될 수 있음을 입증한다.

전체적으로 VQPP는 (1) 대규모 텍스트‑비디오 질의·성능 데이터셋 제공, (2) 다중 검색 모델을 통한 일반화 평가, (3) 사전·사후 예측기 포괄적 비교, (4) QPP 기반 LLM 튜닝이라는 네 가지 핵심 기여를 한다. 향후 연구는 멀티모달 대형 모델, 비디오 메타데이터 활용, 그리고 실시간 질의 난이도 기반 라우팅 등으로 확장될 여지가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기