도메인 격차를 메우는 임상 섹션 구분 MIMICIII와 산과 기록의 비교

초록

본 논문은 공개된 MIMIC‑III 기반 섹션 구분 모델을 산과 전용 노트에 적용해 성능 차이를 평가하고, 제로샷 대형 언어 모델(LLM)의 활용 가능성을 검증한다. 감독 학습 모델은 도메인 내에서는 우수하지만 도메인 외에서는 급격히 성능이 떨어지는 반면, LLM은 섹션 헤더 오류를 교정하면 안정적인 결과를 보여준다.

상세 분석

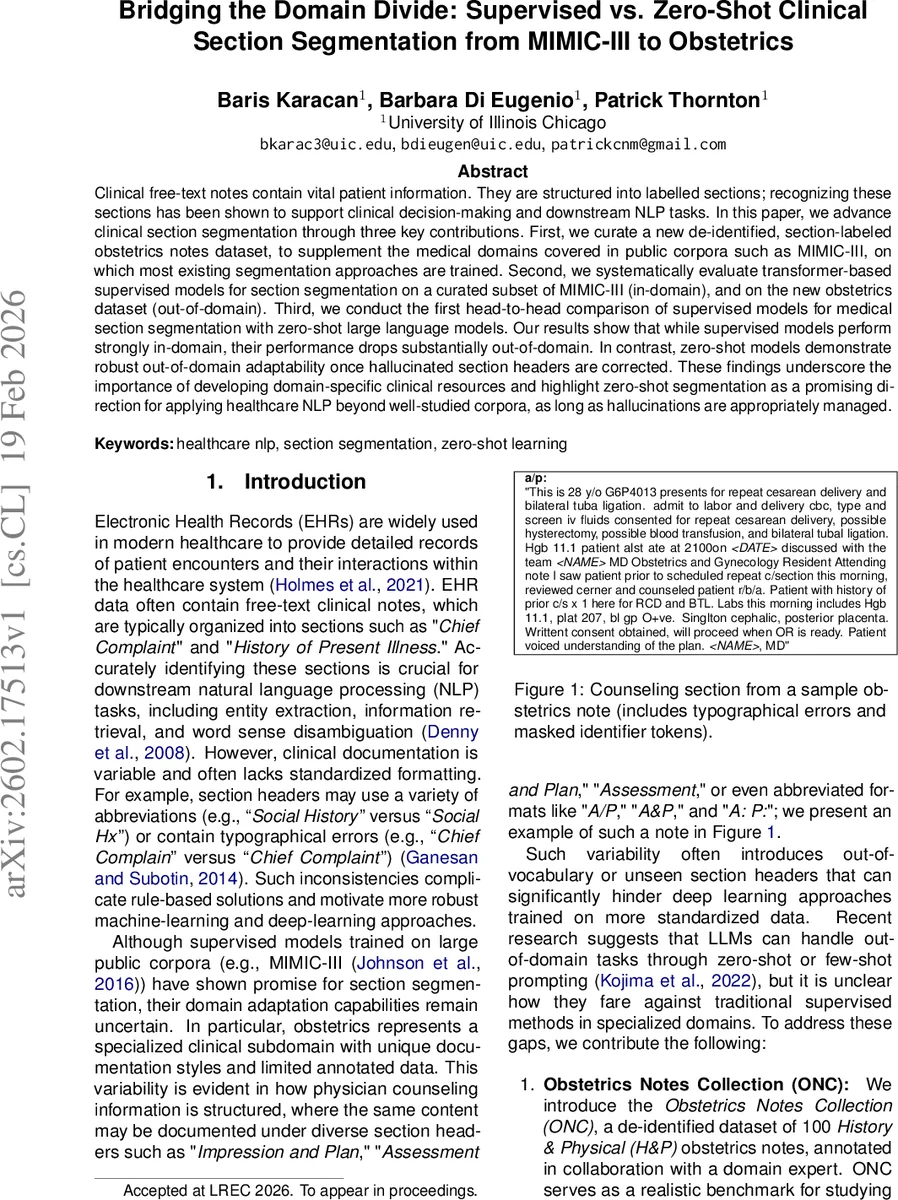

이 연구는 임상 텍스트의 섹션 구분이라는 구체적 과제를 두 가지 관점에서 심층적으로 탐구한다. 첫 번째는 기존의 대규모 공개 코퍼스인 MIMIC‑III(특히 MedSecId 서브셋)에서 훈련된 트랜스포머 기반 감독 학습 모델들의 일반화 능력을 평가하는 것이다. 여기서는 BERT‑base, BioBERT, BioMedBERT, GatorTron‑base 네 가지 사전학습 모델을 사용하고, 라인‑레벨 분류와 CRF를 결합한 시퀀스 라벨링 두 가지 아키텍처를 비교한다. 라인 단위 입력으로 전처리하여 토큰 길이를 100 이하로 제한함으로써 메모리 효율성을 확보했으며, 전체 라인 175,703개 중 80%를 학습, 20%를 테스트에 활용했다. 실험 결과, 도메인 내(MedSecId)에서는 평균 F1 점수가 0.92에 육박하는 높은 성능을 기록했지만, 동일 모델을 산과 전용 Obstetrics Notes Collection(ONC) 데이터에 그대로 적용했을 때 F1 점수가 0.58 이하로 급락했다. 이는 섹션 헤더의 다양성(예: “Pregnancy History”, “Gynecological History” 등)과 약어·오탈자 등 비표준 표현이 기존 라벨셋에 포함되지 않아 모델이 새로운 패턴을 인식하지 못함을 보여준다.

두 번째는 제로샷 LLM 접근법이다. Llama, Mistral, Qwen 등 최신 오픈소스 대형 언어 모델을 “섹션 헤더를 식별하고 해당 라인에 라벨을 부여하라”는 프롬프트로 직접 적용했다. 초기 결과는 헤더 인식률이 낮아 hallucination(허위 헤더 생성) 문제가 두드러졌지만, 연구팀은 사후 처리 단계에서 자동 정규화 규칙(예: “A/P”, “Assessment and Plan”을 “Assessment‑Plan”으로 통합)과 도메인 전문가 검증을 통해 허위 헤더를 교정했다. 교정 후에는 평균 F1 점수가 0.81에 달했으며, 특히 드물게 나타나는 섹션(예: “Consent”, “Prenatal Screens”)에서도 비교적 안정적인 인식을 보였다. 이는 LLM이 광범위한 사전 지식을 바탕으로 새로운 도메인에 빠르게 적응할 수 있음을 시사한다.

핵심 인사이트는 다음과 같다. (1) 현재 공개된 임상 섹션 데이터는 일반 내과·외과 중심이며, 산과·소아·정신과 등 특수 분야는 데이터가 부족해 감독 학습 모델의 도메인 전이 능력이 제한적이다. (2) 라인‑레벨 독립 입력 방식은 트랜스포머의 토큰 제한을 회피하지만, 섹션 간 전후 관계를 반영하지 못해 성능 저하 요인이 된다. (3) 제로샷 LLM은 사전 학습 단계에서 다양한 의료 문서를 접했기 때문에 새로운 헤더 패턴을 인식하는 데 유리하지만, hallucination을 방지하기 위한 사후 교정 파이프라인이 필수적이다. (4) 데이터 라벨링 비용을 최소화하고 빠른 도메인 확장을 원한다면, LLM 기반 제로샷 접근을 기본으로 두고, 오류 교정 및 소량의 도메인 특화 라벨을 추가하는 하이브리드 전략이 실용적이다.

댓글 및 학술 토론

Loading comments...

의견 남기기