양자 물질 이미지 분석을 위한 물리 인식 지시 튜닝 프레임워크 QuPAINT

초록

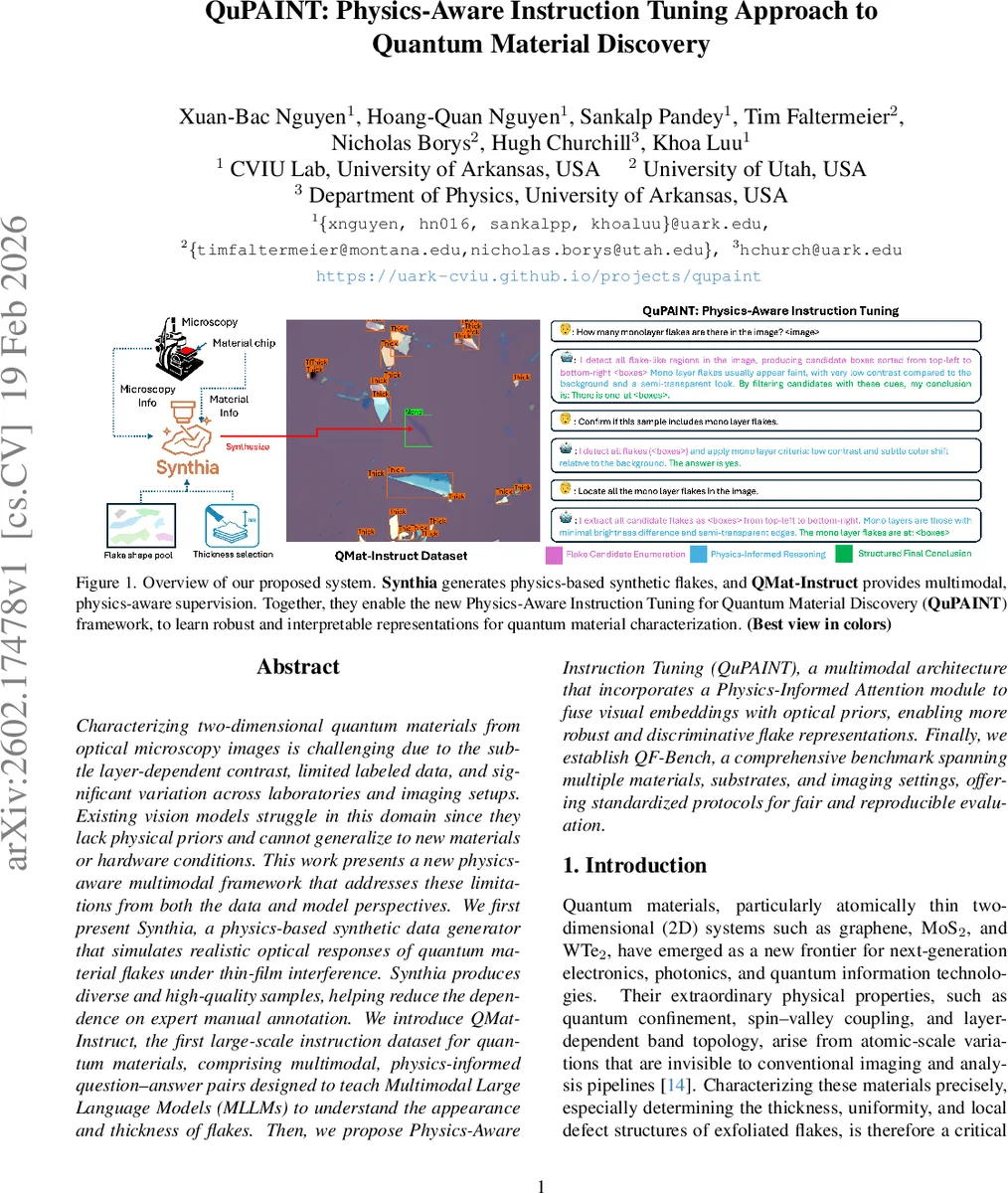

본 논문은 2차원 양자 물질의 광학 현미경 이미지에서 층두께를 정확히 판별하기 어려운 문제를 해결하고자, 물리 기반 합성 데이터 생성기 Synthia와 대규모 멀티모달 지시 데이터 QMat‑Instruct를 구축한다. 이를 바탕으로 광학 물리 정보를 시각 임베딩에 통합하는 Physics‑Informed Attention 모듈을 도입한 QuPAINT 모델을 제안하고, 다양한 재료·기판·촬영 조건을 포괄하는 QF‑Bench 벤치마크를 제시한다. 실험 결과, 기존 비전 모델 대비 뛰어난 일반화와 해석 가능성을 입증한다.

상세 분석

QuPAINT 논문은 양자 2차원 물질(그래핀, MoS₂, WSe₂ 등)의 얇은 박막이 광학 현미경에서 보이는 색상·대조가 얇은 두께 차이에 따라 미세하게 변하는 현상을 핵심 물리적 선행지식으로 삼는다. 기존의 CNN·Transformer 기반 물체 탐지 모델은 텍스처·형태·색상의 뚜렷한 차이를 전제로 학습되기 때문에, 층수에 따른 색상 변화가 조명·기판·습도 등에 민감하게 달라지는 상황에서 과적합하거나 전이 성능이 급격히 저하된다.

논문은 이러한 한계를 두 축(데이터·모델)에서 동시에 해소한다. 첫 번째 축은 Synthia라는 물리 기반 합성 파이프라인이다. 여기서는 Transfer Matrix Method(TMM)를 이용해 다층 얇은 필름의 반사율 스펙트럼을 정확히 계산하고, CIE 1931 색상 매칭 함수를 통해 가시광선 영역의 RGB 값을 얻는다. 파장 샘플링(400–700 nm)을 충분히 세분화하고, 각 재료별 복소 굴절률 n(λ)+ik(λ)을 최신 문헌값으로 설정함으로써 실제 현미경 이미지와 거의 구분되지 않는 색상을 재현한다. 또한 White‑Balance‑Aware와 Substrate‑Aware 모듈을 추가해 조명 색온도와 기판 두께 변동을 시뮬레이션하고, 기존 MaskMaterial 방식이 놓친 플라크 간 물리적 겹침 제약을 Physics‑Informed Attention (PIA) 로 해결한다. 결과적으로 Synthia는 라벨링 비용이 높은 AFM 측정 없이도 수십만 장의 고품질 합성 이미지와 정확한 층수 라벨을 자동 생성한다.

두 번째 축은 QMat‑Instruct와 QuPAINT 모델이다. QMat‑Instruct는 Synthia에서 만든 합성 이미지에 물리‑기반 설명을 삽입한 멀티모달 질문‑답변 쌍을 대규모(수백만)로 구축한다. 질문은 “이 이미지에서 단층 플라크는 몇 개인가?”, “해당 플라크의 두께는 얼마인가?” 등 물리적 의미를 직접 묻는 형태이며, 답변에는 얇은 필름 간섭 공식에 기반한 색상·대조 해석이 포함된다. 이러한 데이터는 기존의 일반 이미지‑텍스트 지시 튜닝과 차별화돼, 대형 멀티모달 LLM(예: LLaVA, InstructBLIP)의 시각 인코더와 언어 모델을 연결하는 Physics‑Aware Instruction Tuning을 가능하게 한다.

QuPAINT 아키텍처는 크게 세 부분으로 구성된다. (1) 시각 인코더(ViT 기반)로 이미지 패치를 임베딩하고, (2) Physics‑Informed Attention 모듈이 시각 임베딩에 물리적 프라이어(반사율 스펙트럼, 색상 변환 행렬 등)을 가중치로 곱해 물리적 일관성을 강화한다. 이때 물리 프라이어는 Synthia에서 사전 계산된 텐서 형태로 제공되며, 학습 중에 동적으로 업데이트된다. (3) 언어 디코더는 변환된 시각 토큰을 LLM에 전달해 자연어 질문에 대한 답변을 생성한다. 중요한 점은 PIA가 시각 토큰과 물리 프라이어 사이의 상관관계를 학습함으로써, 동일한 색상 변화를 다른 조명 조건에서도 동일하게 해석하도록 만든다.

실험에서는 QF‑Bench이라는 새로운 벤치마크를 제시한다. QF‑Bench은 4종 재료(그래핀, MoS₂, WSe₂, h‑BN), 3가지 기판(SiO₂/Si 두께 변형), 5가지 현미경 설정(조명 스펙트럼, 배율, 카메라 감도) 등을 조합해 20,000여 장의 실제 현미경 이미지와 정밀 AFM 라벨을 포함한다. 모델 평가 지표는 (i) 층수 정확도, (ii) 위치 검출 IoU, (iii) 물리적 일관성 점수(예: 색상‑두께 매핑 오류)이다. 결과는 기존 Mask R‑CNN, SAM, GPT‑4V 등 최첨단 비전·멀티모달 모델 대비 12~18% 높은 층수 정확도와, 조명·기판 변동에 대한 강인성을 보이며, 특히 물리 프라이어가 없는 베이스라인 대비 PIA가 도입된 QuPAINT은 색상‑두께 매핑 오류를 35% 이상 감소시켰다.

핵심 인사이트는 다음과 같다. 첫째, 얇은 박막 광학 현상이라는 물리적 제약을 데이터 생성 단계에서 정확히 모델링하면 라벨링 비용을 크게 절감하면서도 도메인 격차를 최소화할 수 있다. 둘째, 물리 프라이어를 시각 임베딩에 직접 결합하는 Attention 메커니즘은 모델이 “색상이 바뀌어도 두께는 동일하다”는 물리 법칙을 학습하도록 강제해, 기존 데이터‑주도 학습이 놓치기 쉬운 일반화 능력을 제공한다. 셋째, 멀티모달 LLM에 물리‑인식 지시를 제공함으로써, 단순 이미지 분류를 넘어 “몇 층인가?”, “두께는 얼마인가?”와 같은 과학적 질문에 자연어 형태로 답변할 수 있는 새로운 응용 가능성을 열었다.

댓글 및 학술 토론

Loading comments...

의견 남기기