가우시안 입력 마스킹을 이용한 2층 신경망 수렴 분석

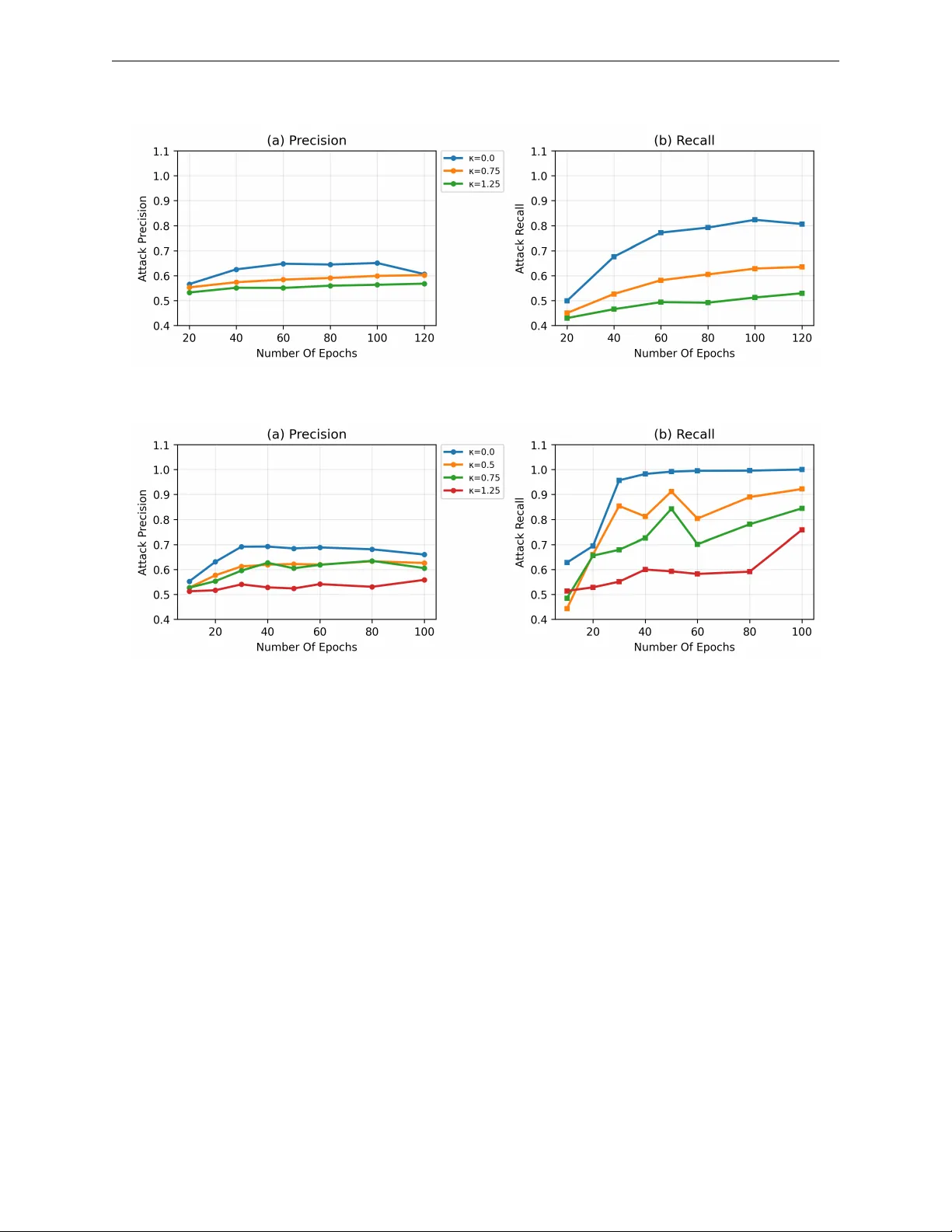

본 논문은 입력 레벨에서 가우시안 마스크를 적용한 2층 ReLU 신경망의 학습 수렴성을 NTK 관점에서 분석한다. 가우시안 드롭아웃 혹은 노이즈 입력 상황을 모델링한 뒤, 마스크 분산에 비례하는 오차 영역 내에서 선형 수렴을 보이며, 비선형 활성화 내부의 랜덤성을 정량화하는 새로운 기법을 제시한다.

저자: Afroditi Kolomvaki, Fangshuo Liao, Evan Dramko

본 논문은 가우시안 입력 마스킹(Gaussian input masking)이라는 설정 하에서 2층 ReLU 신경망의 학습 수렴성을 체계적으로 분석한다. 입력 마스킹은 각 입력 피처에 독립적인 정규분포 N(0,σ²) 잡음을 곱하거나 더하는 형태로 구현되며, 이는 가우시안 드롭아웃, 노이즈 입력 학습, 프라이버시 보호를 위한 입력 난수화, 연합 학습에서의 부분 관측 등 다양한 실제 상황을 모델링한다. 기존의 NTK(Neural Tangent Kernel) 분석은 고정된 입력 분포를 전제로 하지만, 마스크가 적용되면 입력 자체가 확률적 변동을 갖게 되므로 새로운 이론적 도구가 필요하다.

저자들은 먼저 마스크 적용 후 입력 x̃ = m⊙x (여기서 m∼N(1,σ²)이며 ⊙는 원소별 곱) 를 정의하고, 기대값 E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기