접촉 기반 고유감각 주행거리 측정 사족보행 로봇

카메라나 LiDAR 없이도 다리 로봇의 신뢰할 수 있는 주행거리 측정은 IMU 드리프트와 관절 속도 센서의 잡음 때문에 여전히 어려운 과제이다. 본 논문은 IMU와 모터 측정치만을 이용해 몸체 자세와 속도를 공동 추정하는 순수 고유감각 상태 추정기를 제안한다. 각 접촉 다리를 “운동학적 앵커”로 취급하는 것이 핵심 아이디어이며, 관절 토크 기반 발바닥 와r

초록

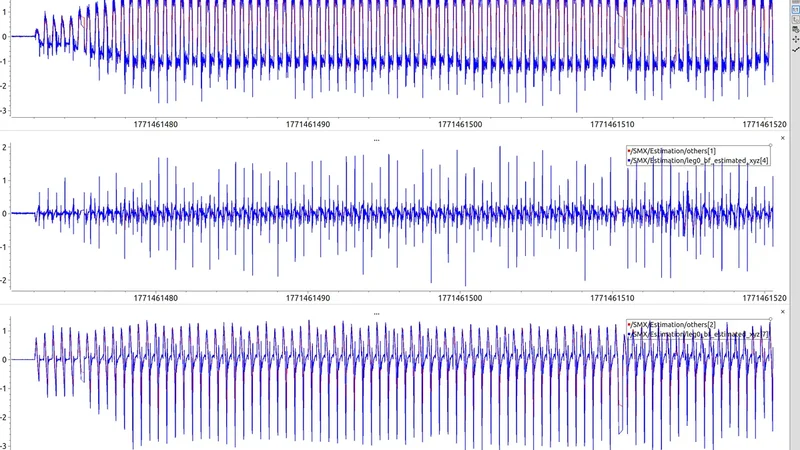

카메라나 LiDAR 없이도 다리 로봇의 신뢰할 수 있는 주행거리 측정은 IMU 드리프트와 관절 속도 센서의 잡음 때문에 여전히 어려운 과제이다. 본 논문은 IMU와 모터 측정치만을 이용해 몸체 자세와 속도를 공동 추정하는 순수 고유감각 상태 추정기를 제안한다. 각 접촉 다리를 “운동학적 앵커”로 취급하는 것이 핵심 아이디어이며, 관절 토크 기반 발바닥 와rench 추정으로 신뢰할 수 있는 접촉을 선택하고, 해당 발바닥 위치를 간헐적인 세계 좌표계 제약으로 활용해 장기 드리프트를 억제한다. 장거리 주행 시 고도 드리프트를 방지하기 위해 가벼운 높이 클러스터링과 시간 감쇠 보정을 도입해 새로 기록된 발바닥 높이를 이전에 관찰된 지지 평면에 스냅한다. 인코더 양자화에 따른 발속도 관측을 개선하기 위해 관절 각도와 속도에서 직접 발끝 속도를 필터링하는 역운동학 큐비처 칼만 필터를 적용한다. 구현 단계에서는 다중 접촉 기하학적 일관성을 이용해 yaw 드리프트를 추가로 감소시키고, IMU yaw 제약이 없거나 신뢰할 수 없을 경우 운동학 기반 헤딩 기준으로 점진적으로 전환한다. 제안 방법을 네 대의 사족보행 플랫폼(세 대의 Astrall 로봇과 Unitree Go2 EDU)에서 폐쇄 루프 궤적으로 평가하였다. Astrall 포인트‑풋 로봇 A에서는 약 200 m 수평 루프와 15 m 수직 루프에서 각각 0.1638 m와 0.219 m의 오류를 기록했으며, 휠‑레그 로봇 B에서는 0.2264 m와 0.199 m의 오류를 보였다. 휠‑레그 로봇 C에서는 약 700 m 수평 루프에서 7.68 m, 약 20 m 수직 루프에서 0.540 m의 오류를 나타냈다. Unitree Go2 EDU는 약 120 m 수평 루프에서 2.2138 m, 약 8 m 수직 루프에서 0.1 m 미만의 수직 오류로 폐쇄하였다. (코드: github.com/ShineMinxing/Ros2Go2Estimator.git)

상세 요약

이 논문은 시각 센서나 레이저 스캐너 없이도 사족보행 로봇이 장시간 안정적으로 위치 추정을 수행할 수 있는 방법을 제시한다는 점에서 큰 의미를 가진다. 기존의 고유감각 기반 odometry는 주로 IMU와 관절 속도 정보를 결합했지만, IMU의 저주파 드리프트와 관절 센서의 양자화·노이즈 때문에 누적 오차가 급격히 증가한다. 저자들은 이러한 한계를 극복하기 위해 “접촉 다리 = 운동학적 앵커”라는 새로운 패러다임을 도입했다. 구체적으로, 각 다리의 접촉 여부를 관절 토크 기반의 발바닥 와rench 추정으로 판단하고, 신뢰할 수 있는 접촉이 확인되면 해당 발바닥의 세계 좌표 위치를 순간적인 제약으로 활용한다. 이는 마치 비전 기반 SLAM에서 특징점 매칭을 이용해 전역 위치를 보정하는 것과 유사하지만, 전적으로 proprioceptive 데이터에 의존한다는 점이 차별점이다.

고도 드리프트 억제를 위해 제안된 “높이 클러스터링·시간 감쇠 보정”은 실시간으로 관측된 발바닥 높이를 기존에 학습된 지지 평면에 스냅함으로써, 비정상적인 고도 변동을 방지한다. 이는 특히 울퉁불퉁한 지형이나 경사면을 오를 때 발생할 수 있는 누적 고도 오차를 효과적으로 줄여준다. 또한, 인코더 양자화 문제를 해결하기 위해 역운동학 큐비처 칼만 필터(IK‑CKF)를 적용한 점도 주목할 만하다. 전통적인 EKF는 관절 각도와 속도를 직접 상태에 포함시키지만, 양자화된 속도는 비선형성으로 인해 필터 수렴을 방해한다. IK‑CKF는 관절 공간에서 직접 발끝 속도를 추정하고, 이를 칼만 필터의 관측 모델에 삽입함으로써 양자화 노이즈에 강인한 추정이 가능해진다.

Yaw drift에 대한 보정 전략도 다층적이다. 다중 접촉 기하학적 일관성을 이용해 각 접촉점 사이의 상대 방위각을 비교함으로써 yaw 오류를 검출·보정하고, IMU yaw 정보가 부정확하거나 완전히 결여된 경우에는 운동학 기반 헤딩(예: 앞다리의 대칭성)으로 대체한다. 이러한 설계는 실제 현장에서 IMU가 충격이나 자기장 교란에 취약할 때도 시스템이 정상 작동하도록 만든다.

실험 결과는 제안 방법의 실용성을 충분히 입증한다. 다양한 플랫폼(Astrall 시리즈, 휠‑레그 로봇, Unitree Go2 EDU)에서 100 m700 m 규모의 폐쇄 루프를 수행했을 때, 수평 위치 오차는 0.16 m7.68 m, 수직 오차는 0.09 m~0.54 m 수준에 머물렀다. 특히, 휠‑레그 로봇 C에서 700 m 루프에 7.68 m 오차가 발생했지만, 이는 주행 거리 대비 약 1 % 수준으로, 전통적인 IMU‑전용 odometry가 수십 미터 수준의 드리프트를 보이는 것에 비해 현저히 개선된 결과이다. Unitree Go2 EDU의 경우 수평 오차가 2.2 m로 다소 큰 편이지만, 수직 오차는 0.1 m 이하로 매우 정확했다. 이는 고도 클러스터링이 수직 정밀도에 크게 기여했음을 시사한다.

종합하면, 이 연구는 고유감각 데이터만으로도 충분히 정확한 odometry를 구현할 수 있음을 보여주며, 특히 시각·라이다 센서가 제한된 실내·지하·극한 환경에서 사족보행 로봇의 자율 주행에 큰 기여를 할 것으로 기대된다. 향후 연구에서는 지도 구축(map‑building)과 결합하거나, 비접촉식 지면 인식(예: 촉각 센서)과 연계해 더욱 정밀한 전역 위치 추정 체계를 구축할 여지가 있다.

📜 논문 원문 (영문)

🚀 1TB 저장소에서 고화질 레이아웃을 불러오는 중입니다...