선형 시간 디코더‑전용 RetNet 기반 손글씨 인식 모델 DRetHTR

초록

**

본 논문은 기존 Transformer 기반 손글씨 인식 모델이 디코딩 시 KV‑캐시가 급증해 속도와 메모리 사용량이 크게 늘어나는 문제를 해결하고자, Retentive Network(RetNet)를 기반으로 한 디코더‑전용 아키텍처 DRetHTR을 제안한다. 소프트맥스‑프리 retention과 다중 스케일 순차적 사전(prior)을 도입해 KV‑캐시 없이 선형 시간·선형 메모리 디코딩을 구현하고, 층별 γ 스케일링으로 지역‑전역 의존성을 단계적으로 확장한다. 동일 규모 Transformer 대비 1.6‑1.9배 빠른 추론과 38‑42% 적은 메모리 사용을 달성하면서 IAM, RIMES, Bentham 등 주요 데이터셋에서 최고 수준의 CER을 기록한다.

**

상세 분석

**

DRetHTR은 RetNet의 핵심 아이디어인 “softmax‑free retention”을 손글씨 텍스트 인식에 맞게 변형하였다. 기존 Transformer는 디코딩 시 매 토큰마다 전체 시퀀스에 대한 Q·K·V를 계산하고, 이를 KV‑캐시에 저장해 O(N²) 메모리를 요구한다. RetNet은 복소수 위상 Θ와 하삼각 decay 행렬 D를 이용해 Q·K·V를 선형적으로 누적하는 재귀식 Sₙ = γ·Sₙ₋₁ + kₙᵀ·vₙ을 도입함으로써 O(1) 연산과 O(N) 메모리만으로 동일한 컨텍스트 효과를 구현한다.

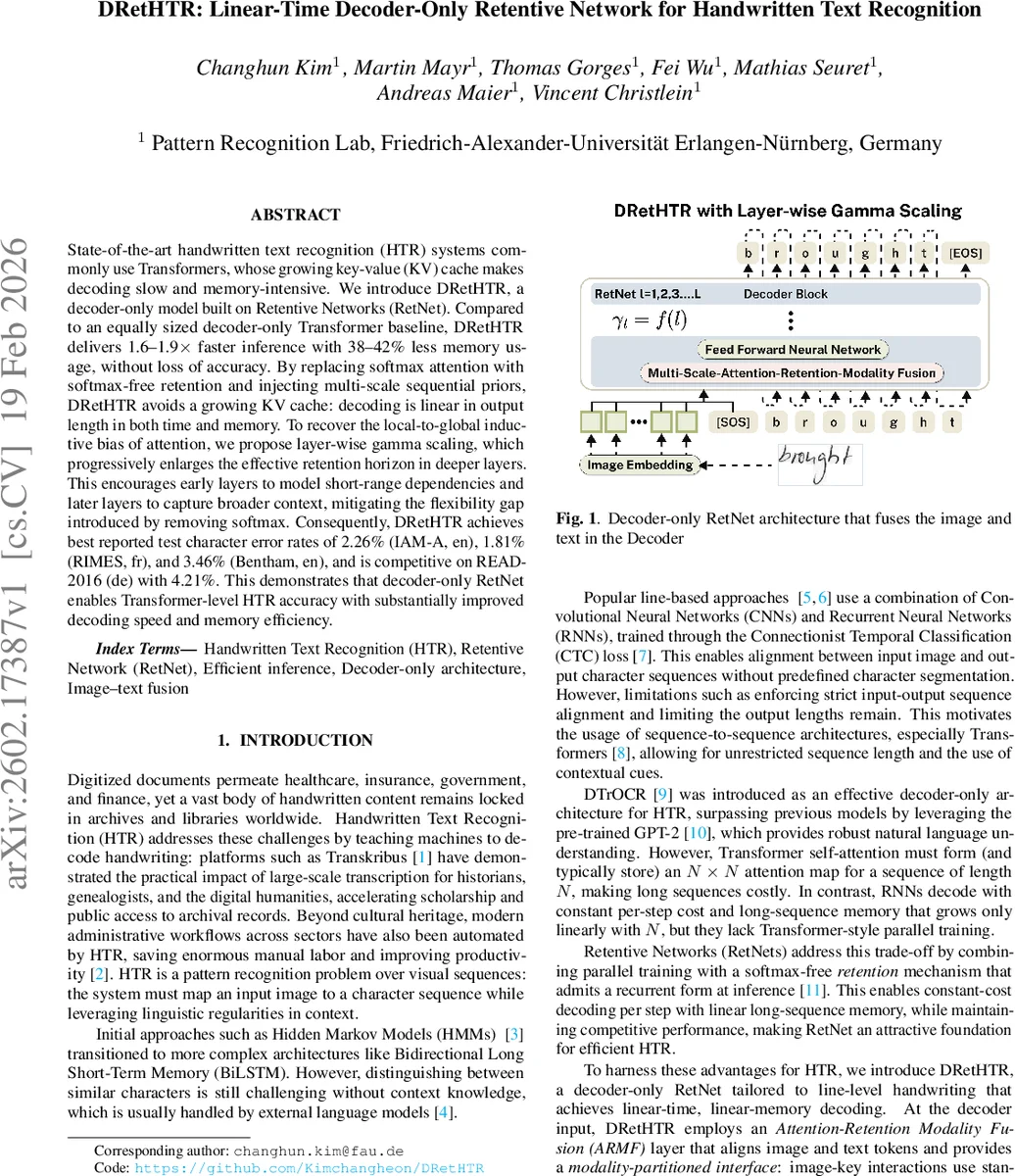

핵심 기여는 두 가지이다. 첫째, 이미지‑텍스트 융합을 위해 Attention‑Retention Modality Fusion (ARMF) 레이어를 설계했다. 이미지 토큰은 기존 softmax 기반 멀티‑헤드 어텐션으로 처리해 시각적 정렬을 유지하고, 텍스트 토큰은 retention을 적용해 재귀적 연산을 가능하게 한다. 이미지‑텍스트 간 교차 어텐션은 이미지‑키에만 제한함으로써 KV‑캐시가 텍스트 길이에 따라 증가하지 않도록 설계했다.

둘째, 층별 γ 스케일링을 도입해 각 레이어마다 decay factor γ를 점진적으로 증가시켰다. 얕은 레이어는 작은 γ(짧은 기억)로 지역 의존성을 강조하고, 깊은 레이어는 큰 γ(긴 기억)로 전역 컨텍스트를 포착한다. 이는 softmax 어텐션이 제공하던 “local‑to‑global” inductive bias를 retention 구조에 재현하는 역할을 한다. 실험 결과, γ 스케줄링 없이 고정 γ를 사용하면 정확도가 크게 떨어지지만, 제안된 스케일링을 적용하면 Transformer와 동등한 CER을 유지하면서도 선형 디코딩 효율을 확보한다.

성능 측면에서 DRetHTR은 동일 파라미터 수의 디코더‑전용 Transformer와 비교해 1.6‑1.9배 빠른 추론 속도와 38‑42% 적은 메모리 사용을 보이며, IAM‑A(2.26 %), RIMES(1.81 %), Bentham(3.46 %) 등에서 최고 수준의 문자 오류율을 달성했다. 또한 READ‑2016(독일어)에서도 4.21 % CER로 경쟁력을 입증했다.

이러한 설계는 대규모 손글씨 데이터셋에서 실시간 혹은 저자원 환경(예: 모바일 디바이스)으로의 적용 가능성을 크게 확대한다. 다만, 현재는 라인‑레벨 인식에 초점을 맞추었으며, 페이지‑레벨 레이아웃 분석이나 복잡한 다중 라인 문서에 대한 확장은 추가 연구가 필요하다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기