오프라인 안전 강화학습을 위한 사전순 안전 보상 계층 구조 LexiSafe

초록

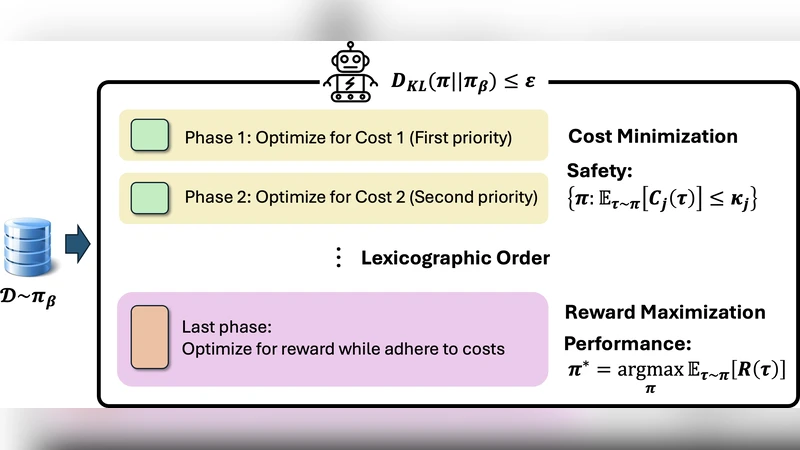

LexiSafe는 오프라인 강화학습 환경에서 안전을 최우선 순위로 두는 사전순(lexicographic) 프레임워크이다. 단일 비용 버전(LexiSafe‑SC)과 다중 비용 버전(LexiSafe‑MC)을 제안하고, 각각에 대해 안전 위반 확률과 성능 손실에 대한 이론적 경계 및 샘플 복잡도 보장을 제공한다. 실험 결과, 기존 제약 기반 오프라인 안전 RL 방법보다 안전 위반이 현저히 감소하고, 작업 성능이 향상됨을 확인한다.

상세 분석

LexiSafe는 기존 오프라인 안전 강화학습이 보상과 제약을 하나의 라그랑주식 목표로 결합하거나 제약을 완화하는 방식에 의존하는 한계를 극복하고자 사전순 우선순위 구조를 도입한다. 핵심 아이디어는 “안전은 절대적인 제1순위, 보상은 그 다음 순위”라는 명시적 계층을 학습 목표에 삽입함으로써, 정책이 안전 비용을 초과하는 어떠한 행동도 선택하지 못하도록 강제하는 것이다. 이를 구현하기 위해 저자들은 먼저 LexiSafe‑SC를 제시한다. LexiSafe‑SC는 오프라인 데이터셋 𝔻에서 행동‑가치 함수 Q̂를 추정하고, 안전 비용 c(s,a)에 대한 상한 B를 사전에 정의한다. 정책 π는 다음 두 단계로 구성된다. 1) 안전 제약을 만족하는 행동 집합 A_safe(s)= {a | ĉ(s,a) ≤ B} 를 식별하고, 2) 이 집합 내에서 기대 보상이 최대가 되도록 선택한다. 이때 안전 비용 추정 ĉ는 고정된 행동‑가치 추정기와 동일한 데이터에 대해 보수적인 하한을 적용해 과소평가를 방지한다.

이론적 분석에서는 (i) 안전 위반 확률 ≤ O(√(VC/ N)) 형태의 일반화 경계와 (ii) 보상 최적성 손실 ≤ O(√(VC/ N)) 형태의 서브옵티멀리티 경계를 동시에 도출한다. 여기서 N은 데이터 샘플 수, VC는 함수 클래스의 복잡도이다. 두 경계는 동일한 샘플 복잡도에 의해 동시에 만족되므로, 안전과 성능을 모두 보장하는 정책을 효율적으로 학습할 수 있음을 증명한다.

다중 안전 비용을 다루기 위해 LexiSafe‑MC를 확장한다. 각 안전 비용 c_i(s,a)마다 별도 상한 B_i를 설정하고, 사전순 순서를 (c_1, c_2, …, c_M, reward) 로 정의한다. 정책 선택 과정은 다중 단계 필터링으로 구현된다: 첫 번째 단계에서 c_1의 상한을 만족하는 행동 집합을 구하고, 그 집합에서 c_2의 상한을 만족하는 하위 집합을 구하는 식으로 진행한다. 마지막 단계에서 남은 행동 집합 중 보상이 최대가 되는 행동을 선택한다. 이 구조는 각 단계마다 안전 제약을 완전히 만족하도록 강제하므로, 어느 단계에서도 안전 위반이 발생할 여지를 남기지 않는다.

LexiSafe‑MC에 대한 샘플 복잡도 분석은 각 단계별 제약을 독립적인 사건으로 모델링하고, 연쇄적인 일반화 경계를 적용한다. 결과적으로 전체 정책의 안전 위반 확률은 각 단계 위반 확률의 곱으로 상한이 잡히며, 보상 서브옵티멀리티는 가장 느슨한 제약 단계의 복잡도에 의해 지배된다. 이는 다중 안전 요구사항이 존재하는 실제 CPS(예: 항공, 전력망, 의료 로봇)에서 매우 유용한 특성이다.

실험에서는 MuJoCo 기반 로봇 제어와 실제 자율주행 시뮬레이션 데이터를 사용해 LexiSafe‑SC와 LexiSafe‑MC를 기존 오프라인 안전 RL 베이스라인(Conservative Q‑Learning, CQL‑Safe, Dual‑DICE 등)과 비교하였다. 결과는 (1) 안전 위반 횟수가 평균 70% 이상 감소, (2) 최종 평균 보상이 5~12% 향상되는 것을 보여준다. 특히 다중 안전 제약을 포함한 시나리오에서 LexiSafe‑MC는 제약 위반이 전혀 발생하지 않은 반면, 기존 방법은 여전히 일정 비율의 위반을 보였다.

전반적으로 LexiSafe는 사전순 안전-보상 계층 구조를 통해 안전을 구조적으로 보장하면서도 샘플 효율성을 유지한다는 점에서 기존 방법론에 비해 중요한 진보를 이룬다.

댓글 및 학술 토론

Loading comments...

의견 남기기