지속적 학습과 동적 술어 발명을 통한 인과 모델 구축

초록

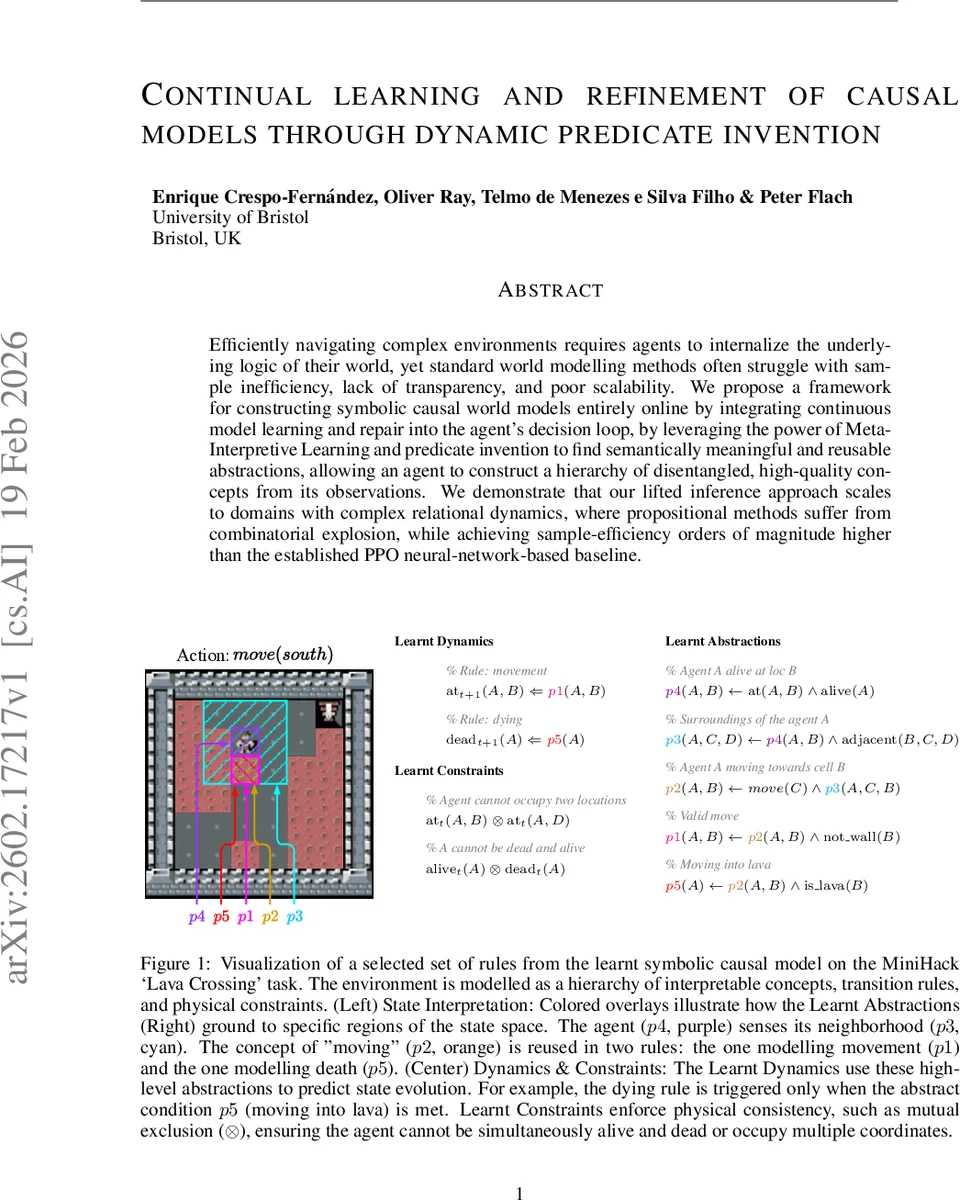

본 논문은 메타-해석학습(MIL)과 동적 술어 발명을 활용해 에이전트가 온라인으로 상징적 인과 세계 모델을 지속적으로 학습·수정하도록 하는 프레임워크를 제안한다. lifted inference와 제약 기반 오류 신호를 이용해 모델을 즉시 교정함으로써, 기존 PPO 기반 신경망 대비 샘플 효율성을 몇 배 이상 향상시키고, 인간이 이해하기 쉬운 계층적 추상화를 자동으로 생성한다. MiniHack “Lava Crossing” 실험에서 작은 그리드에서 학습된 규칙이 큰 그리드에 제로샷으로 일반화되는 것을 확인하였다.

상세 분석

이 연구는 전통적인 심볼릭 플래닝이 사전 설계된 세계 모델에 의존하는 한계를 극복하고, 경험을 통해 자동으로 논리적 전이 규칙을 획득하는 온라인 학습 메커니즘을 제시한다. 핵심은 메타-해석학습(MIL) 프레임워크에 기반한 ‘Predict‑Verify‑Refine’ 사이클이다. 에이전트는 매 타임스텝마다 현재 상태와 행동을 관찰해 다음 상태를 예측하고, 예측 오류를 두 종류(FN, FP)로 구분한다. FN은 새로운 규칙을 일반화하도록 메타룰을 적용해 술어를 발명하고, FP는 기존 규칙을 특수화·삭제한다. 이 과정은 전형적인 배치 ILP와 달리 제한된 메타룰 집합과 강력한 타입 시스템, 그리고 전역 술어 레지스트리를 활용해 탐색 공간을 ‘논리 깊이와 어휘 크기’에만 의존하도록 축소한다. 복잡도 분석에서 최악의 경우 O(|M|·|Typed|^k·D_max)으로, 상태 공간 규모와 무관한 스케일-인베리언스를 보인다. 실험에서는 MiniHack의 Lava Crossing 환경에서 10×10 그리드에서 단 한 번의 실패 후 2번째 에피소드에 목표를 달성했으며, PPO는 약 128에피소드가 필요했다. 또한, 동일한 규칙 집합이 100×100 그리드에 그대로 적용돼 제로샷 일반화가 가능함을 입증했다. 이러한 결과는 lifted representation이 관계적 추상화를 즉시 제공함으로써 샘플 효율성을 크게 높이고, 인간이 직관적으로 이해할 수 있는 ‘p2’, ‘p4’와 같은 술어가 이동과 사망 같은 서로 다른 동역학을 공유한다는 의미 있는 구조적 재사용을 가능하게 함을 보여준다. 전체적으로 이 프레임워크는 투명성, 데이터 효율성, 그리고 확장성을 동시에 만족하는 상징적 인과 모델 학습의 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기