엔트로피 기반 시각 토큰 프루닝

초록

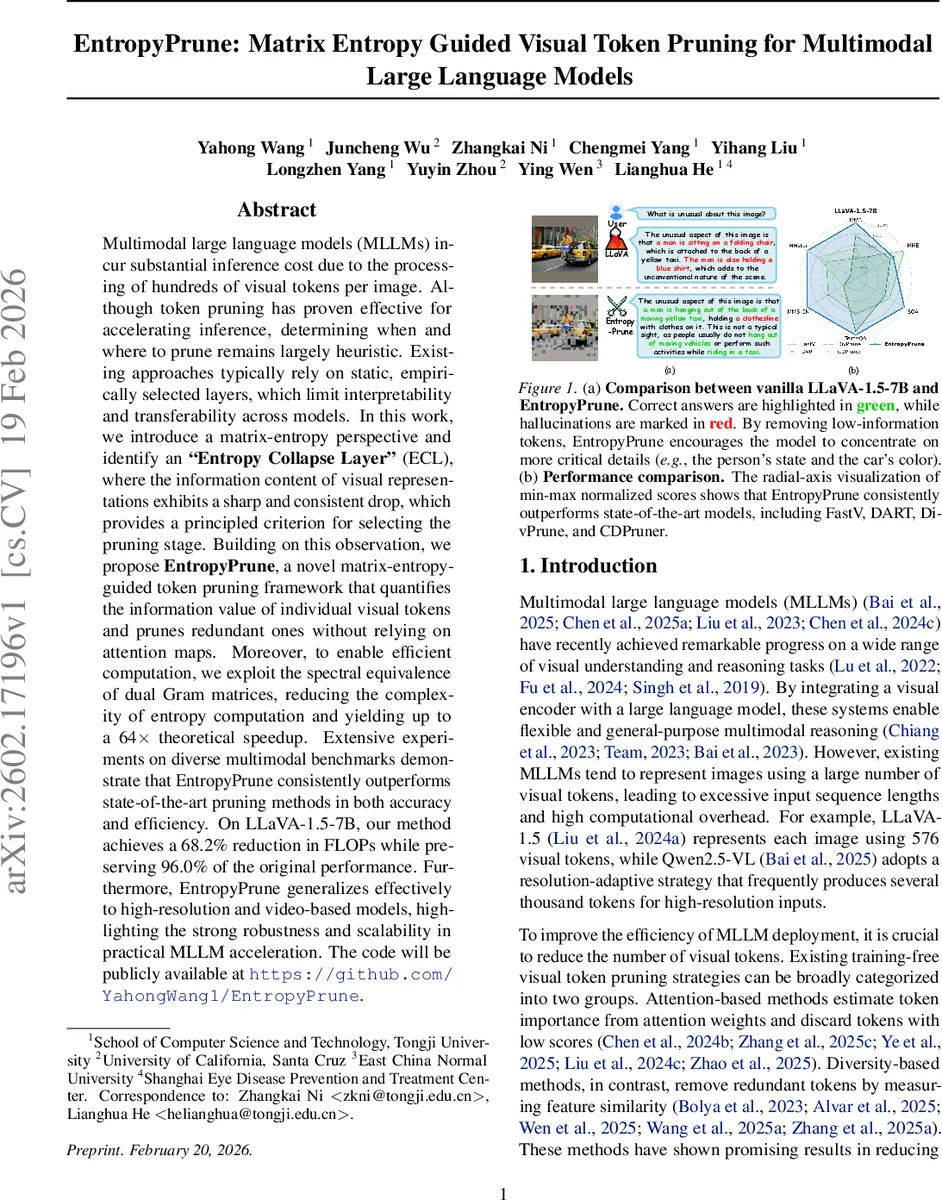

본 논문은 멀티모달 대형 언어 모델에서 시각 토큰의 정보량을 행렬 엔트로피로 정량화하고, 정보가 급격히 감소하는 “엔트로피 붕괴 층(ECL)”을 기준으로 토큰을 선택적으로 제거하는 EntropyPrune 기법을 제안한다. dual Gram 행렬의 스펙트럴 동등성을 이용해 엔트로피 계산 비용을 크게 낮추면서도 FLOPs를 68 % 이상 절감하고 원래 성능의 96 %를 유지한다.

상세 분석

EntropyPrune은 기존 토큰 프루닝 방법이 주로 주의력 가중치나 토큰 간 유사도에 의존해 경험적으로 층을 선택하는 한계를 극복한다. 저자들은 먼저 시각 토큰의 쿼리·키 행렬에 대해 트레이스 정규화 공분산을 구하고, 이를 양자역학의 밀도 행렬과 동일시한 뒤 von Neumann 엔트로피 형태로 정보량을 측정한다. 실험적으로 LLaVA‑1.5‑7B와 LLaVA‑Next‑7B 모델의 8개 데이터셋에 걸친 레이어별 엔트로피 변화를 분석했을 때, 두 번째 레이어 이후 엔트로피가 급격히 하락하는 공통 패턴을 발견했으며, 이를 “Entropy Collapse Layer(ECL)”이라 명명하였다. ECL은 시각 토큰이 중복되고 불필요한 정보를 압축하기 시작하는 시점으로, 여기서부터 토큰을 제거해도 모델의 표현력 손실이 최소화된다.

프루닝 대상 토큰을 선정하기 위해 저자들은 각 토큰을 헤드 차원별로 재구성하고, 헤드 내부의 공분산 행렬을 다시 트레이스 정규화한다. 이 행렬의 고유값을 이용해 토큰별 엔트로피를 계산하고, 엔트로피가 낮은 토큰을 삭제한다. 직접적인 고유값 분해는 O(d³) 복잡도로 비현실적이지만, 행렬의 Gram 형태와 그 전치 행렬이 공유하는 비영 영 스펙트럼 특성을 활용해 d 대신 h(헤드 수) 차원에서 고유값을 구함으로써 이론상 64배 가속을 달성한다.

성능 평가에서는 LLaVA‑1.5‑7B에 대해 시각 토큰 77.8 %를 제거하고 FLOPs를 68.2 % 절감했으며, 기존 최첨단 프루닝 기법(FastV, DART, DivPrune, CDPruner) 대비 정확도와 효율성 모두에서 우위를 보였다. 또한 고해상도 이미지와 비디오 입력에서도 동일한 ECL 현상이 관찰되어, 제안 방법이 다양한 멀티모달 시나리오에 일반화 가능함을 입증한다. 코드 공개 예정이며, 훈련 없이 바로 적용 가능한 점이 실용성을 크게 높인다.

댓글 및 학술 토론

Loading comments...

의견 남기기