시간 시계열 이해와 생성 통합 프레임워크

초록

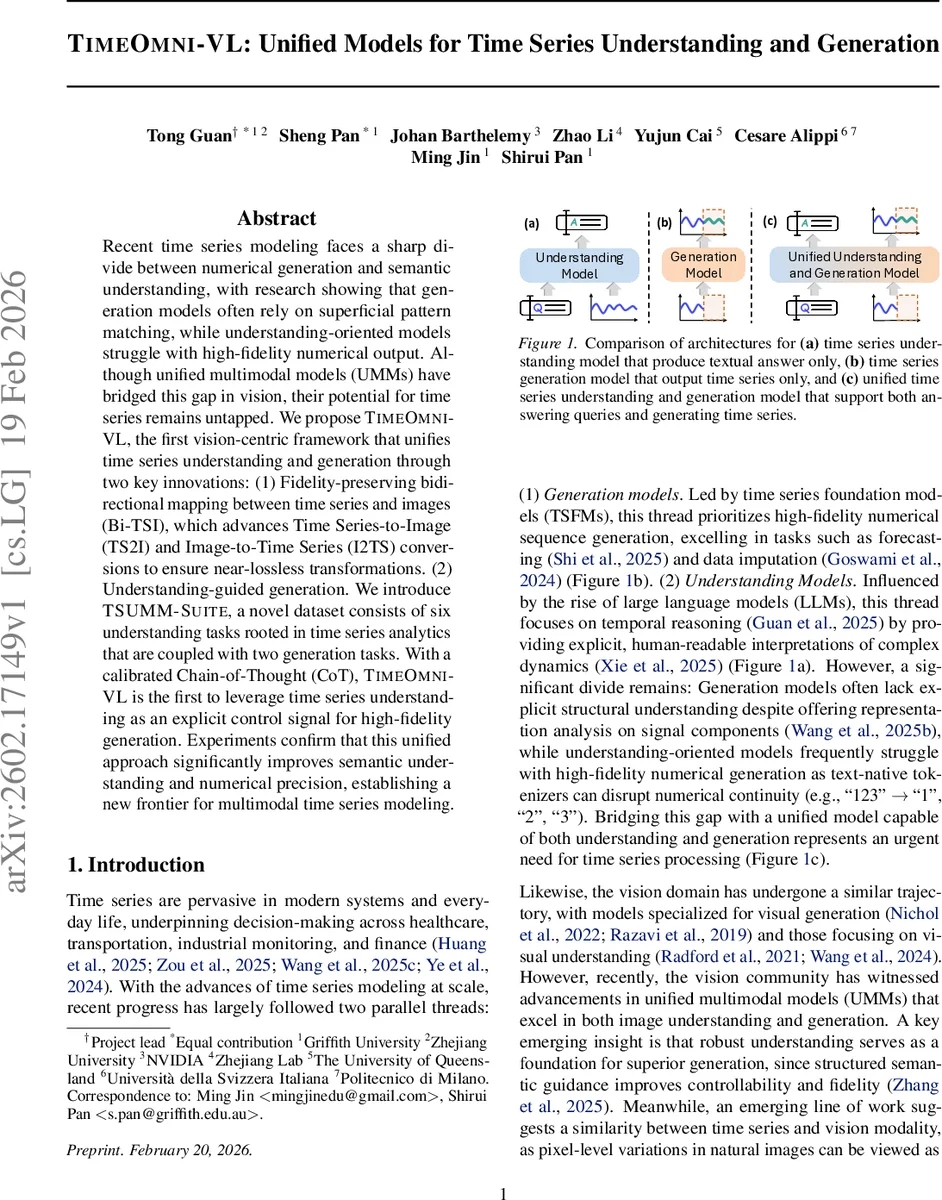

TimeOmni‑VL은 시계열 데이터를 이미지로 변환하는 고충실도 양방향 매핑(Bi‑TSI)과 이해‑기반 생성 체인을 결합해, 의미 이해와 수치 예측·보간을 동시에 수행하는 최초의 비전 중심 통합 모델이다. TS‑UMM 기반 백본에 이해‑조건(CoT)을 주입함으로써 기존 생성 모델의 표면적 패턴 매칭 한계를 극복하고, 이해 모델이 텍스트 답변을 제공하던 방식을 정량적 시계열 생성으로 확장한다.

상세 분석

본 논문은 시계열 분야에서 “생성‑이해” 양극화 문제를 비전 멀티모달 모델의 성공 사례에 빗대어 해결하고자 한다. 핵심 기여는 두 가지이다. 첫째, Robust Fidelity Normalization(RFN)과 Encoding Capacity Control을 도입한 Bi‑TSI(Bidirectional Time Series ⇔ Image) 변환 파이프라인이다. 기존 VisionTS 방식은 동적 범위가 큰 신호를 픽셀값(0‑255)으로 클리핑하면서 스파이크나 급격한 변동을 손실했지만, RFN은 신호를 로그‑스케일 혹은 히스토그램 매핑으로 정규화해 픽셀 오버플로를 방지하고, 고차원 다변량 시계열을 고정 해상도 이미지에 투사할 때 다운샘플링을 억제한다. 이로써 이미지 → 시계열(I2TS) 복원 시 평균 절대 오차(MAE)가 10‑15% 수준으로 크게 감소한다.

둘째, 이해‑가이드 생성(Understanding‑guided Generation) 메커니즘이다. 논문은 Generation CoT(Chain‑of‑Thought)를 “

데이터 측면에서는 TSUMM‑Suite라는 8‑task 벤치마크를 구축했다. 6개의 이해 과제(레이아웃 레벨·시그널 레벨)와 2개의 생성 과제(예측·보간)를 동일한 시계열 인스턴스에서 파생시켜, 모델이 이해와 생성을 상호 보완적으로 학습하도록 설계했다. 특히 이해 과제는 이미지 상의 패턴을 “시간적”으로 해석하도록 유도해, 단순 텍스처 매칭이 아닌 실제 시계열 동역학을 학습하게 만든다.

구조적으로는 Bagel이라는 경량 UMM 백본을 사용했으며, 이는 이미지 인코더‑디코더와 텍스트 토크나이저가 공유되는 통합 어텐션 아키텍처다. 이해 모델과 생성 모듈을 공동 학습시키는 다중태스크 손실(p_θ) 설계는 파라미터 효율성을 유지하면서도 두 작업 간 지식 전이를 촉진한다.

한계점으로는 이미지 변환 과정에서 발생하는 메모리 비용, 고해상도 TS‑Image 생성 시 연산량 증가, 그리고 비전 백본에 의존함으로써 시계열 고유의 도메인 특성을 완전히 반영하지 못할 가능성이 있다. 향후 연구에서는 차원 축소 없이 직접 시계열 토큰을 처리하는 하이브리드 인코더와, 멀티스텝 CoT 최적화를 통해 더 정교한 제어 신호를 설계할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기