효율적인 추론을 위한 약지도 그룹 상대 정책 최적화

초록

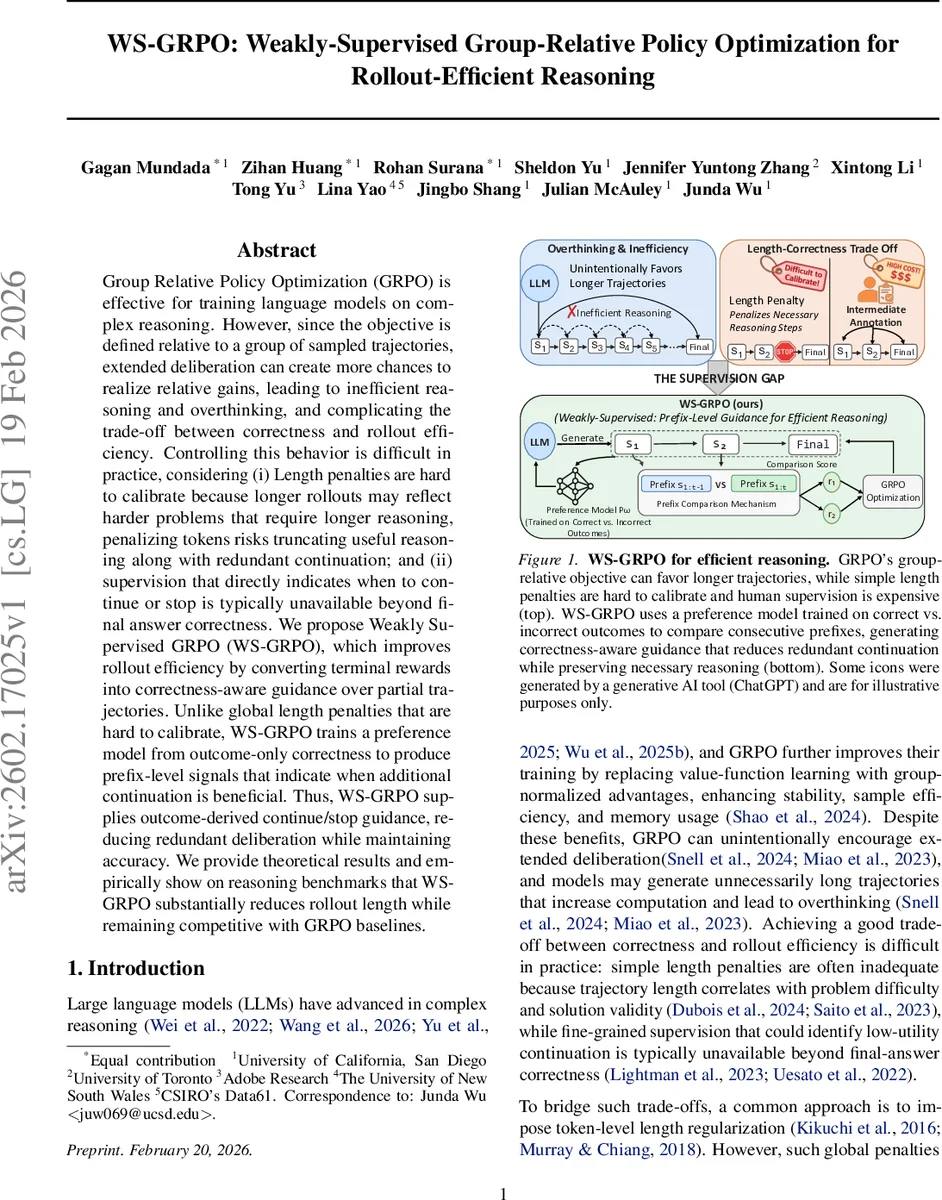

WS‑GRPO는 최종 정답의 옳고 틀림이라는 희박한 결과만을 이용해, 부분 경로에 대한 ‘계속/중단’ 신호를 생성하는 선호 모델을 학습한다. 이 신호를 GRPO의 그룹‑상대 보상에 결합함으로써 불필요한 길이 증가를 억제하고, 정확도는 유지하면서 rollout 길이를 크게 단축한다.

상세 분석

본 논문은 복합 추론 작업에서 LLM이 과도하게 긴 사고 과정을 생성하는 문제를 지적한다. 기존 GRPO는 그룹‑상대 이점을 활용해 샘플 효율성과 안정성을 높였지만, “길이가 길수록 상대 이득을 얻을 확률이 높다”는 메커니즘 때문에 모델이 불필요하게 오래 생각하도록 유도한다. 이는 계산 비용을 증가시키고, 과잉 사고(overthinking) 현상을 초래한다. 길이 페널티를 직접 적용하면 문제 난이도와 길이의 상관관계 때문에 유용한 긴 추론까지 억제할 위험이 있다. 따라서 저자는 ‘약지도(weak supervision)’라는 관점에서 최종 정답의 옳고 틀림이라는 이진 라벨만을 활용한다.

핵심 아이디어는 두 단계로 구성된다. ① 단계에서는 정답/오답 전체 경로를 쌍(pair)으로 만들어 선호 모델 Pω를 학습한다. 올바른 경로는 잘못된 경로보다 선호된다고 라벨링하고, Bradley‑Terry 형태의 교차 엔트로피 손실을 최소화한다. 이 모델은 질문과 두 전체 추론 체인을 입력으로 받아, 어느 쪽이 더 높은 품질인지 확률적으로 판단한다. ② 단계에서는 학습된 Pω를 고정하고, 각 rollout 내부의 연속적인 프리픽스(예: s₁:ₜ₋₁ vs s₁:ₜ)를 비교한다. 모델이 “다음 단계가 현재 단계보다 더 나은가”를 출력하면 이를 연속적인 ‘프리픽스 보상’ r_step으로 변환하고, 전체 프리픽스 보상의 평균을 해당 rollout의 보조 보상 R_pref에 더한다. 이렇게 얻은 프리픽스‑레벨 보상은 기존의 최종 정답 보상과 함께 GRPO의 그룹‑상대 이점 계산에 포함된다.

이 설계는 두 가지 중요한 효과를 만든다. 첫째, ‘계속’이 실제로 정답 확률을 높이는 경우에만 보상이 부여되므로, 불필요한 토큰 생성이 자연스럽게 억제된다. 둘째, 최종 정답 라벨만으로도 부분 경로의 유용성을 추정할 수 있기 때문에, 별도의 인간 주석이나 길이 페널티를 설계할 필요가 없다. 이론적으로는 선호 모델의 일관성(consistency)과 오류 제어(bound) 를 증명하고, 고확률 일반화 경계도 제공한다. 실험에서는 GSM‑8K, MathQA 등 복합 추론 벤치마크에서 평균 rollout 길이가 30 % 이상 감소했으며, 정확도는 기존 GRPO와 거의 동일하거나 소폭 향상되는 결과를 보였다.

또한, 저자는 선호 모델이 “정답‑오답” 구분을 넘어 “계속할 가치가 있는가”를 학습한다는 점을 강조한다. 이는 기존의 길이‑정규화(token‑level penalty)와는 달리, 문제 난이도에 따라 필요한 긴 추론을 유지하면서도 쉬운 문제에서는 조기에 종료하도록 유도한다. 전체 파이프라인은 기존 GRPO와 거의 동일한 구조를 유지하므로, 기존 시스템에 손쉽게 통합할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기