비용을 고려한 탐색, 사전‑행동(Calibrate‑Then‑Act) 프레임워크

초록

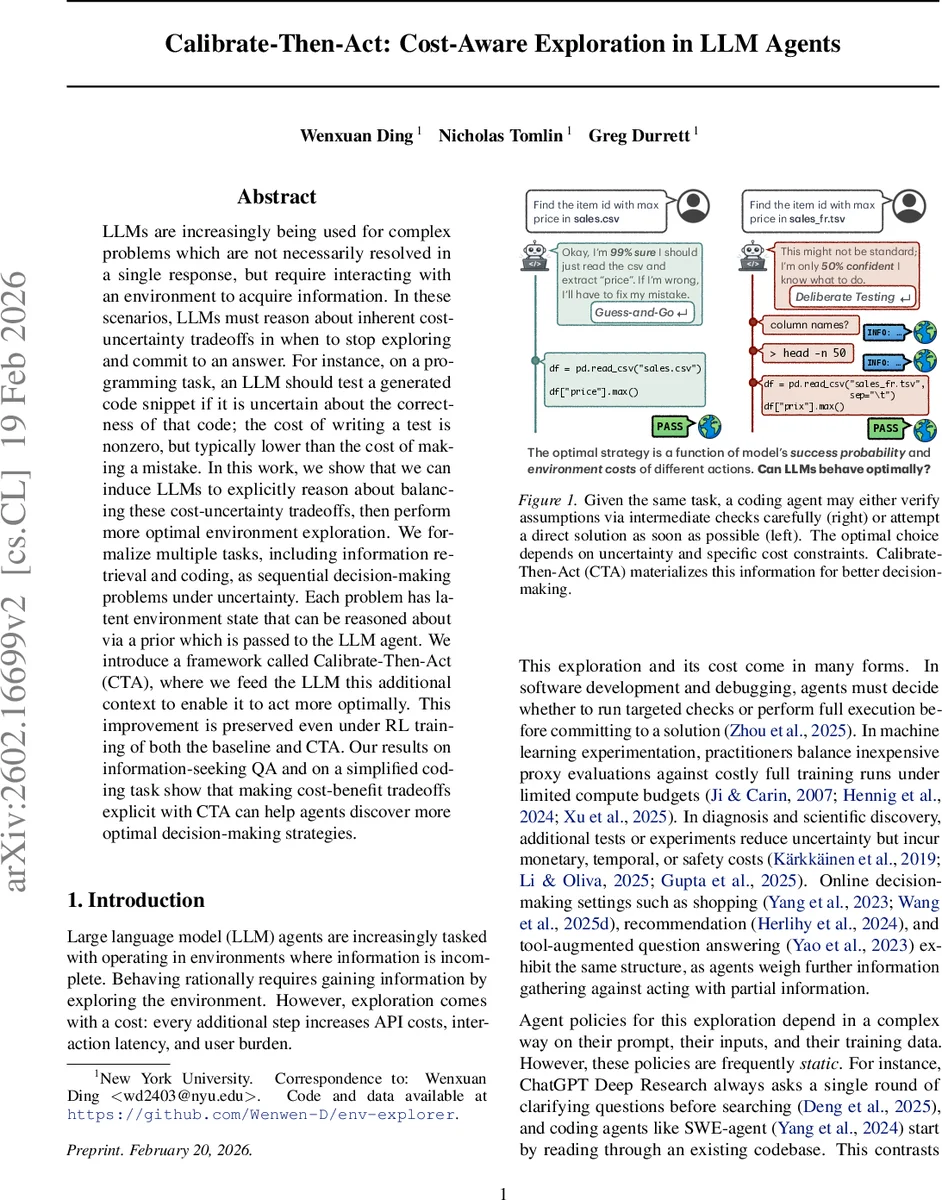

LLM 에이전트가 환경 탐색 시 비용과 불확실성을 명시적으로 고려하도록 사전 정보를 프롬프트에 제공하고, 이를 기반으로 최적에 가까운 탐색‑커밋 정책을 학습·실행한다. Pandora’s Box, 정보 검색 QA, 코드 디버깅 등 세 가지 실험에서 CTA가 기존 프롬프트 기반·RL 기반 베이스라인보다 높은 보상과 정책 일치를 달성한다.

상세 분석

이 논문은 “탐색‑커밋” 문제를 비용‑불확실성 트레이드오프가 내포된 순차 의사결정 문제로 공식화한다. 기존 LLM 에이전트는 프롬프트나 사전 학습된 정책에 의존해 탐색 행동을 선택하지만, 환경 비용(예: API 호출, 테스트 실행)과 현재 불확실성에 대한 정량적 판단을 내부적으로 수행하기 어렵다. 저자들은 이를 해결하기 위해 두 단계로 구성된 Calibrate‑Then‑Act(CTA) 프레임워크를 제안한다. 첫 단계인 “Calibrate”에서는 사전 확률 ˆp(Z|x) 혹은 사후 추정 ˆb(Z)와 같은 확률적 요약 정보를 외부 모델(또는 사전 학습된 추정기)로부터 얻어 LLM 프롬프트에 삽입한다. 두 번째 “Act” 단계에서는 이 명시적 사전 정보를 조건으로 삼아, 비용 함수 Dθ와 현재 관찰 o0:t 를 활용해 다음 행동 a_{t+1} 을 선택한다.

핵심 기술적 기여는 (1) 환경을 부분관측 마코프 결정 과정(POMDP)으로 모델링하고, 비용을 할인 계수 Dθ 로 통합한 수식적 정의; (2) 사전 정보를 명시적으로 제공함으로써 LLM 이 내부 베이지안 추론을 수행하도록 유도한다는 점이다. 실험에서는 먼저 고전적인 Pandora’s Box 문제를 변형해, 각 박스의 사전 확률과 할인 계수 γ 를 알려주면 최적 정책은 “사전 확률이 큰 순서대로 박스를 열고, posterior > γ 가 되면 즉시 커밋”이라는 것을 증명한다. Qwen‑3‑8B 모델에 CTA‑Prompt 를 적용했을 때, 최적 정책 일치율이 94 %에 달하고 평균 보상이 0.625 로, 사전 정보를 제공하지 않은 Prompted‑NT(≈0 %)와 큰 격차를 보였다.

다음으로 두 개의 실용적 시나리오를 다룬다. 첫 번째는 Knowledge‑QA 로, 질문에 대해 내부 지식만으로 답할지, 비용이 드는 외부 검색을 수행할지를 선택한다. 여기서 사전은 모델 자체의 confidence score 를 변형해 추정한다. CTA‑Prompt 를 사용하면, 모델은 높은 불확실도일 때만 검색을 호출해 전체 API 비용을 절감하면서 정확도는 유지한다. 두 번째는 코드 디버깅 작업으로, 파일 스키마와 변수 타입 등에 대한 사전 정보를 사전 학습된 메타 모델이 제공한다. 모델은 이 정보를 바탕으로 “테스트 작성 → 실행 → 커밋” 순서를 비용 효율적으로 결정한다.

RL 기반 베이스라인과 비교했을 때, CTA‑RL(즉, 사전 정보를 제공한 상태에서 추가 강화학습) 역시 일관된 성능 향상을 보였으며, 단순 RL 은 사전 정보를 내부화하지 못해 비용‑효율적인 탐색 전략을 학습하지 못한다는 한계를 드러냈다. 전체적으로 논문은 LLM 에이전트가 비용‑불확실성 트레이드오프를 명시적 확률 사전과 결합해 더 합리적인 탐색 정책을 구현할 수 있음을 실증한다.

이 접근법은 (1) 사전 추정기의 품질에 크게 의존하지만, 기존 데이터에서 쉽게 학습 가능하고 (2) 프롬프트 수준에서 적용 가능하므로 기존 파이프라인에 최소한의 수정만으로 도입할 수 있다. 또한 비용 함수 Dθ 를 다양한 비즈니스 메트릭(시간, 금전, 사용자 피로도)으로 정의하면, 실제 서비스 환경에서도 손쉽게 맞춤형 탐색‑커밋 정책을 설계할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기