멀티모달 대형 언어 모델이 시각장애인의 시각 정보 접근을 지원하는 방법: 일기 연구

초록

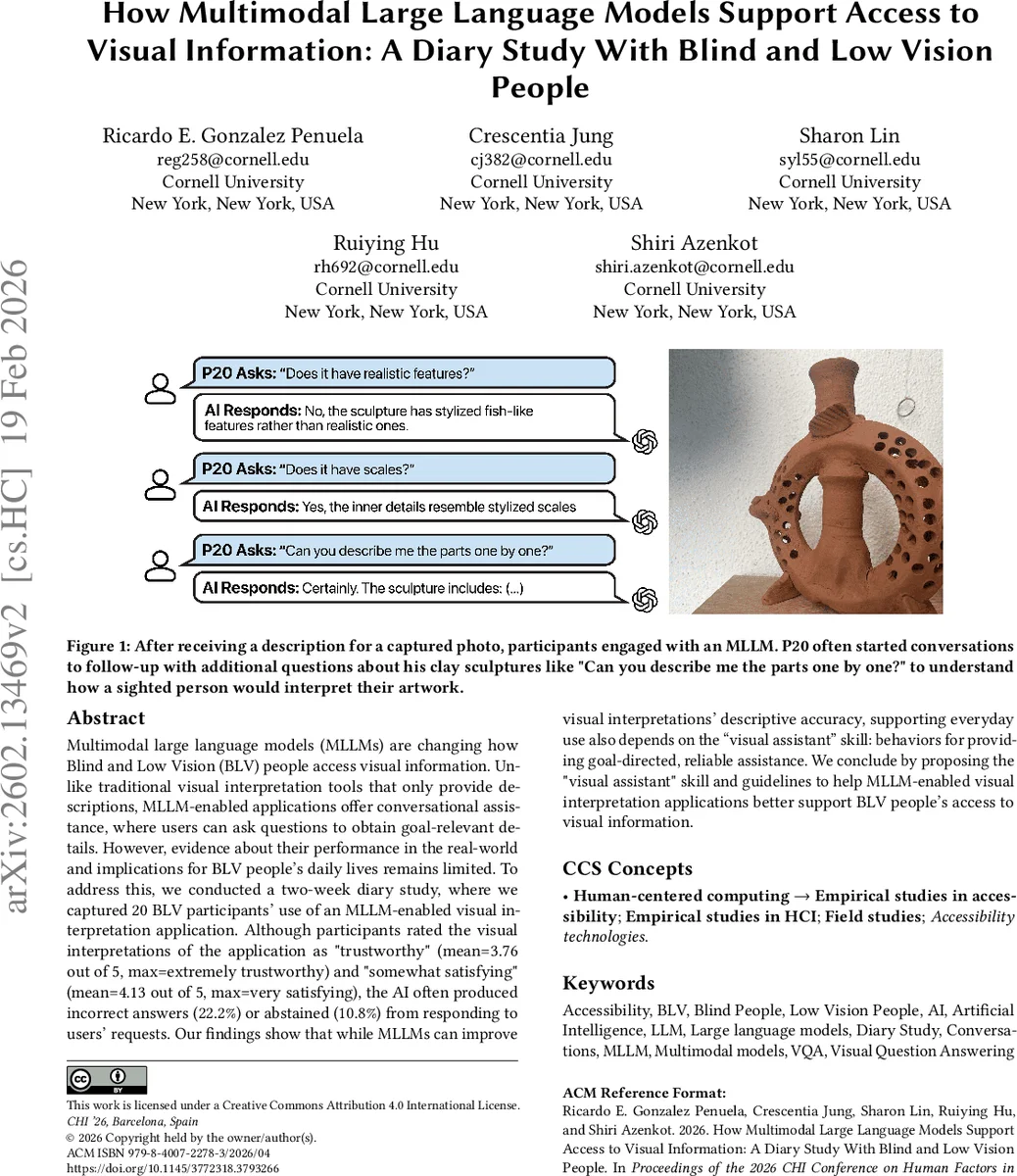

본 연구는 20명의 시각장애·저시력(Blind and Low Vision, BLV) 사용자를 대상으로 2주간 일기 연구를 진행하여, 멀티모달 대형 언어 모델(MLLM) 기반 시각 해석 애플리케이션의 실제 사용 현황을 조사하였다. 참가자들은 AI가 제공한 이미지 설명을 평균 3.76/5(신뢰도)와 4.13/5(만족도)로 평가했지만, 22.2%의 답변이 오류였고 10.8%는 응답을 회피했다. 연구는 MLLM이 기술적 정확도는 높지만, 일상적인 목표 지향적 지원을 위해서는 “시각 어시스턴트” 역량과 9가지 행동 지침이 필요함을 제시한다.

상세 분석

이 논문은 기존의 정적 이미지 캡션 모델이 제공하던 단순 설명을 넘어, 사용자가 대화형으로 세부 정보를 탐색할 수 있는 멀티모달 대형 언어 모델(MLLM)의 실제 활용 가능성을 검증한다. 연구 설계는 두 단계로 이루어졌다. 첫 번째는 GPT‑4o 기반 시각 해석 애플리케이션을 개발하고, 이를 20명의 BLV 참가자에게 2주간 자유롭게 사용하도록 배포하였다. 두 번째는 매 사용 후 설문, 사진, AI가 생성한 설명, 그리고 사용자와 AI 간 대화 로그를 포함한 일기 항목을 수집해 총 551개의 데이터를 확보했다.

데이터 분석에서는 각 일기 항목에 대해 사용 목적(식별, 읽기, 공간 안내 등), 사용 장소(실내, 야외, 공공 등), AI 설명의 정확도(3점 척도), 후속 질문 유형, 그리고 AI 응답의 정밀도(정답, 오류, 회피) 등을 코딩했다. 결과는 다음과 같다. 1) 이미지 설명 자체는 평균 2.9/3의 높은 정확도를 보였으며, 사용자는 이를 ‘신뢰할 수 있다’고 평가했다. 2) 그러나 후속 질문에 대한 응답에서는 22.2%가 명백한 오류(예: 약물 용량 오기입)였고, 10.8%는 민감 정보에 대해 회피하거나 불일치하는 행동을 보였다. 특히 텍스트·그래픽 해석에서 34.6%가 환각(hallucination) 현상을 보였으며, 이는 사용자가 눈에 보이지 않는 정보를 의존하게 만들 위험이 있다. 3) 사용자는 고위험 상황(약물 확인, 알레르기 정보 등)에서 대화를 적극 활용했으며, 사적인 장소에서는 프라이버시 우려로 대화 시작을 꺼렸다.

이러한 발견을 바탕으로 저자들은 “시각 어시스턴트” 스킬을 정의하고, MLLM이 따라야 할 9가지 행동 지침(예: 정확성 우선, 불확실 시 명시, 민감 정보 보호, 사용자 컨텍스트 반영 등)을 제시한다. 또한 모델 훈련 단계에서 BLV 사용자의 실제 대화 데이터를 활용한 ‘골든 스탠다드’ 예시를 포함하고, 시스템 프롬프트에 행동 지침을 명시하며, 사용자 맞춤형 설정을 제공하는 세 가지 개입 시점을 제안한다.

한계점으로는 연구 기간이 연말 휴가 시즌에 겹쳐 비정형 사용 패턴이 포함될 가능성, 참가자 대부분이 기존 시각 해석 도구에 익숙한 ‘전문가’ 사용자였으며 초보자 그룹이 배제된 점, 그리고 데이터 기록에 대한 감시 의식이 실제 사용 행동에 영향을 미쳤을 가능성을 언급한다. 전반적으로 이 논문은 MLLM이 BLV 사용자의 일상적 시각 정보 접근에 큰 잠재력을 가지고 있지만, 신뢰성·안전성을 보장하기 위한 설계·훈련·사용자 제어 메커니즘이 필수적임을 실증적으로 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기