동영상 얼굴 교환을 위한 학습 없는 확산 기반 VFace

초록

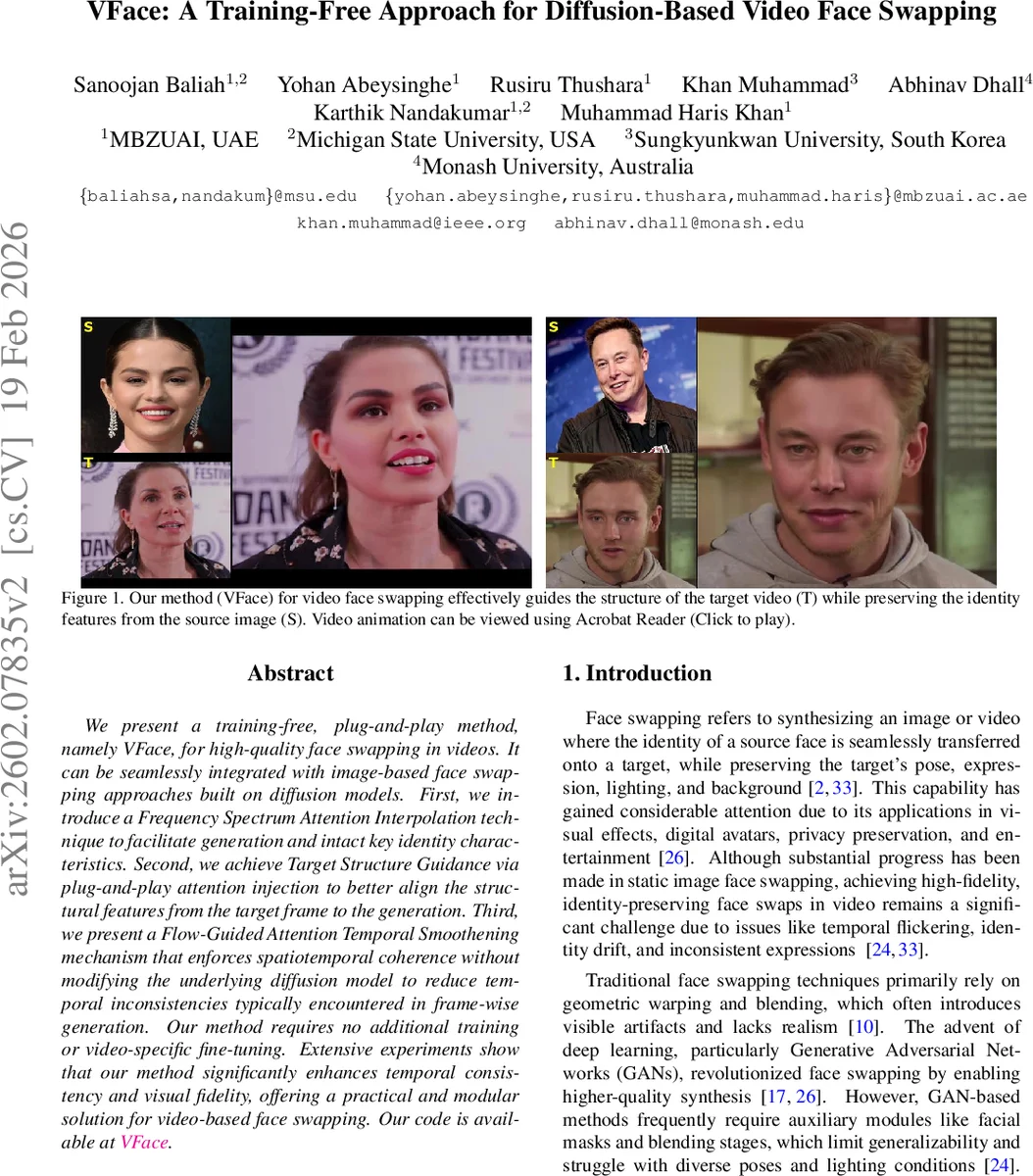

VFace는 기존 이미지 기반 확산 모델을 그대로 활용하면서, 플러그‑인 어텐션 주입, 주파수 스펙트럼 어텐션 보간, 광류 기반 어텐션 시간 평활화라는 세 가지 모듈을 추가해 영상 전체에 걸친 구조 유지와 신원 보존, 그리고 시간적 일관성을 동시에 달성하는 학습‑프리 비디오 얼굴 교환 방법이다.

상세 분석

본 논문은 확산 모델의 강력한 이미지 생성 능력을 영상 수준으로 확장하기 위해, 모델 자체를 재학습하거나 비디오 전용 파라미터를 추가하지 않는 ‘플러그‑인’ 설계 철학을 채택하였다. 첫 번째 핵심인 Target Structure Guidance(TSG)는 DDIM 역전 과정을 통해 목표 영상의 노이즈 표현을 얻고, 재구성 파이프라인에서 추출한 쿼리·키 어텐션 맵을 생성 파이프라인에 직접 삽입한다. 이 과정은 목표 프레임의 포즈와 구조 정보를 그대로 전달하면서, 소스 이미지의 신원 특성만을 별도로 주입할 수 있게 해준다. 두 번째 모듈인 Frequency Spectrum Attention Interpolation(FSAI)은 어텐션 텐서를 주파수 영역으로 변환한 뒤, 저주파(신원·전반적 외형)와 고주파(세부 구조·텍스처)를 각각 소스와 타깃에서 취합한다. ρ 비율을 조절해 저주파는 소스, 고주파는 타깃의 정보를 혼합함으로써, 기존 어텐션 교체가 초래할 수 있는 신원 약화를 방지하고, 동시에 목표 영상의 미세 움직임을 보존한다. 세 번째인 Flow‑guided Attention Temporal Smoothening(FATS)은 광류를 이용해 인접 프레임 간 어텐션 맵을 워핑하고, 이를 시간 축에 걸쳐 평균화한다. 이렇게 하면 확산 과정의 확률적 변동성으로 인한 프레임 간 깜박임을 크게 감소시켜, 장시간 영상에서도 일관된 얼굴 움직임을 유지한다. 전체 파이프라인은 사전 학습된 이미지 기반 얼굴 교환 모델(예: REFace)을 그대로 사용하며, 추가 학습 없이도 영상 전체에 적용 가능하도록 설계되었다. 실험에서는 정량적 지표(ID 보존, LPIPS, FVD 등)와 정성적 시각 평가 모두에서 기존 정적 이미지 교환 방법을 프레임별 적용한 경우보다 현저히 높은 성능을 보였으며, 특히 빠른 움직임이나 조명 변화가 큰 장면에서도 시간적 일관성을 유지한다는 점이 강조된다. 이러한 설계는 모델 재학습 비용을 크게 절감하고, 다양한 기존 이미지 기반 교환 파이프라인에 손쉽게 모듈을 삽입할 수 있는 높은 확장성을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기