가벼운 트랜스포머로 가짜 뉴스와 풍자 구분하기

초록

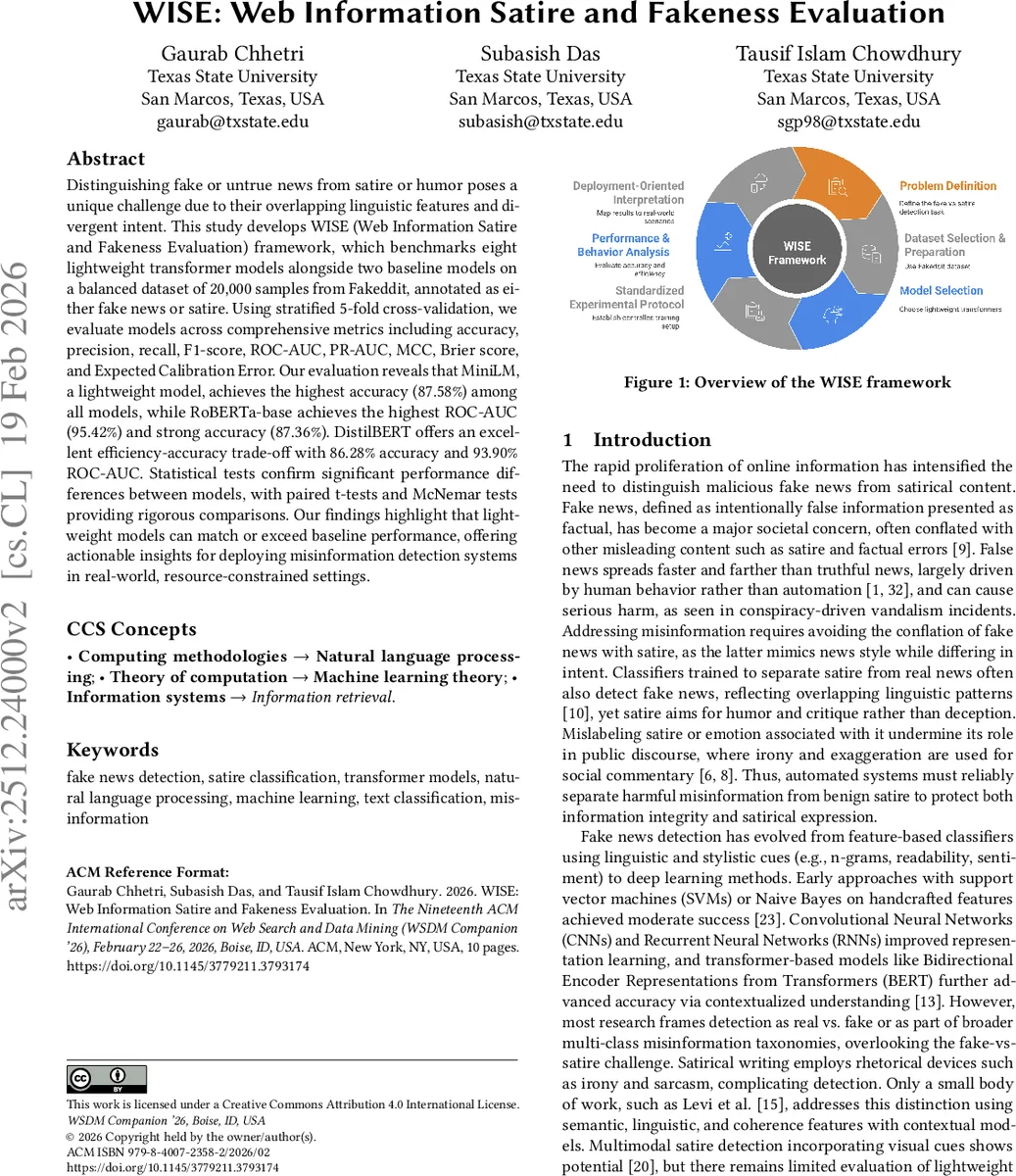

WISE 프레임워크는 20,000개의 균형 잡힌 Fakeddit 샘플을 이용해 가짜 뉴스와 풍자를 구분한다. 8개의 경량 트랜스포머와 2개의 대형 베이스라인 모델을 5‑fold 교차 검증으로 평가했으며, MiniLM이 87.58% 정확도로 최고 성능을 보였다. RoBERTa‑base은 95.42% ROC‑AUC를 기록했고, DistilBERT은 효율‑정확도 균형이 뛰어났다. 통계적 유의성 검증을 통해 모델 간 차이를 확인하였다.

상세 분석

본 연구는 가짜 뉴스와 풍자를 구분하는 이진 분류 문제에 초점을 맞추어, 기존 연구가 주로 실제와 가짜를 구분하거나 풍자 자체를 별도 과제로 다루던 것과 달리 두 클래스를 직접 비교한다는 점에서 차별성을 가진다. 데이터는 Reddit 기반 대규모 멀티모달 데이터셋인 Fakeddit에서 제목 길이가 50자 이상인 텍스트만 추출해, ‘Satire/Parody’ 라벨 10,000개와 ‘Misleading Content’·‘Manipulated Content’ 라벨을 각각 5,000개씩 합친 ‘Fake News’ 10,000개를 선정해 완전한 클래스 균형을 이루었다. 이는 클래스 불균형에 의한 편향을 최소화하고, 모델 성능을 순수하게 비교할 수 있게 한다.

모델 구성은 경량 트랜스포머 8종(TinyBERT, TinyBERT‑4L, ALBERT‑base‑v2, MiniBERT, MiniLM, Small‑BERT‑L2, DistilBERT, ELECTRA‑small)과 대형 베이스라인(BERT‑base, RoBERTa‑base)으로 이루어졌다. 각 모델은 Hugging Face에서 공개된 체크포인트를 그대로 사용했으며, 파라미터 수는 4 M에서 125 M까지 다양하다. 학습은 5‑fold 층화 교차 검증으로 진행했으며, 각 폴드마다 동일한 학습‑검증 분할을 유지해 결과의 재현성을 확보했다.

평가 지표는 정확도, 정밀도, 재현율, Macro‑F1, ROC‑AUC, PR‑AUC, Matthews Correlation Coefficient, Brier score, Expected Calibration Error 등 10가지로 확장하였다. 이는 단순 정확도 외에도 모델의 신뢰도와 불균형에 대한 강건성을 종합적으로 판단할 수 있게 한다.

실험 결과, MiniLM이 87.58% 정확도로 최고 정확도를 기록했으며, RoBERTa‑base은 95.42% ROC‑AUC와 87.36% 정확도로 전반적인 판별 능력이 가장 우수했다. DistilBERT은 86.28% 정확도와 93.90% ROC‑AUC를 보이며, 파라미터와 추론 속도 면에서 효율적인 선택지임을 확인했다. 경량 모델 중 TinyBERT‑4L와 ALBERT‑base‑v2도 84~86% 수준의 정확도를 유지했으며, 특히 ALBERT는 파라미터 공유 덕분에 메모리 사용량이 크게 감소했다.

통계적 검증으로는 모델 간 정확도 차이에 대해 paired t‑test를 수행했으며, p < 0.01 수준에서 대부분의 경량 모델과 베이스라인 간 차이가 유의함을 보였다. 또한, McNemar 테스트를 통해 오류 패턴의 차이를 분석했으며, MiniLM과 RoBERTa‑base 사이에서는 오류 분포가 유사해 실제 적용 시 교체가 가능함을 시사한다. DeLong 테스트를 이용한 ROC‑AUC 비교에서도 RoBERTa‑base이 유의하게 높은 곡선 아래 면적을 보였다.

전반적으로 경량 트랜스포머가 대형 모델에 비해 약간의 정확도 손실만을 보이며, 추론 시간과 메모리 요구량에서 현저히 우수함을 확인했다. 이는 실시간 모니터링이나 모바일 환경 등 자원 제한이 있는 실제 서비스에 직접 적용 가능함을 의미한다.

댓글 및 학술 토론

Loading comments...

의견 남기기