상대 음성 인상 추정: 쌍별 감각 차이 예측을 위한 새로운 프레임워크

초록

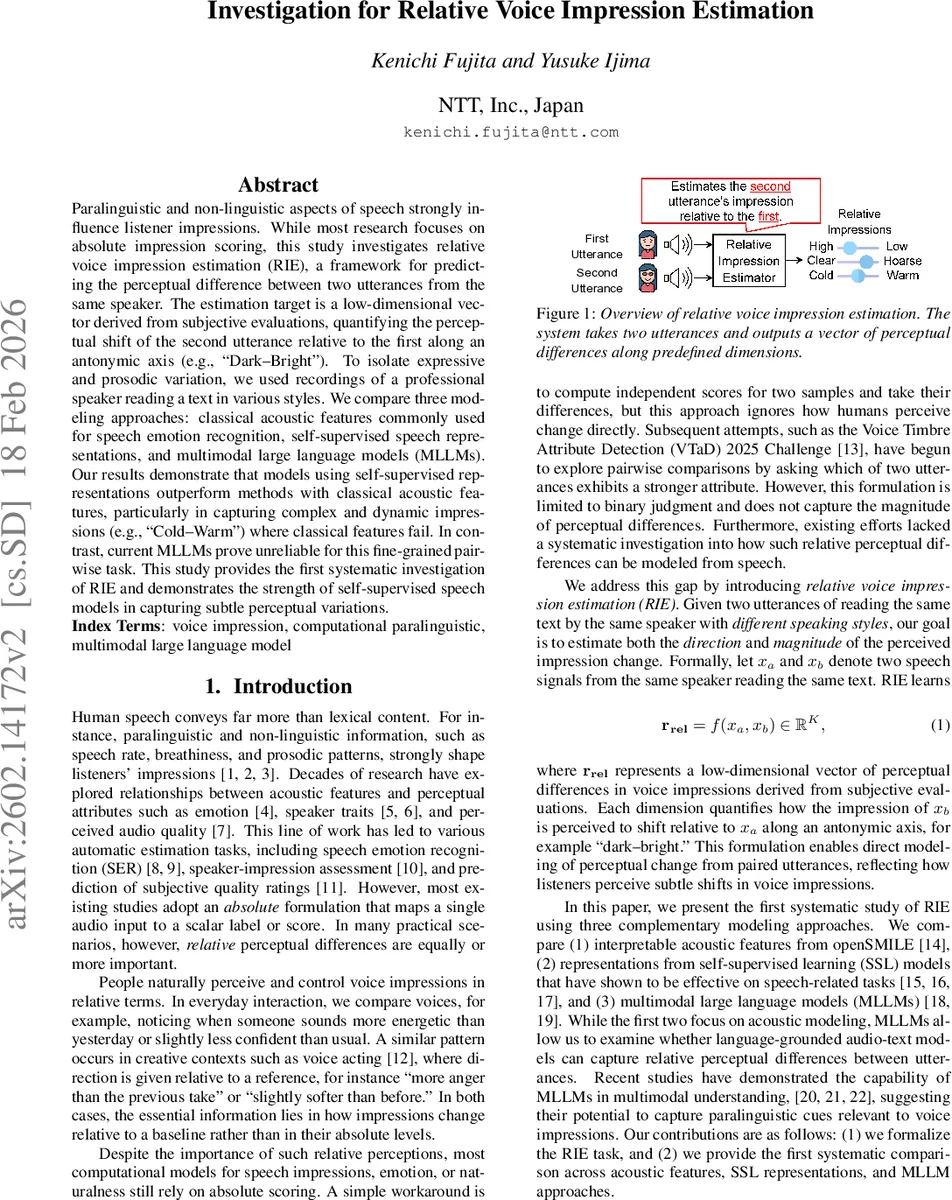

본 연구는 동일 화자의 두 발화를 입력으로 받아, 청취자가 느끼는 인상 변화를 9가지 반대어 축으로 정량화한 저차원 벡터를 예측하는 상대 음성 인상 추정(RIE) 과제를 정의한다. 클래식 음향 특징, 자기지도 학습(SSL) 기반 음성 표현, 그리고 멀티모달 대형 언어 모델(MLLM) 세 가지 접근을 비교한 결과, SSL 기반 모델이 가장 높은 피어슨 상관과 일치도(CCC)를 기록했으며, MLLM은 현재 수준에서는 신뢰할 수 없는 것으로 나타났다.

상세 분석

본 논문은 음성 인상 평가에서 절대 점수 대신 두 발화 간의 상대적 변화를 직접 모델링하는 새로운 과제인 Relative Voice Impression Estimation(RIE)을 제안한다. 데이터는 일본어 전문 성우 1명의 52가지 말하기 스타일을 동일 텍스트에 대해 녹음한 내부 데이터셋으로, 총 814개의 발화 쌍(3,372초)을 포함한다. 각 쌍은 9개의 반대어 축(예: Dark–Bright, Cold–Warm 등)으로 구성된 인상 차이 벡터를 7점 Likert 척도로 군중소싱을 통해 라벨링하였다. 라벨링은 최소 10명의 평가자를 확보하고, AB와 BA 순서를 모두 제시해 순서 효과를 최소화했다.

모델링 측면에서는 세 가지 접근을 비교한다. 첫 번째는 openSMILE의 eGeMAPSv02 설정을 이용한 전통적인 음향 특징을 추출하고, 차이 벡터 ϕΔ=ϕ(x_b)−ϕ(x_a)를 회귀 모델(Ridge, PLS2, Random Forest, GBDT, SVR) 및 3계층 피드포워드 신경망에 입력한다. 특징 선택은 각 차원별 피어슨 상관을 기준으로 상위 8개를 선정했으며, 피치(F0), 저차 MFCC, Hammarberg index, 알파 비율 등이 주요 변수로 나타났다.

두 번째는 사전학습된 HuBERT(768‑dim) 모델에서 프레임 수준 임베딩을 추출하고, 가중합, BiLSTM, 어텐션 풀링을 통해 128‑dim 발화 임베딩을 만든 뒤, 두 임베딩을 연결(concatenation)하고 3‑layer MLP로 차이 벡터를 예측한다. 이 SSL 기반 모델은 전체 파라미터를 미세조정(fine‑tune)했으며, 평균 제곱 오차(MSE) 손실과 AdamW 옵티마이저(lr=0.002)로 학습하였다.

세 번째는 멀티모달 대형 언어 모델(MLLM)인 GPT‑5 Thinking 기반 ChatGPT와 Gemini 2.5 Pro를 활용한 제로샷 평가이다. 두 모델 모두 오디오 입력을 직접 받아들일 수 있도록 프롬프트를 설계했으며, 일본어로 9개 축에 대한 수치와 간단한 텍스트 설명을 반환하도록 했다. 그러나 사전 학습된 텍스트‑오디오 정렬이 상대 인상 차이와는 직접적인 연관성이 부족해, 피어슨 상관과 CCC 모두 낮은 수준에 머물렀다.

성능 평가는 피어슨 상관과 Concordance Correlation Coefficient(CCC) 두 지표를 사용했다. 전통적인 음향 특징 기반 회귀 모델은 평균 피어슨 0.440.60, CCC 0.440.82 정도를 기록했으며, 특히 Dark–Bright 축에서 가장 높은 0.84의 CCC를 보였다. 반면 SSL 기반 모델은 전반적으로 0.600.72(피어슨)와 0.660.82(CCC)의 우수한 성능을 보였으며, 특히 Calm–Restless와 Powerful–Weak 같은 복합적인 감정 축에서도 높은 일치도를 달성했다. MLLM은 GPT‑5와 Gemini 모두 피어슨 0.100.60, CCC 0.150.70 수준으로, 특히 Powerful–Weak 축에서는 음수 상관을 보여 신뢰성이 떨어졌다.

결과를 종합하면, 동일 화자 내에서 텍스트가 고정된 상황에서도 음성 스타일에 따른 미세한 인상 변화를 포착하려면, 고차원 프리트레인된 음성 표현을 활용한 SSL 모델이 가장 효과적임을 확인할 수 있다. 전통적인 음향 특징도 일부 축에서는 경쟁력을 보이지만, 복합적이고 동적인 인상(예: Cold–Warm)에서는 한계가 명확하다. 현재 MLLM은 제로샷 상황에서 음성-텍스트 정렬이 충분히 정교하지 않아, 세밀한 상대 인상 추정에는 아직 부적합한 것으로 판단된다. 향후 연구는 다중 화자·다중 언어 데이터 확장, 더 큰 규모의 라벨링, 그리고 MLLM의 도메인 특화 파인튜닝을 통해 성능을 향상시킬 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기