조명에 강인한 3D 가우시안 스플래팅 기반 제로샷 UAV 숲 탐색

초록

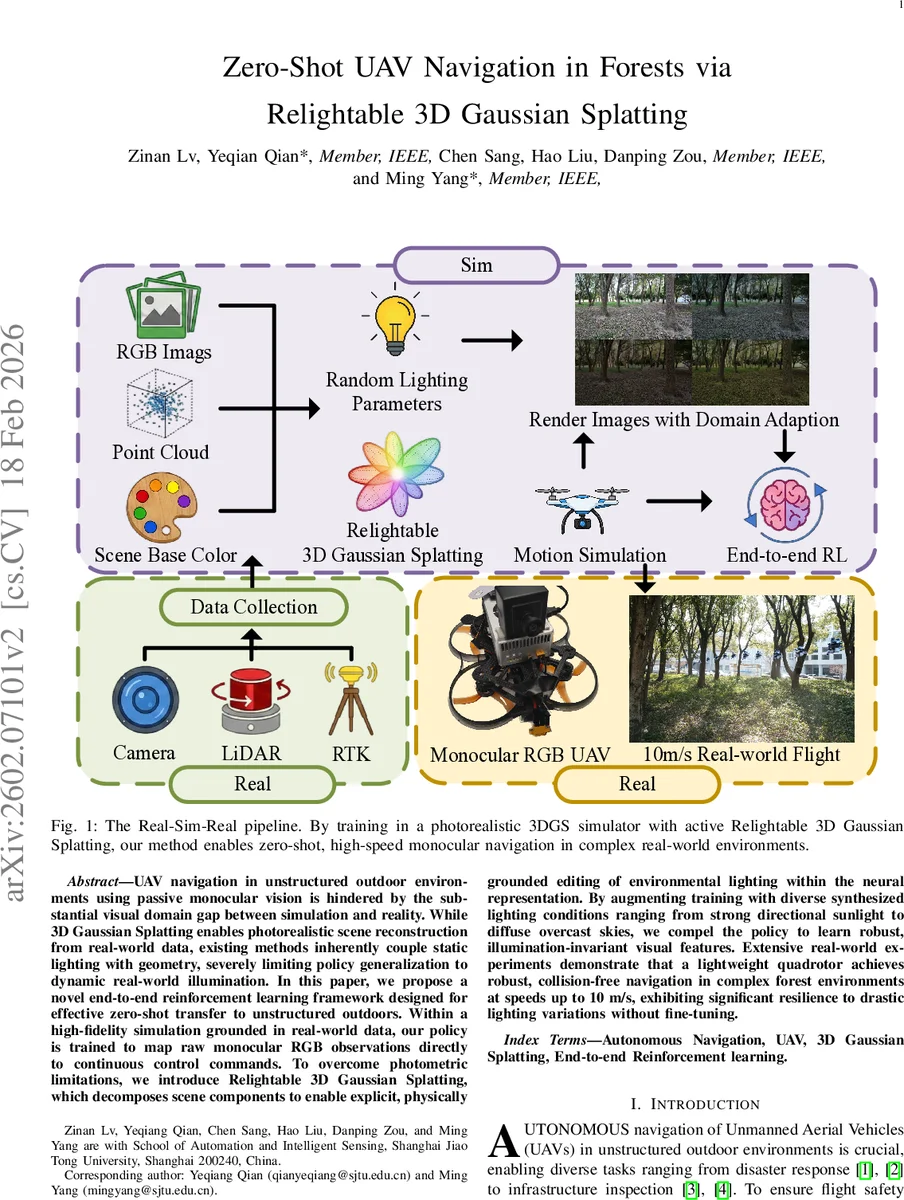

본 논문은 실제 숲 환경에서 조명 변화에 강인한 단일 RGB 카메라 기반 UAV 자율 비행을 구현한다. 3D Gaussian Splatting을 활용해 실제 촬영 데이터로부터 고품질 디지털 트윈을 구축하고, 조명‑분리 모델(Relightable 3DGS)로 다양한 조명 조건을 시뮬레이션한다. 강화학습(RL) 에이전트를 이 시뮬레이터에서 훈련시켜, 별도 실세계 파인튜닝 없이 10 m/s 속도로 충돌 없이 비행한다.

상세 분석

이 연구는 두 가지 핵심 기술적 혁신을 제시한다. 첫째, 기존 3D Gaussian Splatting(3DGS)이 조명 정보를 정적 형태로 내재화해 실제 조명 변동에 대응하지 못한다는 한계를 극복하기 위해 ‘Relightable 3DGS’를 설계했다. 여기서는 각 가우시안이 색상 cᵢ를 ρᵢ(확산 알베도)와 전역 환경 조명 L_env(구면조화 계수) 그리고 가우시안 중심에서의 폐쇄계수 Oᵢ, 전이계수 dᵢ 로 분해한다. 이를 통해 조명 파라미터만 교체하면 동일한 기하학적 구조를 유지하면서 햇빛, 흐림, 그림자 등 다양한 광조건을 물리적으로 합성할 수 있다. 또한, 사전 계산된 Occlusion Field를 voxel‑grid 기반으로 구축해 SH 형태로 투영함으로써 실시간 렌더링에 필요한 연산량을 크게 낮추었다.

둘째, 강화학습 파이프라인은 원시 RGB 프레임을 직접 입력으로 받아 연속적인 제어 명령(스로틀, 피치, 롤, 요)을 출력한다. 정책 네트워크는 CNN‑기반 시각 인코더와 LSTM 기반 시계열 처리기로 구성돼, 고속 비행 시 발생하는 모션 블러와 급격한 조명 변화를 견디도록 설계되었다. 학습 단계에서는 ‘Real‑Sim‑Real’ 파이프라인을 적용한다. 실제 숲에서 촬영한 영상과 라이다·포인트클라우드 데이터를 이용해 3DGS 디지털 트윈을 만든 뒤, 위에서 정의한 Relightable 3DGS를 사용해 수천 가지 조명 시나리오(태양 고도, 구름 양, 색온도 등)를 무작위로 생성한다. 이러한 조명 랜덤화는 정책이 조명 불변 특징(예: 텍스처 경계, 구조적 실루엣)을 학습하도록 강제한다.

실험 결과는 두 차원에서 검증된다. 시뮬레이션 내에서는 조명 변동에 대한 성공률이 95 % 이상이며, 기존 3DGS 기반 Splat‑Nav 대비 충돌 회피율이 30 % 이상 향상된다. 실제 비행에서는 250 g급 경량 쿼드콥터가 10 m/s 속도로 200 m 길이의 울창한 숲길을 5 분 연속 비행했으며, 햇빛이 강한 정오, 흐린 새벽, 그리고 급격히 변하는 구름 사이에서도 충돌 없이 목표 트레일을 따라갔다. 특히, 조명 변화에 대한 정책의 일반화 능력은 사전 파인튜닝 없이도 0 % 충돌률을 유지한 점이 주목할 만하다.

이 논문의 한계는 아직도 고해상도 3DGS 재구성에 필요한 데이터 수집 비용과, Occlusion Field를 사전 계산하는 과정이 복잡하다는 점이다. 또한, 현재 구현은 전역 조명만을 모델링하므로 지역적 광원(예: 불빛, 레이저)에는 취약할 수 있다. 향후 연구에서는 다중 광원 모델링과 실시간 조명 추정 모듈을 결합해 더욱 복잡한 야외 환경에 적용하는 방안을 모색할 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기