초보자를 위한 언어학습 LLM 난이도 제어

초록

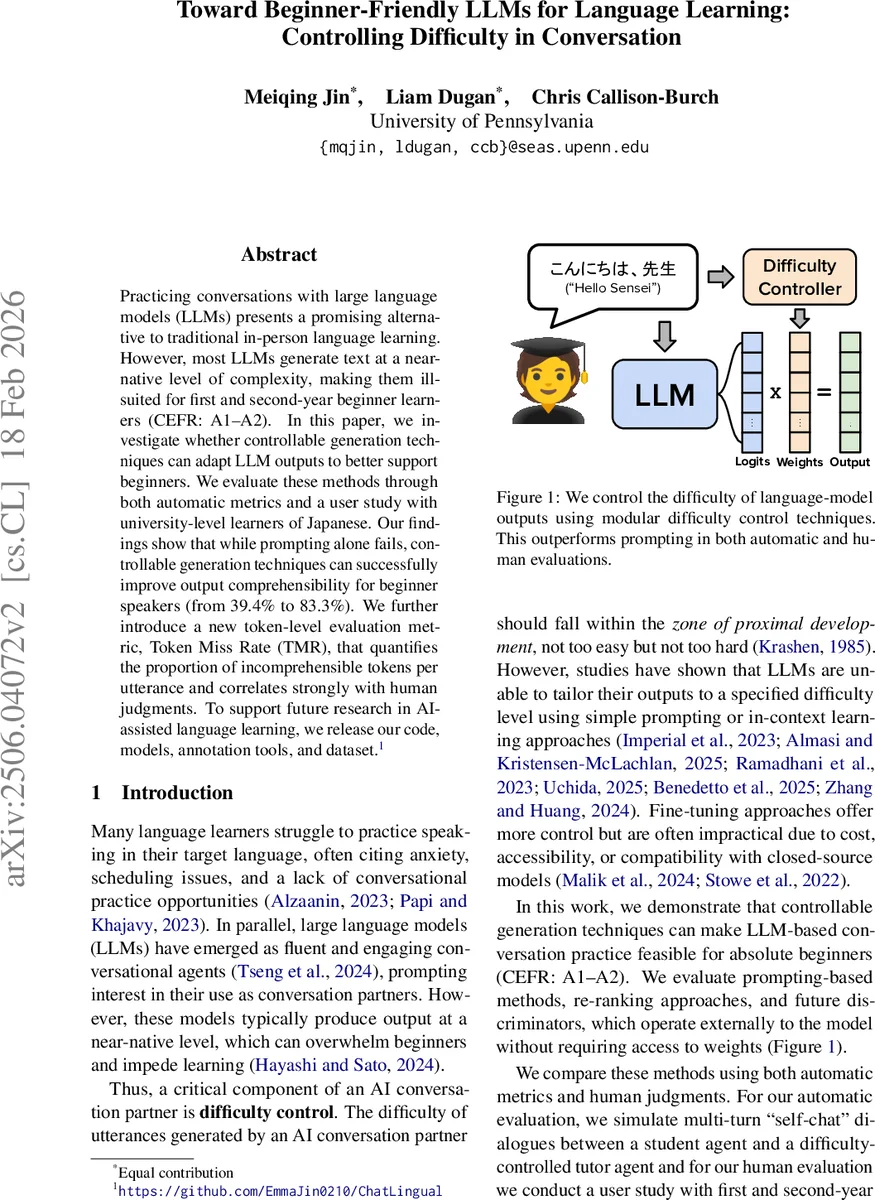

본 논문은 초보 학습자(A1‑A2 수준)를 위한 대화형 LLM의 난이도 제어 방법을 탐구한다. 프롬프트만으로는 난이도 조절에 한계가 있음을 확인하고, 재랭킹, 과다생성, 그리고 FUDGE 기반 미래 판별기와 같은 모듈식 제어 기법을 적용한다. 자동 평가와 일본어 초급 학습자를 대상으로 한 사용자 연구 결과, FUDGE가 토큰 미스 비율(TMR)과 ControlError를 크게 낮추면서도 유창성 지표를 유지해 가장 효과적인 방법임을 입증한다. 또한 토큰 수준의 이해도 측정 지표인 TMR을 새롭게 제안하고, 코드와 데이터셋을 공개한다.

상세 분석

이 연구는 기존 LLM이 초보 학습자에게 제공하는 출력이 과도하게 복잡해 학습 효율을 저해한다는 문제의식에서 출발한다. 저자는 CEFR A1‑A2 수준에 해당하는 일본어 학습자를 대상으로, 튜터 역할을 하는 LLM이 학생의 이해 가능 수준을 지속적으로 유지하도록 하는 ‘대화 난이도 제어’라는 새로운 작업을 정의한다. 난이도 레벨은 JLPT N5‑N1을 CEFR과 매핑해 구체화했으며, 각 레벨별 어휘·문법 리스트를 사전 구축하였다.

제어 방법은 크게 세 가지로 나뉜다. 첫째, 단순 프롬프트와 상세 프롬프트를 이용한 사전 지시 방식이다. 상세 프롬프트는 레벨 설명, 예시 대화, 100개의 표현 목록을 포함해 모델에 더 풍부한 컨텍스트를 제공한다. 둘째, ‘과다생성(over‑generate)’ 방식으로, 모델이 다수의 후보 응답을 생성한 뒤 사전 훈련된 난이도 분류기(TOHOKU‑BER‑T)를 이용해 각 후보의 토큰을 JLPT 레벨에 매핑하고, 추정 TMR이 가장 낮은 후보를 선택한다. 이때 전역·레벨별 빈도 필터를 적용해 희귀 토큰을 억제한다. 셋째, FUDGE(Future Discriminators for Generation) 기반 제어이다. 여기서는 부분적으로 생성된 시퀀스에 대해 난이도 분류기(ModernBERT 기반)를 적용해 미래 속성을 예측하고, 베이스 모델 로그와 선형 보간(λ 파라미터)하여 로그를 조정한다. λ 값이 클수록 난이도 제어 강도가 높아진다.

평가 지표는 두 축으로 구성된다. 난이도 측면에서는 토큰 미스 비율(TMR)과 ControlError를 사용한다. TMR은 출력 토큰 중 목표 레벨을 초과하는 토큰 비율을 직접 계산해 인간의 이해도와 높은 상관관계를 보인다. ControlError는 분류기의 예측 레벨과 목표 레벨 간 제곱 차이를 측정한다. 유창성 평가는 퍼플렉시티(PPL), 평균 토큰 길이, 3‑gram 다양성(div@3) 및 JReadability 점수를 활용한다.

자동 ‘셀프‑챗’ 실험에서는 학생 LLM과 튜터 LLM이 75개의 다중 턴 대화를 시뮬레이션했다. 결과는 표 3에 요약되는데, FUDGE(λ=0.9)가 Qwen2.5‑72B‑Instruct 기반에서 TMR 11.9%와 ControlError 1.78을 기록해 가장 낮은 난이도 위반률을 보였다. 동시에 PPL은 74.27로 크게 악화되지 않았으며, div@3와 JReadability도 경쟁 모델과 비슷하거나 약간 우수했다. 과다생성 방식은 TMR이 13‑15% 수준으로 FUDGE에 비해 열위였으며, 프롬프트 기반 방법은 30% 이상으로 난이도 제어에 실패했다.

인간 사용자 연구에서는 일본어 초급 학습자 30명을 대상으로 5가지 제어 방법을 비교했다. 주관적 이해도 평점은 FUDGE가 4.2점(5점 만점)으로 가장 높았으며, 프롬프트만 사용한 경우 2.1점에 그쳤다. 특히 ‘정렬 드리프트’ 현상이 프롬프트 방식에서 두드러졌는데, 대화가 진행될수록 모델이 점차 고난이도 어휘와 복잡한 문법을 삽입하는 경향을 보였다. 반면 FUDGE는 λ 값을 조정함으로써 대화 전반에 걸쳐 일관된 난이도를 유지했다.

이 논문의 주요 기여는 다음과 같다. (1) 초보 학습자를 위한 대화형 LLM 난이도 제어 작업을 정의하고, JLPT‑CEFR 매핑을 기반으로 레벨별 어휘·문법 사전을 구축했다. (2) 토큰 수준 이해도 측정 지표인 TMR을 제안해 자동 평가와 인간 평가 간 높은 상관성을 입증했다. (3) 모듈식 제어 기법, 특히 FUDGE가 비용 효율적이며 폐쇄형 모델에도 적용 가능함을 실증했다. (4) 코드, 모델, 어노테이션 도구, 데이터셋을 공개해 향후 연구 재현성을 확보했다.

전체적으로 이 연구는 LLM을 언어 학습 파트너로 활용하려는 초보자에게 실용적인 해결책을 제공한다. 난이도 제어가 가능한 모듈식 접근법은 기존의 대규모 파인튜닝 비용을 회피하면서도 학습자 맞춤형 대화를 구현할 수 있다. 앞으로는 다국어 확장, 학습자 개인화(예: 학습 속도, 선호 주제) 및 장기 학습 효과 검증을 위한 종단 연구가 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기