네트워크 GIANT의 수렴 분석: 근사 헤시안 기반 완전 분산 최적화 알고리즘

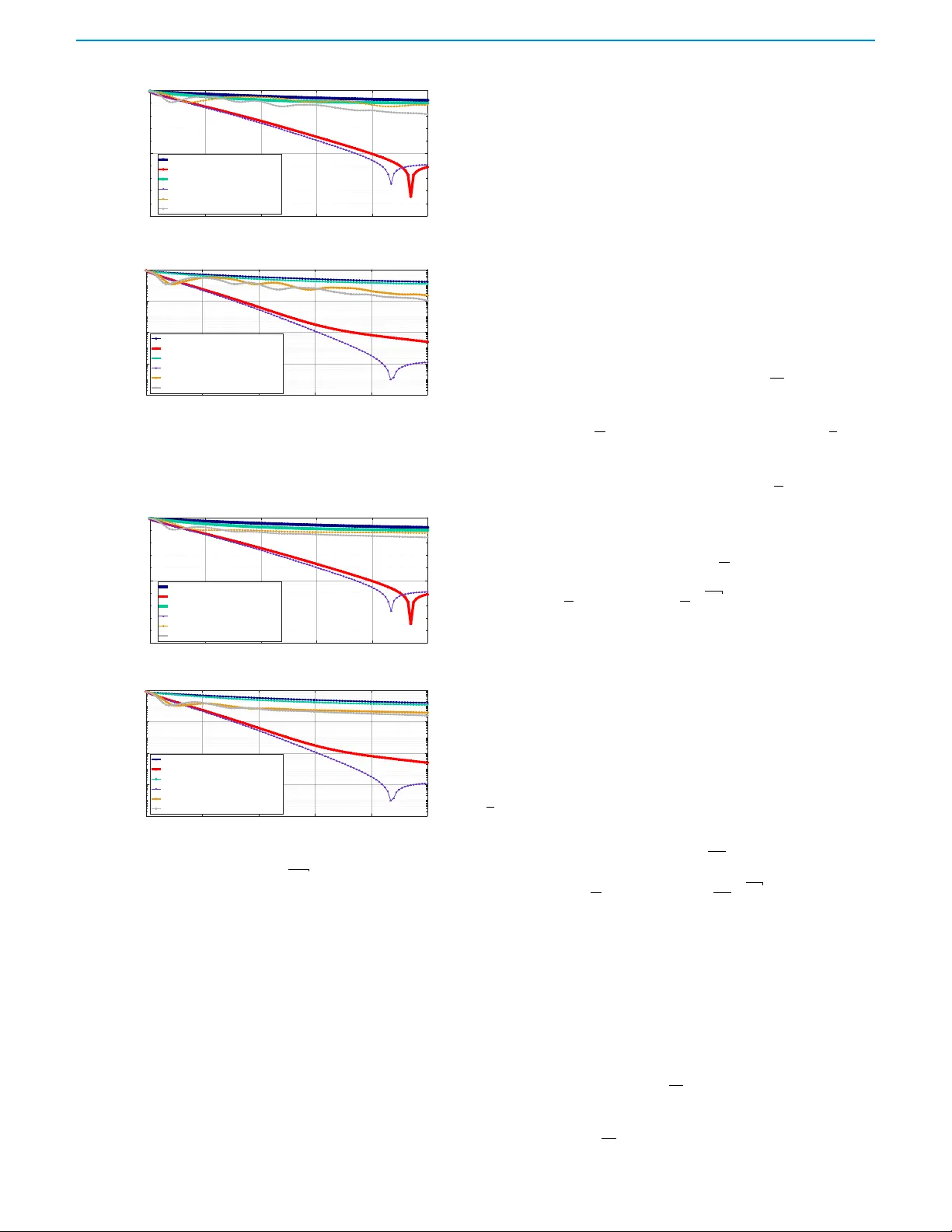

본 논문은 부드럽고 강하게 볼록한 로컬 손실 함수를 갖는 분산 학습 환경에서, 근사 뉴턴 방식인 Network‑GIANT의 수렴 특성을 이론적으로 규명한다. 3×3 행렬의 스펙트럴 반경을 이용해 전역 선형 수렴률을 명시적으로 도출하고, 스텝 사이즈 η에 대한 충분조건을 제시한다. 또한 헤시안 근사 오차 γ가 강한 볼록성 파라미터 μ보다 작을 때, 최적점 근처에서 1‑η(1‑γ/μ) 형태의 지역 선형 수렴률을 얻는 것을 증명한다. 실험은 이진 로…

저자: Souvik Das, Luca Schenato, Subhrakanti Dey

본 논문은 네트워크 환경에서 대규모 머신러닝 모델을 학습할 때, 통신 비용을 최소화하면서도 2차 정보(헤시안)를 활용해 수렴 속도를 높일 수 있는 새로운 알고리즘인 Network‑GIANT을 제안하고, 그 수렴 특성을 엄밀히 분석한다.

1. **문제 설정 및 배경**

- 각 노드 $i$는 로컬 손실 $f_i(x)$를 가지고 있으며, 전체 목표는 $F(x)=\sum_{i=1}^n f_i(x)$를 최소화하는 것이다.

- $f_i$는 $L$-리프시츠 연속 미분 가능하고 $μ$-강하게 볼록하다고 가정한다.

- 네트워크는 무방향 연결 그래프 $G$로 모델링되며, 이중 확률 행렬 $W$(행과 열이 모두 1인 확률 행렬)를 통해 합의(consensus) 연산이 수행된다.

2. **Network‑GIANT 알고리즘**

- 각 노드 $i$는 현재 추정 $x_i^k$와 그래디언트 추정 $y_i^k$를 유지한다.

- 로컬 헤시안 $H_i^k=\nabla^2 f_i(x_i^k)$를 이용해 근사 뉴턴 방향 $d_i^k = -(H_i^k)^{-1} y_i^k$를 계산한다. 실제 구현에서는 $H_i^k$를 정규화하거나 제한된 메모리 버전을 사용한다.

- 업데이트는

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기