밈 독성 탐지를 위한 지식 주입과 증류 프레임워크

초록

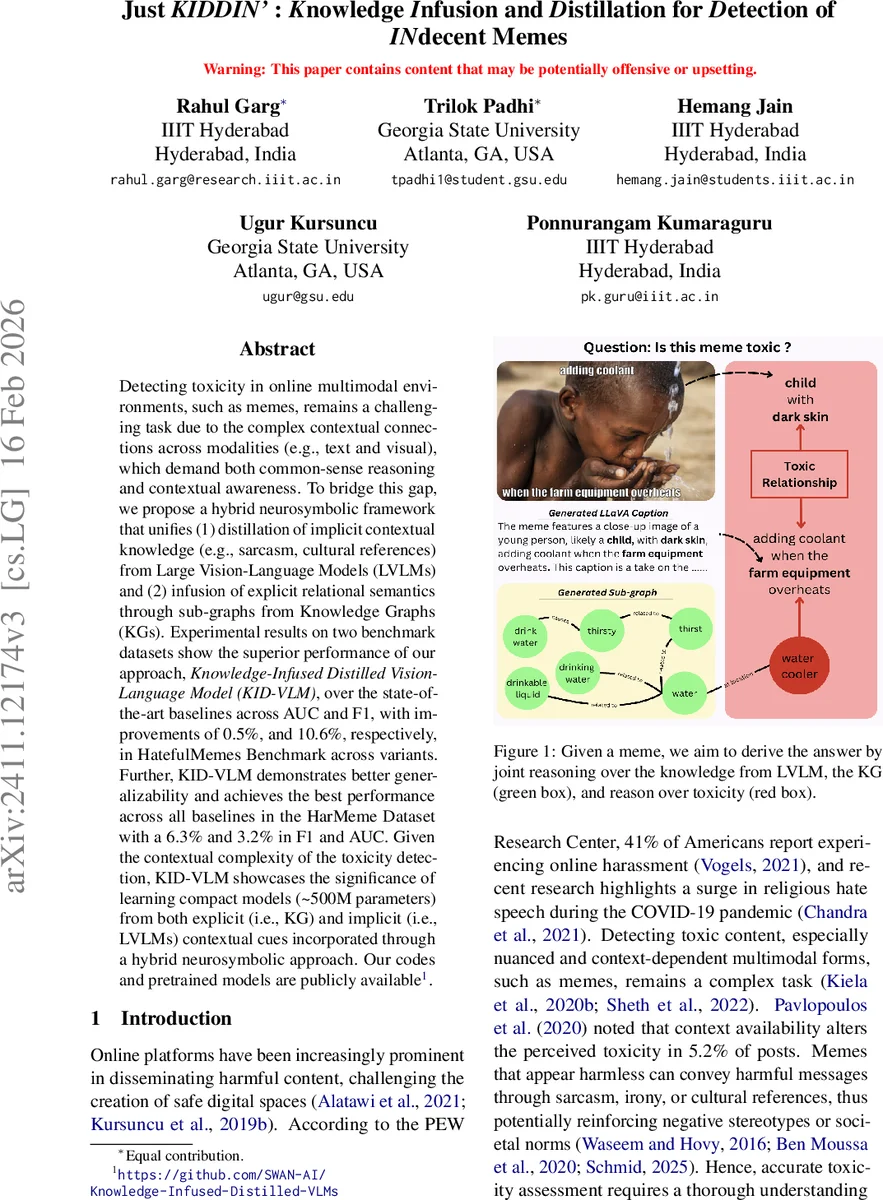

본 논문은 대형 시각‑언어 모델(LVLM)에서 얻은 암묵적 지식을 지식 증류(KD)로 압축하고, ConceptNet 기반의 상식 지식 그래프를 서브 그래프로 추출해 명시적 지식 주입(KI)과 결합한 KID‑VLM을 제안한다. CLIP 기반의 경량 학생 모델에 멀티모달 특징을 추출하고, 교사 모델(LLaVA‑NeXT)이 생성한 캡션을 통해 KD 손실을 적용한다. 또한, 작업 그래프와 R‑GCN을 이용해 KG 정보를 그래프 형태로 통합하고, 게이트형 융합으로 최종 멀티모달 표현을 만든다. HatefulMemes와 HarMeme 두 벤치마크에서 AU‑ROC, F1, Recall 등에서 기존 최첨단 모델을 능가하며, 파라미터 500M 수준의 경량 모델임에도 높은 일반화 능력을 보인다.

상세 분석

KID‑VLM은 ‘지식 증류’와 ‘지식 주입’이라는 두 축을 neurosymbolic 방식으로 결합한 점이 가장 큰 혁신이다. 먼저, 대형 LVLM인 LLaVA‑NeXT가 meme 이미지와 텍스트를 입력받아 캡션을 생성한다. 이 캡션은 암묵적 맥락(예: 풍자, 문화적 레퍼런스)을 담고 있으며, 학생 모델인 CLIP‑ 기반 VLM과 Euclidean 거리 기반 KD 손실(L_KD)로 정렬된다. 이 과정은 학습 단계에서만 수행되며, 추론 시에는 캡션 생성 비용이 사라져 경량화가 실현된다.

다음으로, 명시적 상식 지식은 ConceptNet에서 meme 텍스트와 캡션에 등장하는 개념을 기준으로 서브 그래프(G_sub)를 추출함으로써 얻어진다. 서브 그래프는 의미적 관련성을 평가하기 위해 MiniLM 기반 코사인 유사도와 RoBERTa 기반 퍼플렉시티 점수를 활용해 상위 k=750개의 노드를 선택한다. 선택된 노드와 ‘컨텍스트 노드(z)’를 연결해 작업 그래프(G_W)를 구성하고, 관계형 그래프 컨볼루션(R‑GCN)으로 노드 임베딩을 집계한다.

그래프 풀링된 표현(h_graph)과 KD‑정제된 멀티모달 표현(h_distilled)을 게이트형 융합(Gated Fusion)으로 결합해 최종 예측 벡터(F_multimodal)를 만든다. 손실 함수는 이진 교차 엔트로피(L_BCE)와 KD 손실(L_KD)의 가중합(L_total)으로 정의되어, 모델이 명시·암묵적 지식을 동시에 학습하도록 유도한다.

실험에서는 HatefulMemes의 ‘Seen’/‘Unseen’ 분할과 HarMeme 데이터셋을 사용했으며, KID‑VLM은 AU‑ROC 0.5%p, F1 10.6%p, Recall 35%p 등 현존 최고 성능을 기록했다. 특히 파라미터가 500M 수준인 점은 대형 Flamingo‑80B, LENS와 비교해 2~3배 가량 적은 연산량으로 동일하거나 우수한 결과를 얻음으로써 실용적 배포 가능성을 강조한다.

한계점으로는 서브 그래프 추출 시 노이즈가 포함될 가능성, KG의 도메인 편향, 그리고 캡션 품질에 대한 교사 모델 의존성이 있다. 향후 연구에서는 동적 KG 업데이트, 멀티‑도메인 KG 결합, 그리고 캡션 생성 시 다중 교사 모델 앙상블을 통해 이러한 약점을 보완할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기