다중모달 대비학습에서 모달리티 격차 설명과 완화

초록

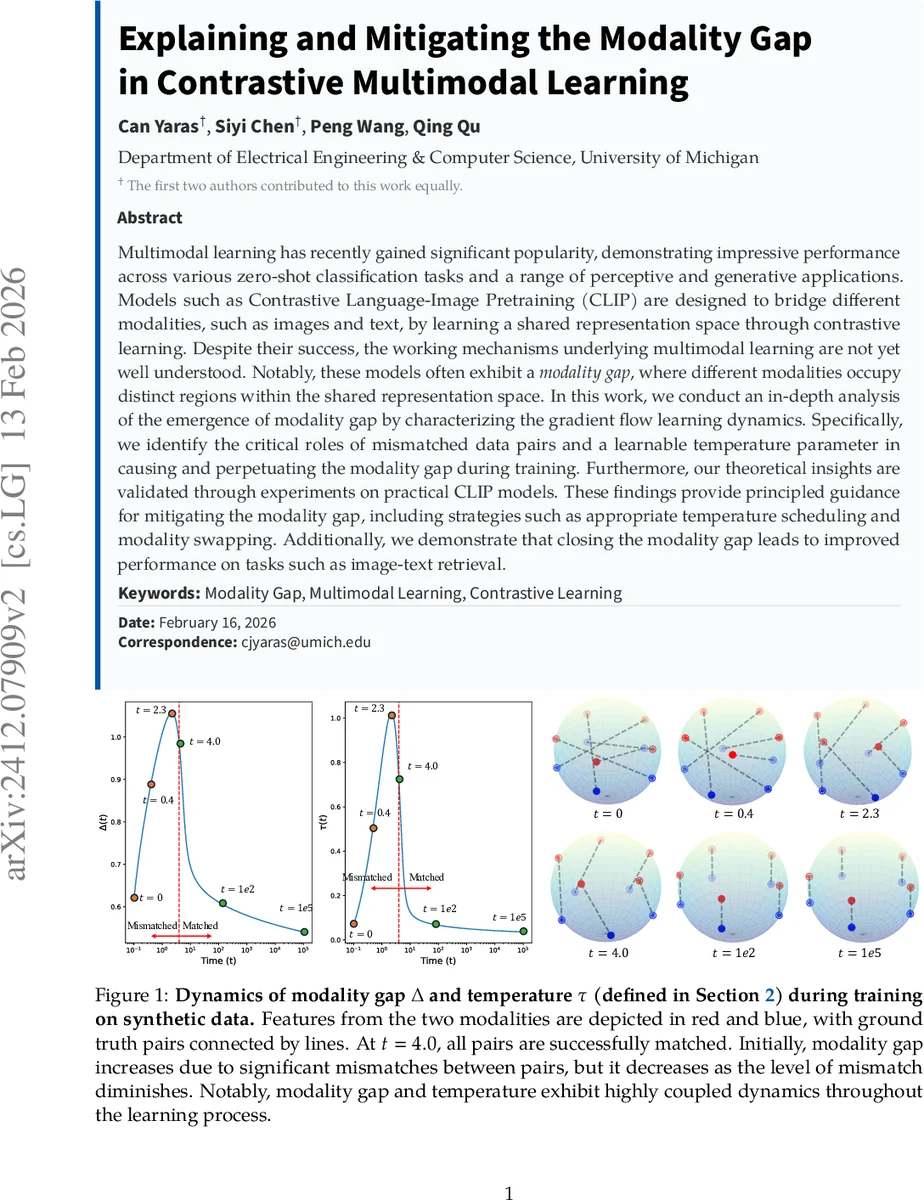

본 논문은 이미지와 텍스트를 연결하는 CLIP과 같은 대비학습 기반 다중모달 모델에서 나타나는 ‘모달리티 격차’를 이론적으로 분석한다. 저자는 gradient flow를 이용해 학습 과정에서 온도 파라미터와 매칭되지 않은 데이터 쌍이 격차를 어떻게 확대·안정화시키는지 증명하고, 온도 스케줄링 및 모달리티 스와핑과 같은 실용적인 완화 전략을 제안한다. 실험 결과, 격차를 줄이면 이미지‑텍스트 검색 성능이 향상됨을 확인한다.

상세 분석

논문은 먼저 CLIP의 학습 목표를 ℓ₂ 정규화된 이미지·텍스트 임베딩 Hₓ와 H_y 사이의 교차 엔트로피 손실로 정의하고, 온도 파라미터 τ를 학습 가능한 변수 ν의 함수 β(ν)=exp(ν) 로 표현한다. 이를 연속시간 gradient flow 형태로 전개하여 θ, φ, ν, γ(모달리티 간 평행도)를 시간 t에 대한 미분 방정식(4)으로 기술한다. 여기서 γ는 이미지와 텍스트 임베딩이 서로 평행하도록 강제하는 파라미터이며, 모달리티 격차 Δ는 두 모달리티 중심 cₓ, c_y 사이의 거리 ‖cₓ−c_y‖ 로 정의된다.

Lemma 3.1은 γ와 β의 변화율 비율 R = (dγ/dt)/(dβ/dt) 가 −2β(ν)·γ·β′(ν)·(1−γ²)⁻¹ 로 주어짐을 보이며, β′(ν)=β인 경우 R=Θ(1/β) 임을 도출한다. 즉, β(=1/τ)가 커질수록 γ의 감소 속도가 급격히 느려져, γ가 0에 수렴하지 못하고 일정 수준(≥Δ/2)에서 정착한다.

Theorem 3.2는 초기 β₀가 충분히 크고 마진 α가 양수인 상황에서, γ가 시간에 따라 최소 Ω(1/log²t) 정도로만 감소함을 증명한다. 이는 온도 파라미터가 학습 초기에 급격히 상승하면서 “모달리티 격차”를 실질적으로 고정시킨다. 저자는 이를 직관적으로 설명하기 위해 손실을 단순화한 ℓ(m)=exp(−m) 형태로 근사하고, 해당 경우 γ의 미분 방정식 dγ/dt=−2βγ·exp(−β(1−γ²)) 를 적분해 Δ(t)≥Ω(1/log²t) 를 얻는다.

이론적 분석을 바탕으로 두 가지 완화 전략을 제시한다. 첫째, 온도 τ를 초기에는 낮게 유지하고 점진적으로 상승시키는 “온도 스케줄링”은 β의 급격한 증가를 억제해 γ가 더 빠르게 감소하도록 만든다. 둘째, “모달리티 스와핑”은 학습 중에 이미지와 텍스트 임베딩을 교환해 매칭되지 않은 쌍을 인위적으로 감소시켜 초기 γ를 작게 만든다. 두 방법 모두 γ와 β의 상호작용을 조절함으로써 격차 감소 속도를 가속한다.

실험에서는 실제 CLIP 모델(ViT‑B/32 기반)과 합성 데이터셋을 사용해 온도 스케줄링과 스와핑이 Δ를 현저히 줄이고, 이미지‑텍스트 검색(R@1, R@5)에서 평균 3~5%p 상승을 가져옴을 확인한다. 반면, zero‑shot 이미지 분류와 linear probing에서는 격차 감소가 성능에 미치는 영향이 상대적으로 작아, 격차가 반드시 모든 다운스트림 작업에 이득을 주지는 않음을 지적한다.

결과적으로, 논문은 모달리티 격차가 온도 파라미터와 매칭되지 않은 샘플의 존재에 의해 학습 초기에 고착화된다는 메커니즘을 수학적으로 규명하고, 이를 완화하기 위한 구체적 방법론을 제시함으로써 다중모달 대비학습의 이해와 실용적 개선에 기여한다.

댓글 및 학술 토론

Loading comments...

의견 남기기