텍스트 속성 그래프의 장기 불균형을 극복하는 LLM 기반 보간 기법

초록

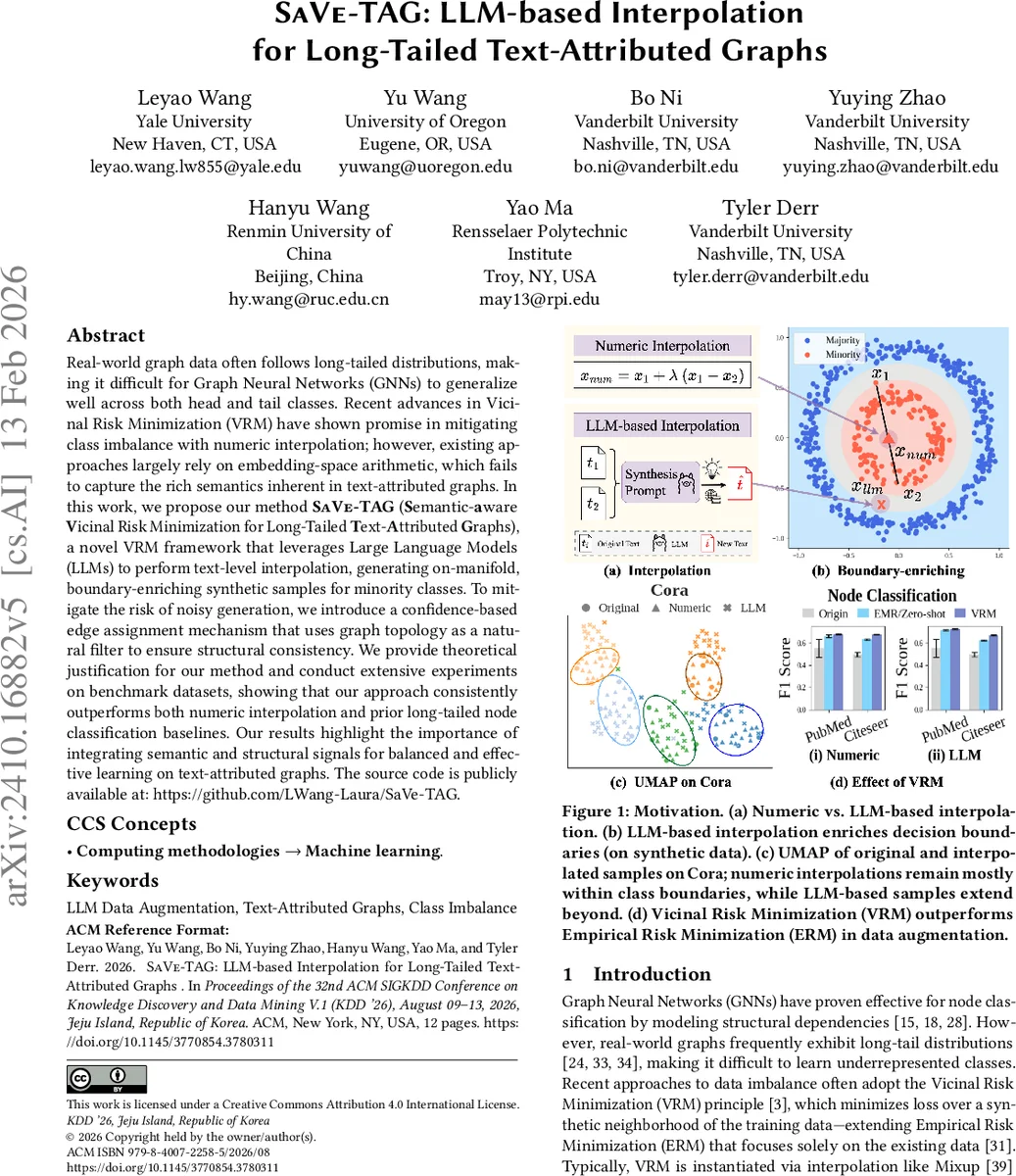

SaVe‑TAG는 대규모 언어 모델(LLM)을 활용해 텍스트 속성 그래프의 소수 클래스 노드 텍스트를 보간·생성하고, 그래프 구조 기반 신뢰도 점수로 엣지를 할당해 노이즈를 억제한다. 이를 통해 Vicinal Risk Minimization(VRM) 원리를 텍스트 수준에서 구현하고, 장기 불균형(node classification) 성능을 크게 향상시킨다.

상세 분석

SaVe‑TAG는 기존 그래프 데이터 불균형 해결 방법이 임베딩 공간에서 수치적 Mixup이나 SMOTE를 적용해 온‑매니폴드(Manifold) 보장을 놓치는 문제를 텍스트 수준에서 보완한다. 핵심 아이디어는 ‘vicinal twin’이라 불리는 같은 라벨을 가진 k‑NN 이웃 쌍을 찾아, 이 두 텍스트를 클래스‑조건부 프롬프트와 함께 LLM에 입력해 새로운 텍스트를 생성하는 것이다. 이 과정에서 LLM은 사전 학습된 방대한 언어 지식을 활용해 의미적으로 연속적인 샘플을 만들어내므로, 비선형·다중모드(class manifold) 구조를 그대로 유지한다는 이론적 보장을 제공한다(정리 3.2).

생성된 텍스트는 고정된 텍스트 인코더(예: BERT)로 임베딩된 뒤, 별도로 학습된 ‘confidence function’을 통해 원본 노드와의 유사도를 점수화한다. 높은 신뢰도를 보이는 원본 노드와만 엣지를 연결함으로써, 노이즈 샘플은 그래프에서 고립되고, 의미적으로 일관된 샘플만이 GNN의 메시지 전달에 기여한다. 이는 정리 3.8에서 제시된 바와 같이, 고신뢰도 엣지는 합성 노드를 올바른 클래스 매니폴드 쪽으로 끌어당겨 학습 안정성을 높인다.

또한 논문은 Boundary‑Coverage Rate(BCR) 개념을 도입해, 합성 샘플이 결정 경계 근처에 얼마나 많이 위치하는지를 정량화한다. BCR이 높을수록 최소 마진이 크게 감소하지 않으며, VRM 손실이 감소한다는 정리 3.5·3.7을 제시한다. 실험에서는 Cora, PubMed, ogbn‑arxiv 등 텍스트 속성 그래프 벤치마크에서 기존 Mixup, GraphSMOTE, Tail‑GNN 등을 크게 앞서며, 특히 tail 클래스 F1 점수가 평균 12%p 상승한다.

전반적으로 SaVe‑TAG는 (1) 텍스트 수준 보간으로 의미적 매니폴드 보존, (2) 그래프 구조를 자연 필터로 활용한 노이즈 억제, (3) VRM 이론에 기반한 경계 강화라는 세 축을 결합해 장기 불균형 문제를 효과적으로 해결한다는 점에서 혁신적이다. 다만 LLM 호출 비용과 프롬프트 설계 복잡도, 대규모 그래프에서의 스케일링 이슈는 향후 연구 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기